Il y a un an, Elon Musk n’était pas encore le propriétaire de Twitter. Le milliardaire s’apprêtait à mettre la main sur le réseau social, après des mois de procédure, mais n’avait pas encore mis la main sur la plateforme. Onze mois plus tard, Twitter s’appelle X et a beaucoup changé.

Le changement le plus marquant ne concerne pas la « liberté d’expression », contrairement à ce qu’Elon Musk a martelé pendant des mois, mais le fonctionnement de l’algorithme du réseau social. Il y a un an, Twitter était un site qui permettait n’importe quel inconnu d’interagir avec une célébrité ou un chef d’État. Aujourd’hui, X est une plateforme qui fonctionne à deux vitesses, condamnée à se fractionner encore plus dans le futur, avec l’introduction d’un abonnement payant obligatoire. Elon Musk veut traiter les personnes qui payent comme des utilisateurs VIP, en leur offrant une plus grande portée que les autres.

Pendant des années, Twitter a été critiqué pour l’élitisme de sa certification. Le réseau social décidait de qui était suffisamment « important » pour mériter une coche bleue. Sous Elon Musk, il suffit de payer 9,60 euros par mois pour être VIP, avec pour luxe d’éclipser les autres dans les résultats de recherche et les recommandations. Les créateurs de fake news l’ont bien compris et misent beaucoup sur X pour influencer l’opinion, avec du contenu conçu pour être viral et indiscernable de celui de sources vérifiées et officielles. Une perversion du système encore plus problématique en période de guerre entre Israël et le Hamas.

74 % des fake news viennent de comptes « vérifiés » payants

Elon Musk n’a pas inventé les fake news. Twitter a toujours été un vivier à problèmes, en grande partie à cause de sa modération quasi-nulle, et il serait sévère d’attribuer au créateur de Tesla la responsabilité des maux de la planète. Avant même le rachat de Twitter, plusieurs observateurs du monde des réseaux sociaux alertaient déjà Elon Musk sur le risque qu’il prenait. Diriger un réseau social, c’est prendre le risque d’avoir des morts sur la conscience.

Cependant, personne ne peut nier l’impact des décisions d’Elon Musk sur l’ambiance géopolitique actuelle. En grand défenseur du « journalisme citoyen », Elon Musk refuse de faire la différence entre un reporter de guerre sur le terrain et un internaute lambda, qui souhaiterait utiliser les réseaux sociaux pour diffuser de l’information depuis sa chambre. C’est déjà un problème, dont la gravité est encore plus grande lorsque l’on constate qu’une recherche des mots Israël, Gaza, Palestine ou Génocide sur X aboutit à une majorité de résultats venants de comptes autoproclamés « d’information », souvent défenseurs d’un clan plutôt que d’un autre, avec un risque de dérive communautaire élevé (un phénomène encore plus marqué que sur l’Ukraine/Russie, à cause du fort potentiel de l’exportation du conflit à cause de religions). Tous ont pour point commun d’être certifiés, parfois depuis très peu de temps.

Ce phénomène, la plateforme NewsGuard l’a observé. En se basant sur les 250 tweets mensongers les plus vus sur la situation israélo-palestienne, elle est arrivée à la conclusion que 74 % des publications problématiques (qui relatent 10 récits faux qui peuvent s’apparenter à de la propagande), soit 186 tweets sur 250, ont été écrites par des comptes certifiés. Une situation qui aurait été encore invraisemblable il y a un an, quand la certification était difficile à obtenir. Il faut d’ailleurs noter que les comptes certifiés n’étaient pas autant mis en avant dans l’ancien Twitter, même s’ils bénéficiaient d’une prime de visibilité.

Sur X, désinformer peut rapporter de l’argent

L’autre problème est que le X d’Elon Musk encourage les auteurs de tweets à publier du contenu destiné à faire polémique. Sous Elon Musk, les comptes certifiés avec plus de 5 millions de vues tous les trois mois reçoivent de l’argent pour leur activité sur la plateforme. Comment dépasser facilement ces 5 millions de vues ? En relayant de fausses vidéos d’enfants en cage, en annonçant des catastrophes qui n’ont pas eu lieu, en manipulant des images publiées par des médias, en faisant passer des images d’explosion en Syrie pour des images de Gaza, en publiant des vidéos d’enfants pleurant la mort d’un parent ou, encore plus facilement, en choisissant tout simplement un camp. Or une guerre n’est pas un match de foot. En incitant les utilisateurs à publier des avis tranchés, X pousse les humains à se disputer sur un sujet qu’ils ne maîtrisent pas. Un cercle vicieux et malsain, qui encourage les désinformateurs à continuer à propager leurs fausses vérités, pour gagner toujours plus d’argent (et propager au passage des visions communautaires, dans certains cas).

En une semaine, toujours selon NewsGuard, les fake news certifiées ont été vues plus de 100 millions de fois. Cela ne veut pas dire que 100 millions de personnes y croient, mais au moins qu’une partie d’entre elles est aujourd’hui convaincue de choses qui n’ont jamais eu lieu. Certaines de ces publications sont ensuite repartagées ailleurs, sur Instagram ou TikTok notamment, avec pour risque d’enflammer encore plus les débats (avec toujours cette coche bleue qui donne l’illusion de vérité).

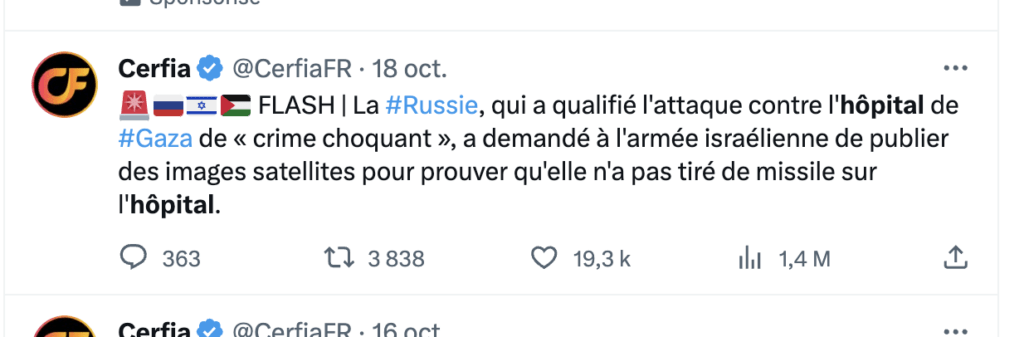

Le fait que certains médias liés à des États disposent aussi d’une grande mise en avant est aussi problématique, puisqu’ils reprennent les codes des médias traditionnels pour diffuser une information très orientée, qui incite au passage les gens à ne pas faire confiance aux médias traditionnels. Certains d’entre eux visent volontairement les communautés musulmanes et juives, pour les inciter à prendre parti et aller manifester dans la rue, parfois sur la base de choses qui ne se sont pas produites.

L’exemple de l’hôpital palestinien, accusé par les uns d’avoir été détruit par Israël, et par les autres d’avoir connu une explosion palestinienne sur un parking, est le parfait exemple de cette désinformation généralisée. Cet épisode a eu des répercussions internationales, notamment en annulant un sommet entre Joe Biden et plusieurs leaders du monde arabe, alors que la version originelle a rapidement été démentie. Autre problème, les comptes qui contribuent à démentir une information sont souvent non-vérifiés, donc moins crédibles et moins visibles. Faut-il payer pour pouvoir lutter contre une idée ? Exemple, le journaliste Shayan Sardarizadeh de la BBC, qui vérifie tous les jours l’exactitude de vidéos israéliennes et palestiniennes, n’est pas certifié. Son travail est pourtant d’intérêt public.

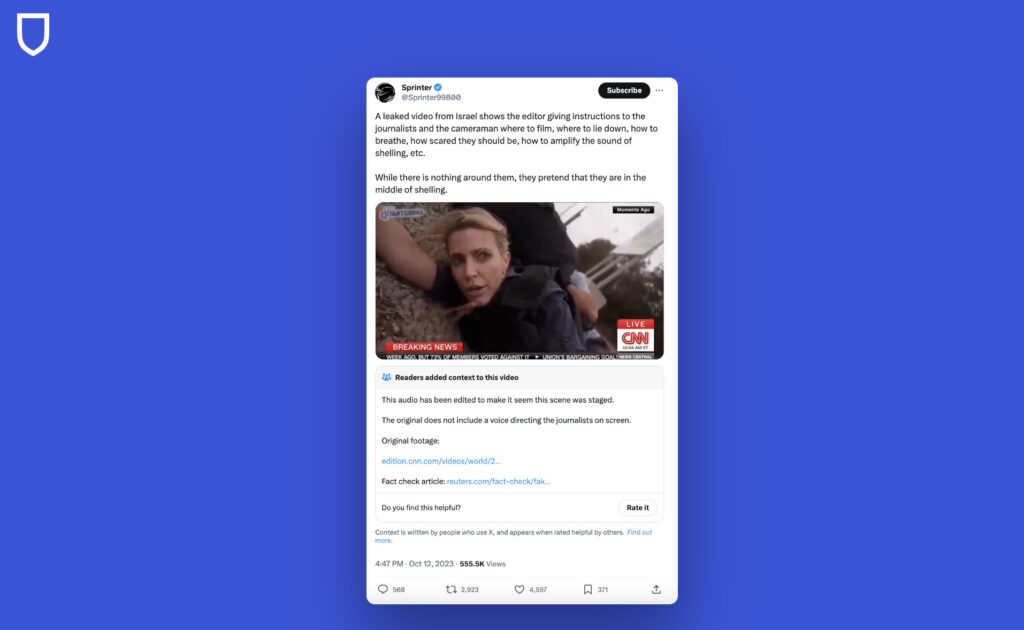

Les notes de communauté, un espoir pour sauver X

Paradoxalement, l’homme qui a rendu le vrai du faux indiscernable sur son réseau social est aussi celui qui pousse un nouveau système de modération intéressant, qui délègue la vérification d’une information aux utilisateurs entre eux, avec un système de votes. Les « Community Notes » permettent à n’importe qui de signaler un faux contenu, avec pour objectif de « mettre la honte » à l’auteur du mensonge, avec un bandeau sous son tweet. Un rare espoir dans cette guerre de désinformation.

Selon NewsGuard, il existe néanmoins des limites. Au vu de la gravité du conflit, certains faits sont difficiles à vérifier. Il est plus facile de propager un mensonge que de le désamorcer. La preuve, seules 79 des 250 publications testées par l’organisme disposent de notes de communauté. Le reste apparaît normalement, alors qu’il véhicule aussi de fausses idées.

Selon NewsGuard, seules sept personnes seraient à l’origine de la majorité des désinformations sur la guerre en question, à travers le monde (du moins en termes d’audience sur X). Leurs comptes sont suivis et diffusent du faux contenu largement relayé. En France aussi, ce phénomène peut facilement être observé. Les mêmes comptes reviennent sans cesse, tandis que des gros comptes d’information alternative, déjà connus, battent des records d’audience. Le problème est que les personnes qui ont envie d’être d’accord avec eux les relayent sans réfléchir, et tombent d’une certaine manière dans une nouvelle forme de complotisme. L’Union européenne a ouvert une enquête sur X, mais il est peu probable qu’elle puisse empêcher la désinformation en ligne sur le court ou moyen terme.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !