L’élection présidentielle américaine de 2024 aura lieu le 5 novembre et tout porte à croire que le face-à-face entre les Républicains et les Démocrates sera un « re-match » entre Donald Trump et Joe Biden. Plus encore qu’en 2020, l’électorat devrait être chauffé à blanc dans ce scrutin aux enjeux colossaux.

Dans ce cadre, la direction de Midjourney réfléchit sérieusement à bannir toute création de nature politique pour les mois à venir. C’est ce que signale Bloomberg, dans son édition du 8 février, en rapportant les propos de David Holz, le fondateur et patron de Midjourney. Essentiellement, il s’agirait de bannir les requêtes sur Joe Biden et Donald Trump.

L’interdiction de générer des visuels sur ces deux personnalités politiques — et sans doute aussi sur d’autres responsables de premier plan — devrait durer douze mois : une période qui couvrirait la campagne électorale, mais aussi les primaires, l’élection, la certification des résultats, l’investiture et le début de la présidence.

« Je sais qu’il est amusant de faire des images de Trump », a reconnu David Holz, en affirmant en créer lui aussi de temps en temps. « Trump est esthétiquement très intéressant. Cependant, il vaut mieux sans doute se retirer un peu pendant cette élection. Nous verrons. »

« Je sais qu’il est amusant de faire des images de Trump »

David Holz

Les détournements sont déjà là

La réflexion de Midjourney arrive à un moment où les détournements sont déjà en cours, avec des visuels explicitement conçus pour nuire à Joe Biden ou à Donald Trump. Ils sont parfois représentés nus, dans des postures ou des situations dégradantes. On les voit aussi dans des scènes pensées pour les mettre à leur désavantage.

On sait que Midjourney peut ponctuellement bannir certaines requêtes, pour éviter les détournements sexuels par exemple. En 2023, il avait été constaté que l’outil de génération d’image par intelligence artificielle ne donnait pas suite aux prompts sur Xi Jinping, le président chinois (cela a changé depuis : on peut désormais obtenir des visuels).

Avec la sortie de Midjourney v6, qui est maintenant capable de produire des rendus photoréalistes, le danger de manipulation est encore plus grand. En principe, Midjourney a déjà mis en place des garde-fous pour éviter certains prompts, mais le risque d’un contournement des filtres de modération demeure, si le prompt est écrit habilement.

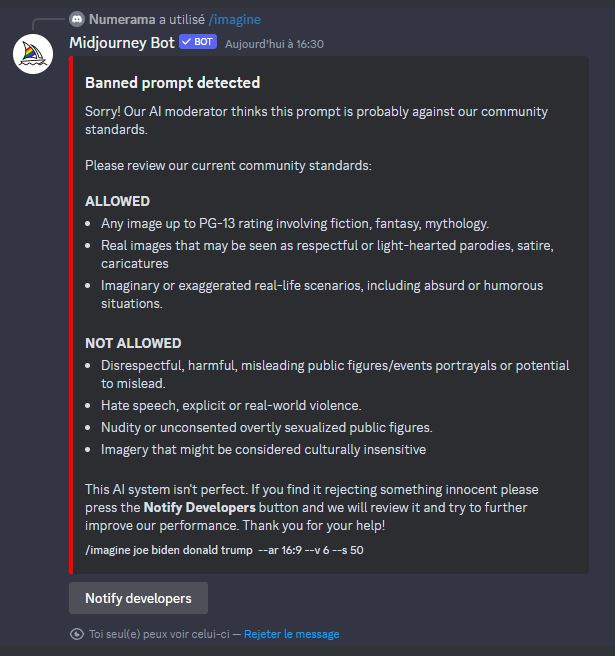

Selon nos constatations, certaines combinaisons ne sont déjà plus possibles sur Midjourney : il n’est pas possible de produire une image dans laquelle Joe Biden et Donald Trump figurent. On peut en revanche toujours avoir l’un ou l’autre dans des visuels séparés. Là encore, toutes les requêtes ne passent pas. Même un simple « Joe Biden cartoon » est refusé.

Actuellement, si un prompt est bloqué par la modération, le message suivant apparaît :

Prompt banni détecté

Désolé ! Notre modérateur AI pense que ce prompt est probablement contraire aux normes de notre communauté. Veuillez consulter nos normes communautaires actuelles.

Autorisé :

- Toute image jusqu’à la classification PG-13 impliquant la fiction, la fantaisie, la mythologie.

- Images réelles qui peuvent être considérées comme des parodies, des satires ou des caricatures respectueuses ou légères.

- Scénarios imaginaires ou exagérés de la vie réelle, y compris des situations absurdes ou humoristiques.

Non autorisé :

- Représentations irrespectueuses, nuisibles, trompeuses de personnages/événements publics ou susceptibles d’induire en erreur.

- Nudité ou personnages publics ouvertement sexualisés sans consentement.

- Discours de haine, violence explicite ou réelle.

- Images pouvant être considérées comme culturellement insensibles.

Midjourney ne réglera rien tout seul

Le phénomène des deepfakes et des détournements par IA générative n’est pas nouveau. Dès 2017, des chercheurs de l’université de Washington ont réalisé un portrait photoréaliste de l’ancien président américain Barack Obama. Une autre vidéo, en 2018, avait été conçue pour justement mettre en garde le public sur ces faux.

Le problème, néanmoins, est que l’IA générative fait des progrès tels qu’il devient de plus en plus difficile de distinguer le réel de l’imaginaire. De plus, ces montages s’insinuent partout : les photos, les vidéos et même la voix peuvent être détournées pour faire prononcer des propos erronés à un tiers, ou le mettre dans une position embarrassante.

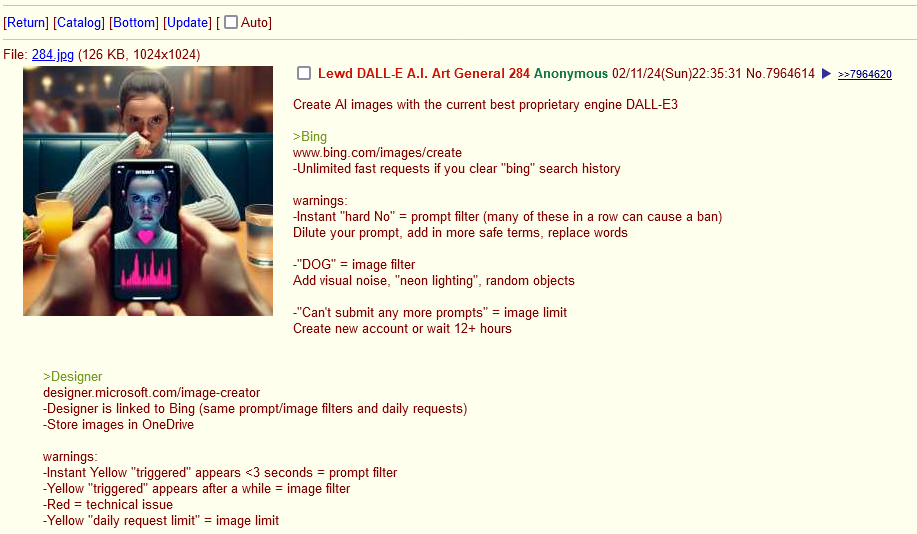

La décision de Midjourney, si elle est actée, ne sera pas de trop pour éviter les manipulations. Elle risque toutefois d’être bien insuffisante sans l’appui du reste de l’industrie de l’IA générative. Sur le papier, les principales alternatives à Midjourney, comme Adobe Firefly ou Dall-E, ont aussi des lignes directrices à respecter.

En la matière, les choses bougent. En février, on a appris que Meta (la maison mère de Facebook et Instagram) se lançait dans l’identification des contenus produits par IA, photos comme vidéos, pour ne pas tromper ses utilisateurs. Et OpenAI ajoute désormais des marqueurs pour identifier des images générées par son outil Dall-E 3.

Reste cependant des angles morts potentiels : les outils d’IA générative qui sont librement accessibles dans la nature, et qui reposent sur le principe de l’open source. Un contrôle en amont de ce que l’on peut faire ou non avec est moins évident, contrairement à des solutions davantage verrouillées, et plus commerciales.

Les outils commerciaux et verrouillés ne sont pas à l’abri d’avoir des trous dans la raquette. Les détournements pornographiques de Taylor Swift ont pu être réalisés avec Dall-E et malgré les efforts d’OpenAI de colmater les brèches, il est toujours possible, selon nos constatations, de contourner les règles en place avec certaines techniques.

Et, d’autre part, le développement de solutions génératives par des tiers malveillants est un scénario également plausible, pour perturber le bon déroulement du scrutin. Il a été admis que la Russie s’est, par exemple, immiscée dans l’élection américaine de 2016, par divers moyens. L’usage de l’IA générative pourrait être l’un d’eux en 2024.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !