Mise à jour du 1er avril 2023 : L’AFP a reçu la confirmation, le vendredi 31 mars 2023 dans la soirée, que l’image avait bien été générée par l’intelligence artificielle MidJourney. Le cliché a été créé dans le cadre « d’un faux documentaire satirique sur la réforme des retraites à 98 ans », a indiqué l’auteur à l’agence. La photo avait été présentée comme fausse sur les réseaux sociaux, avant d’être récupérée.

Article original :

« Dis-moi comment tu traites tes vieux et je te dirai dans quelle société tu vis ! », lance cet internaute sur Twitter, en rajoutant les mots-clés #ReformeDesRetraites #ViolencesPolicieres. « L’image d’un homme âgé au visage ensanglanté manifestant en France fait le tour du monde », dit un autre, avec #ReformeDesRetraites, #Europe et #FranceProtest en tags.

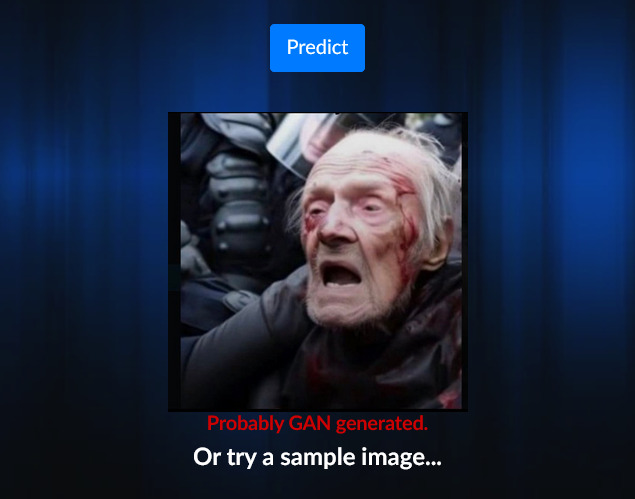

Dans les deux tweets, une même photo. On voit un homme âgé, l’air hagard, les yeux tuméfiés, avec des plaies au visage. Il apparaît perdu, la bouche ouverte, et autour de lui, on distingue des forces de l’ordre, comme une marée sombre lui tombant dessus. On se dit inévitablement que le sénior a été violenté lors des manifestations contre la réforme des retraites.

Mais d’où vient cette image ? Est-elle vraiment réelle, ou a-t-elle été créée par une intelligence artificielle ?

Des indices qui font douter de la véracité du cliché

Il s’agit d’une photo hautement suspecte. Comme le signale Guillaume Brossard, co-fondateur du HoaxBuster, un site spécialisé dans la traque des canulars et de la désinformation, plusieurs indices conforteraient la piste d’un visuel généré par une intelligence artificielle. Peut-être Midjourney, car ce système d’IA s’avère parfois très performant.

Dans un fil sur Twitter, il avance trois éléments qui tendent à penser que l’image est fausse.

- D’abord, la photo est apparue récemment et n’était diffusée que sur Twitter dans un premier temps, par très peu de comptes. Une recherche inversée sur Google ne la montre nulle par ailleurs. Elle n’est pas non plus reprise par la presse.

- Ensuite, le lien fait entre cette image et une vidéo montrant l’arrestation d’un homme lui ressemblant vaguement est contesté. Des différences apparaissent entre ces deux personnes — au niveau de la barbe, des cheveux ou de l’âge.

- Enfin, l’observation attentive du sujet fait apparaître des étrangetés sur le visage, ce qui suggère une création purement artificielle. Le visage du policier derrière a l’air irréel, tandis que le sénior a un visage plutôt flou. Les rides du menton et la forme des yeux, en particulier, interpellent.

« Même s’il est impossible d’affirmer avec certitude qu’il s’agit d’une image générée par IA, de nombreux éléments (à commencer par l’impossibilité de trouver la moindre trace de cette arrestation) tendent à démontrer qu’il ne s’agit pas d’une image réelle », met en garde Guillaume Brossard.

Autre élément qui incite encore plus à la prudence. Comme le note Frandroid, des ingénieurs de Mayachitra ont créé un détecteur de GAN (Generative adversarial networks, ou Réseaux antagonistes génératifs) pour aider à identifier les images générées par IA. Si l’outil n’est pas systématiquement fiable, son emploi associé à d’autres critères de vérification (comme ceux cités par le co-fondateur de HoaxBuster).

L’AFP, après notre article, a également enquêté sur cette image. Dans un tweet, l’agence indique avoir « retrouvé une première occurrence de l’intégralité de cette image dans une publication Facebook du 19 mars, dont plusieurs éléments laissent penser qu’il s’agit d’une image générée par intelligence artificielle ». Elle a reçu des commentaires et des réactions et a été largement partagée.

Là aussi, l’AFP observe des étrangetés visuelles : aucun signe distinctif des forces de l’ordre, comme des insignes ou des bandes de couleur. La visière en haut à gauche de l’image présente également une apparence anormale. Le sang figurant sur la manche d’un des policiers paraît aussi invraisemblable, et peut-être trop abondant (le vêtement du sénior paraît aussi maculé).

Des difficultés croissantes à repérer une image générée par une IA

Le débat autour de cette photo illustre en tout cas la difficulté croissante que l’on va avoir à déceler le réel de l’imaginaire avec les progrès fulgurants dans le domaine de l’intelligence artificielle. La sortie de Midjourney V5 a permis de faire un bond en avant considérable pour des photos ultra-réalistes, en corrigeant au passage des bugs grossiers, comme les mains.

Il y a encore certes des ratés que l’on peut rapidement détecter. Midjourney ne sait pas faire les monocycles et les spaghettis, par exemple. Des images montrent aussi des situations trop invraisemblables pour être crédibles (comme Emmanuel Macron en manifestation). Mais, entre ces deux extrêmes, il y a tout un espace dans lequel des images réalistes peuvent être crédibles.

Arrivera-t-on encore à déceler des images produites par des IA, à mesure que les petits défauts seront corrigés au rythme des mises à jour de ces systèmes ? Les enjeux en matière de désinformation sont à ce titre colossaux, compte tenu de la viralité de certaines publications sur les réseaux sociaux, lorsqu’elles sont liées à l’actualité brûlante — relayée par des comptes douteux.

« Attention aux images de violences policières qui circulent. Si elles montrent presque toujours des violences policières réelles, le risque que certaines soient générées par IA n’est pas négligeable. L’indignation légitime qu’elle suscite peut abaisser notre seuil de vigilance », rappelle Tristan Mendès France, enseignant dans le domaine du numérique.

Un appel qui peine à être entendu : le premier tweet mentionné en début d’article frôle les 900 retweets et les 1 300 J’aime. Le second est à 5 300 retweets et 6 760 J’aime. Il y a également de nombreux retweets avec citation (dont certains alertent sur le caractère suspect de visuel).

Et en filigrane, une autre question émerge : comment les internautes réussiront-ils encore à accorder leur confiance à une image diffusée en ligne, si les créations par IA se mélangent habilement aux vraies ? Il reste des méthodes classiques de vérification de l’information à toujours garder en tête : chercher la source d’une photo et regarder si le compte qui l’a publié est sérieux, et d’où provient la capture d’écran partagée.

(mise à jour avec les éléments de l’AFP, qui confortent l’hypothèse d’une fausse image)

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !