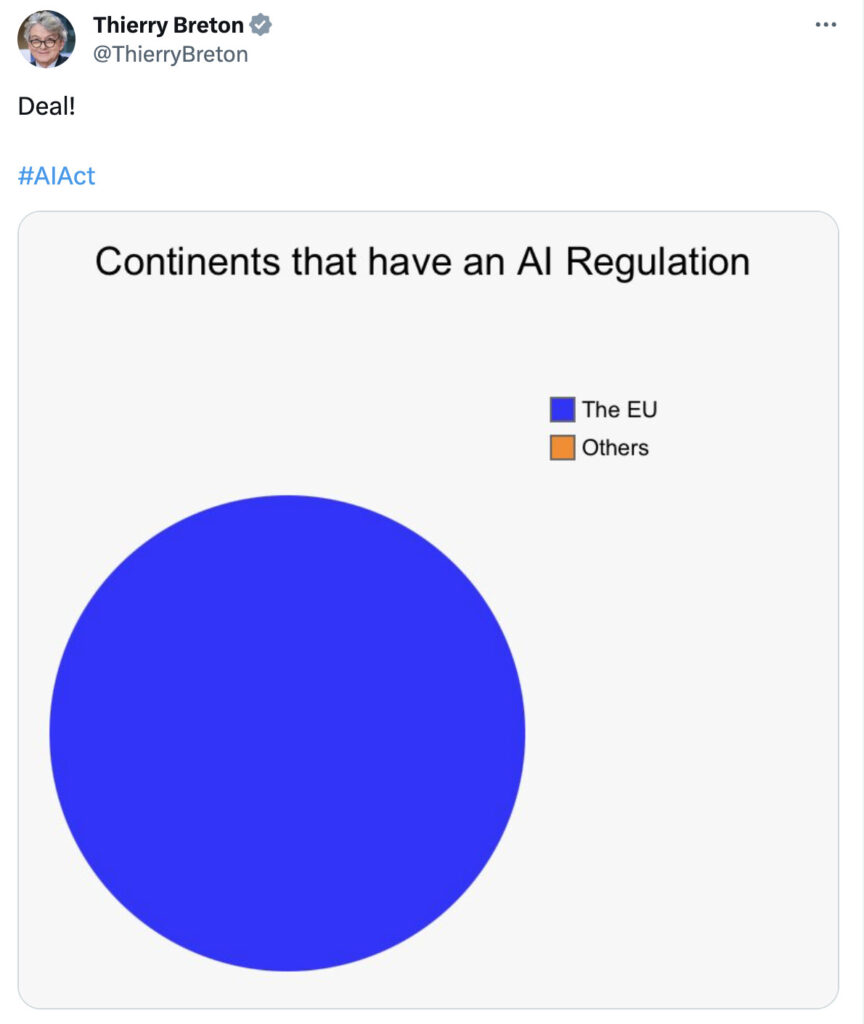

En France, il y aura prochainement un encadrement du développement et de l’utilisation des intelligences artificielles, alors que ce secteur est en plein boom depuis l’apparition de ChatGPT en novembre 2022. Dans la nuit du 8 au 9 décembre 2023, la Commission européenne est arrivée à un accord à propos de l’AI Act, un texte qui vise à réguler les services comme ChatGPT ou Midjourney. L’UE promet que son AI Act n’est pas là pour freiner l’innovation, mais pour s’assurer que ces services resteront contrôlables.

Si l’Union européenne est devenue une référence internationale en matière de régulation du secteur de la tech (RGPD, Digital Services Act, DMA, l’USB-C sur tous les smartphones…), l’AI Act divise.

Certains reprochent à l’Europe d’avoir régulé pour réguler, ou d’avoir légiféré trop tôt alors que l’industrie de l’intelligence artificielle est encore balbutiante. D’autres considèrent que le texte ne s’attaque pas aux sujets essentiels, et bien plus critiques pour les droits des personnes, comme la reconnaissance faciale. Les reproches sont nombreux depuis le 9 décembre.

La reconnaissance faciale, un terrain de mésentente

Concrètement, voilà ce que change l’AI Act :

- Les systèmes d’IA seront désormais classés selon les risques qu’ils présentent, grâce à un système de notation déterminant leur impact sur la société. Ces notes sont renseignées par les fournisseurs des systèmes, qui devront les afficher pour chaque service proposé.

- Les IA à haut risque, utilisés dans la cadre de la sécurité ou la surveillance, sont soumis à des règlementations très strictes.

- Les IA à très haut risque, qui font usage de reconnaissance biométrique ou affectent les droits fondamentaux (la notation sociale, par exemple), sont interdites.

- Les entreprises qui proposent des IA doivent s’engager à respecter des règles sur la transparence, la non-discrimination et la responsabilité environnementale.

- Des êtres humains doivent pouvoir modérer les IA.

- Certains outils devront explicitement indiquer à leurs utilisateurs qu’ils ne parlent pas à une vraie personne.

Arriver à un accord sur l’AI Act n’a pas été facile, la faute à l’intense lobbying des grandes entreprises de la tech, qui ont tout fait pour empêcher l’Union européenne de leur mettre des bâtons dans les roues. Les groupes européens, comme Mistral, font parmi des plus inquiets. Ils reprochent à Bruxelles de laisser le champ libre aux entreprises américaines en régulant trop vite le secteur européen, alors que l’IA est encore à ses débuts. Une idée partagée par Xavier Niel qui a lancé son organisation Kyutai, qui vise à offrir à la France une alternative à OpenAI.

Un autre problème a particulièrement agité les débats : la reconnaissance faciale. Des logiciels peuvent retrouver une personne en quelques secondes grâce à l’intelligence artificielle, ce que certains veulent interdire. Le texte final interdit la reconnaissance faciale en temps réel ainsi que l’utilisation de technologies biométriques pour analyser les émotions, mais laisse une marge de manœuvre aux gouvernements. Comme le rapporte Mediapart, la France a notamment fait pression pour pouvoir utiliser la reconnaissance faciale dans un cadre de « menaces terroristes ou spécifiques, substantielle et imminente », notamment pour retrouver des personnes disparues.

L’AI Act probablement en vigueur en 2025

Qu’est-ce que l’AI Act va changer dans nos vies ? Pour le moment, rien. Un accord a été trouvé par la Commission européenne, mais il doit maintenant être examiné par le Parlement européen et les représentants des 27 pays membres. La possibilité que des États le bloquent existe, au même titre que celui d’une profonde évolution du texte d’ici sa mise en application à l’horizon 2025. D’ici là, les États-Unis auront probablement régulé leur propre utilisation de l’intelligence artificielle, comme le souhaite le président Joe Biden.

En attendant, l’Europe reste globalement à la traine en matière d’intelligence artificielle. Malgré la multiplication des initiatives d’envergure, les États-Unis et l’Asie restent les plus ambitieux. Dans certains cas, l’Union européenne est aussi servie dans un second temps, puisque les développeurs d’IA génératives doivent l’adapter aux règles européennes. C’est notamment le cas de Google Gemini, annoncé pour début 2024 en France.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !