La polémique aura eu raison des intentions d’Apple. Critiquée depuis quelques semaines en raison de la mise en place d’un outil polémique de lutte contre la pédocriminalité, l’entreprise américaine derrière l’iPhone et l’iPad a décidé de repousser le déploiement de son service à une date ultérieure.

Comme l’explique un article de The Verge daté du 3 septembre 2021, Apple estime nécessaire de « prendre plus de temps dans les prochains mois pour améliorer son système » avant de le déployer sur ses appareils. L’entreprise assure avoir écouté « sa clientèle, les groupes de défense de la vie privée et les spécialistes du sujet » pour construire un outil plus respectueux des données personnelles de sa clientèle. La page détaillant ces nouvelles fonctionnalités a été mise à jour.

Une équation impossible

Prévu pour arriver avec la prochaine version d’iOS, cet outil surnommé NeuralMatch a pour rôle de scanner les photos mises en ligne sur iCloud pour les comparer à une base de données de clichés pédopornographiques construite par des associations spécialisées. L’objectif ? Constater la présence éventuelle de copies de ces images sur l’iPhone, dont la détention et la diffusion sont illicites dans un grand nombre de pays du monde, comme en France ou aux États-Unis.

Malgré de nombreux efforts pour tenter d’expliquer en quoi son système était taillé pour respecter la vie privée de sa clientèle, la marque américaine était restée sous le feu des critiques. Des spécialistes de la vie privée voyaient dans cet outil une sorte de « porte dérobée » qui pourrait être utilisée par un gouvernement autoritaire pour espionner sa population.

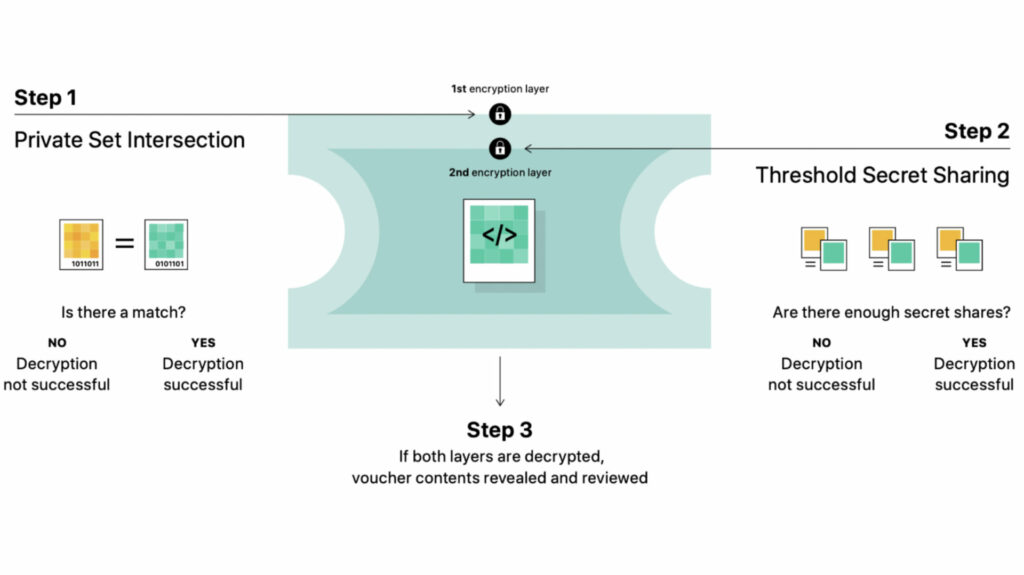

Pour Apple, qui se présente comme une entreprise à la pointe sur les questions de vie privée et de confidentialité, la situation était inconfortable. D’un côté pèse la nécessité évidente de lutter contre la pédocriminalité et de l’autre l’importance de le faire sans que cela ne nuise à ses utilisateurs et utilisatrices. Le système repose sur une analyse cryptographique des photos et n’est censé envoyer une alerte qu’après plusieurs détections, sur un même iPhone de photos potentiellement illégales, pour limiter les risques de faux positifs et, donc, de ratés.

Mais le cœur de l’outil, qui scanne la signature binaire d’une photo pour la comparer à celles fournies par une association de défense pour le droit de l’enfant, préoccupe plusieurs spécialistes en protection de la vie privée qui craignent que le déploiement d’un tel outil soit le début d’une pente savonneuse, où des demandes croissantes pourraient être formulées — par exemple sur les contenus terroristes. Pris entre ces deux feux, Apple temporise donc en réaffirmant, en attendant de corriger le tir, son intention intacte de « déployer ces outils capitaux pour la sécurité des enfants ».

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !