Apple est actuellement au cœur d’une polémique concernant le respect de la vie privée. L’entreprise, pourtant plutôt connue pour sa position ferme en faveur de la protection des données personnelles, est critiquée par des associations et des spécialistes à cause de l’installation d’un nouvel outil sur ses iPhone.

La crainte de dérives autoritaires

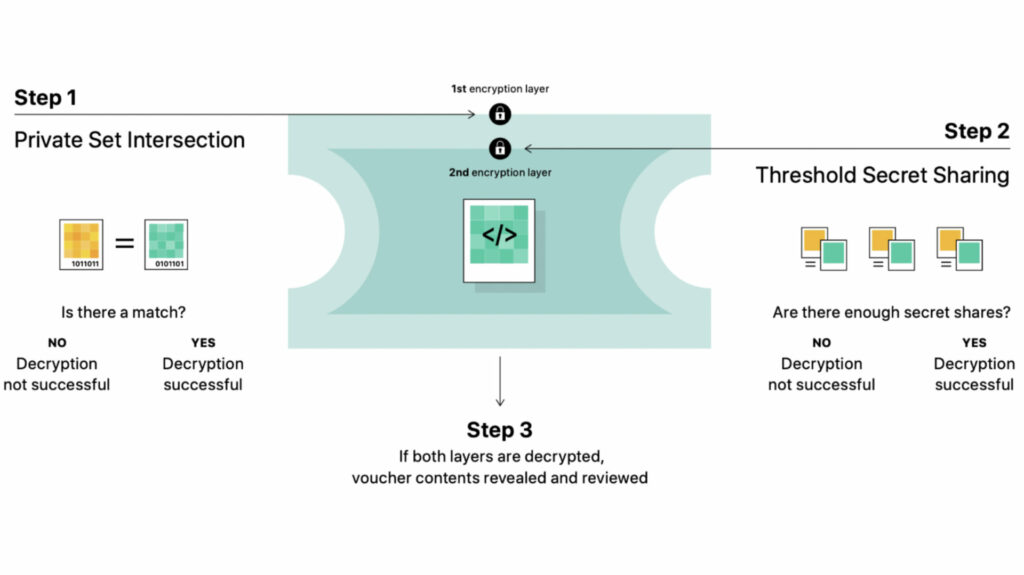

Nommé NeuralMatch, ce système, qui arrivera avec une future mise à jour, a pour mission d’identifier de potentiels contenus pédopornographiques partagés par des propriétaires d’iPhone. Techniquement, ce système ne fait que comparer la signature électronique d’une photo avec celles contenues dans une banque de données fournie par la NCEMC, une association de défense pour le droit des enfants.

Sauf que le mécanisme employé est particulièrement intrusif selon de nombreux défenseurs et défenseuses de la vie privée. Chaque photo envoyée sur iCloud sera en effet scanné en local sur le téléphone et héritera d’une signature unique (et chiffrée) qui est censée permettre l’identification de contenus potentiellement illégaux. La crainte est que cet outil, pensé pour lutter contre l’exploitation infantile, soit détourné par des gouvernements autoritaires pour identifier des contenus critiques du pouvoir.

Des critiques venant d’Edward Snowden

« Les gouvernements qui interdisent l’homosexualité peuvent exiger que l’outil soit formé à identifier le contenu LGBTQ+. Un régime autoritaire peut exiger qu’il soit capable de repérer les images satiriques populaires ou les tracts de manifestations », s’inquiète l’EFF sur son site. La célèbre ONG américaine de défense pour les droits numériques n’hésite pas à qualifier la solution de « porte dérobée », en allusions aux faiblesses intentionnellement installées dans les systèmes informatiques pour permettre l’espionnage. « Ne soyez pas dupes, ceci est dégradation de la vie privée pour tous les utilisateurs d’iCloud Photos, pas une amélioration », écrit l’ONG.

L’argument est repris par le célèbre lanceur d’alerte Edward Snowden qui a ajouté dans un tweet que « peu importe les bonnes intentions, Apple déploie ici un outil de surveillance de masse du monde entier. Ne vous méprenez pas : s’ils peuvent scanner de la pédopornographie aujourd’hui, ils peuvent scanner n’importe quoi demain ». Interrogé par le Financial Times, Ross Anderson, un spécialiste en sécurité de l’ingénierie qualifie cette idée « d’absolument consternante ».

« Les voix stridentes de la minorité »

De son côté, Apple se défend en expliquant que « sa méthode pour identifier du contenu pédopornographique est pensée avec la protection de la vie privée en tête ». En comparant uniquement les signatures cryptographiques des photos, l’entreprise explique qu’elle « n’apprend rien sur les images qui ne correspondent pas à une entrée dans la base de données ». Seuls les comptes iCloud signalés plusieurs fois feront l’objet d’une alerte, suivi d’une analyse humaine, explique l’entreprise.

Une note interne obtenue par le site AppleInsider montre tout de même que l’entreprise est consciente de la position délicate dans laquelle elle est. « Nous savons que certaines personnes ont des appréhensions et que d’autres s’inquiètent des implications d’un tel outil, mais nous continuerons à expliquer et à détailler ses fonctionnalités pour que les gens comprennent ce que nous avons construit », écrit un responsable d’Apple. Dans le même message, la NCEMC regrette, elle, cette montée de bouclier et qualifie les critiques de « voix stridentes de la minorité ». Les concernés apprécieront.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !