Au milieu d’une controverse concernant son outil de lutte contre la pédopornographie, Apple a pris la parole pour tenter de mieux expliquer le fonctionnement du fameux algorithme NeuralMach, au cœur de la polémique.

Quels sont les garde-fous ?

Dans un document publié le lundi 9 aout, Apple répond aux critiques les plus sérieuses qui lui ont été adressées, dont celles concernant les éventuels risques de dérive autoritaires d’un tel outil. « Soyons clairs, cette technologie est limitée à la détection de contenu pédopornographique stocké dans cloud et nous n’accéderons à aucune demande gouvernementale visant à l’étendre », écrit l’entreprise.

Interrogé sur le sujet, Apple ne nie pas les éventuels problèmes que pourrait poser cet outil, mais tente de rassurer sur son impact global. Pour le moment, NeuralMatch n’est déployé qu’aux États-Unis avec la collaboration d’une association de défense pour le droit des enfants. Une éventuelle extension ne se fera qu’après une analyse sérieuse des risques associés dans chaque pays, nous explique le constructeur. Le groupe ne s’est pas étendu sur l’hypothèse que des pays aux lois plus strictes puissent chercher à le contraindre juridiquement à étendre le dispositif à leur territoire, et assure juste qu’il regardera de près tous ces aspects-là.

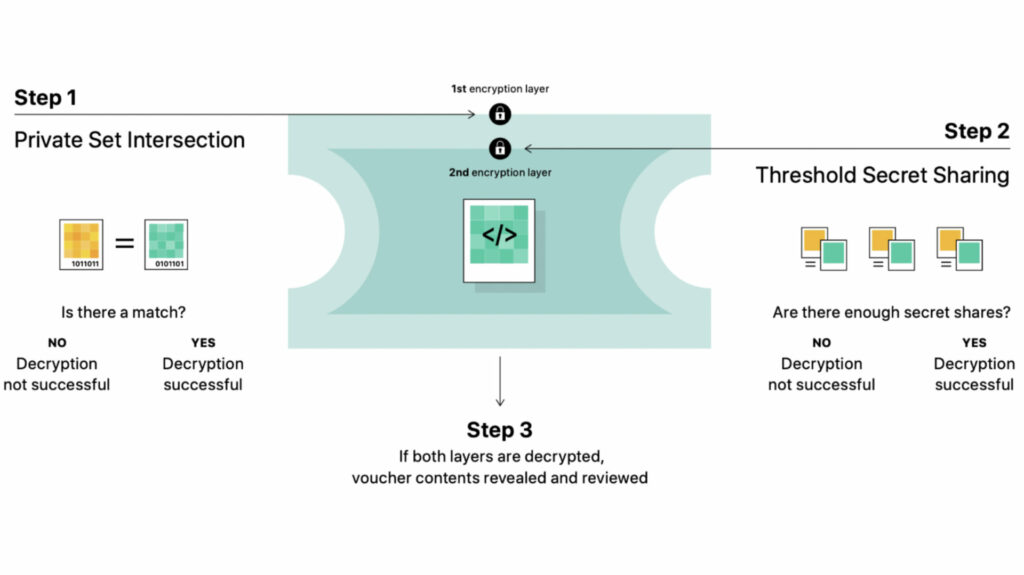

Au-delà des aspects géopolitiques, Apple précise que d’autres garde-fous techniques existent. Premièrement, les utilisateurs et utilisatrices seront prévenus qu’un tel outil est présent sur leurs systèmes et pourront toujours désactiver la synchronisation iCloud, rendant l’outil caduc puisque seules les photos envoyées sur le web feront l’objet d’un traitement.

La garantie 100 % n’existe pas

La vérification humaine effectuée en bout de course, en cas de problème, offre un dernier filet de sécurité. Apple assure ne pas travailler directement avec les autorités, préférant être en contact avec des associations.

Dans le domaine, le risque zéro n’existe pas : aucune mesure ne peut garantir à 100 % que cet outil ne sera jamais détourné. Apple estime qu’en limitant la portée de NeuralMatch et en rendant le mécanisme le plus sophistiqué et complexe possible, les risques d’abus seront moindres. Le dossier est de caractère sensible. Même si Apple est généralement assez ferme sur le question de la protection de la vie privée, il faudra rester attentif au fonctionnement concret de ce futur outil et à la manière dont il sera mis en place.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !