L’étude se voulait tout à fait sérieuse. Acceptée le 28 décembre 2023, elle avait été publiée dans la revue scientifique Frontiers le 14 février 2024. Elle avait même été examinée par d’autres spécialistes des sciences, selon le principe de l’évaluation par les pairs (peer reviewed). Seulement, voilà : le 16 février, le papier a été rétracté.

Que s’est-il donc passé pour qu’en l’espace deux jours, les travaux de trois chercheurs chinois (Xinyu Guo, Dingjin Hao et Liang Dong) soient ainsi rejetés ? Un problème de méthodologie ? Des résultats exagérés ? Des échantillons insuffisamment représentatifs ? En réalité, c’est manifestement un problème d’illustration.

Midjourney pour illustrer un papier scientifique

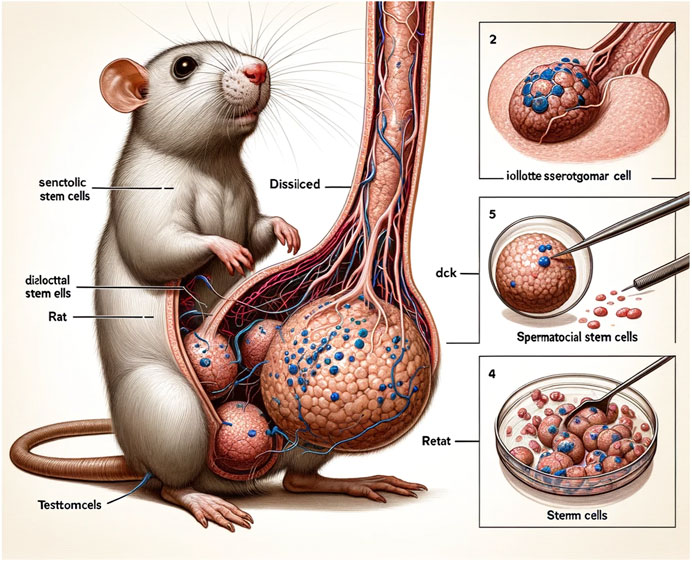

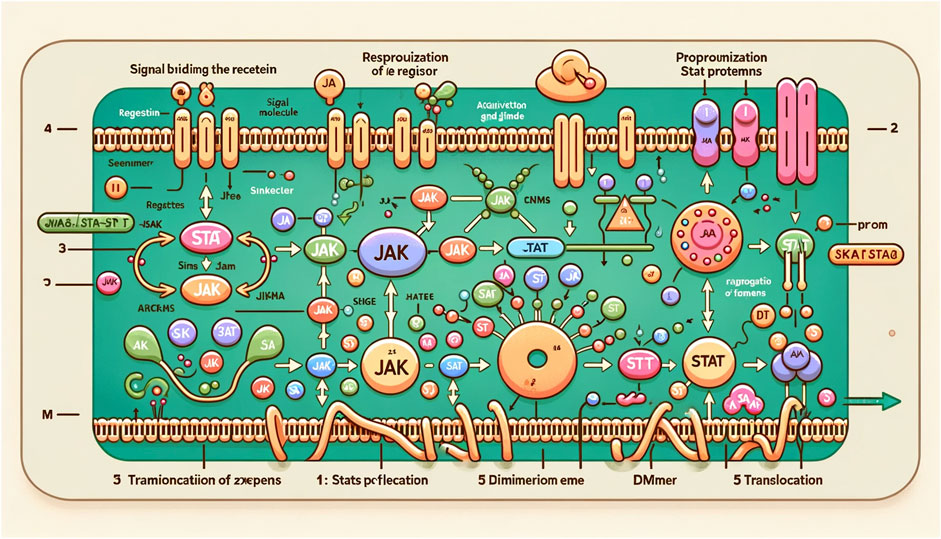

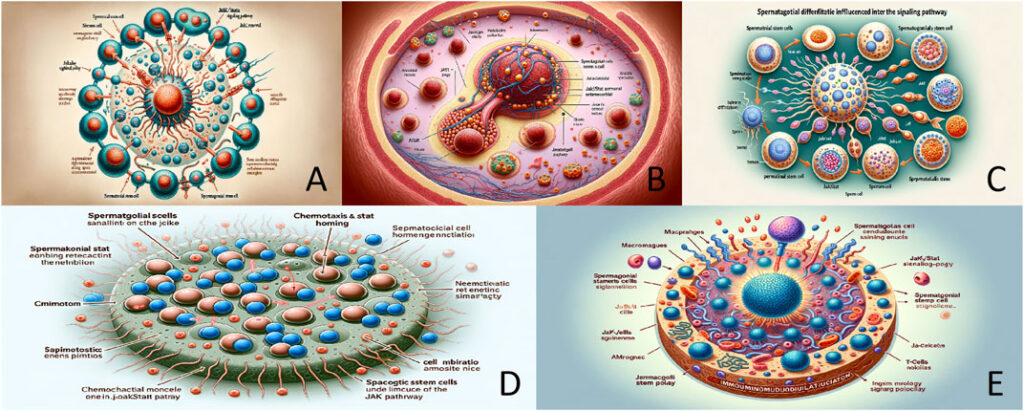

Il apparaît que les auteurs aient utilisé de l’intelligence artificielle (IA) pour générer tous les visuels de l’étude. Celle-ci en compte trois, dont deux s’avèrent être des collages de plusieurs images montrant certaines étapes de ce que l’étude entend expliquer. Précisément, l’outil utilisé pour créer ces illustrations est Midjourney.

L’étude, intitulée « Cellular functions of spermatogonial stem cells in relation to JAK/STAT signaling pathway » (Fonctions cellulaires des cellules souches spermatogoniales en relation avec la voie de signalisation JAK/STAT) n’est plus disponible sur Frontiers. À la place, deux messages de mise en garde sont visibles sur le site de l’éditeur.

Toutefois, on peut encore voir une copie prise le 15 février par le site Internet Archive. L’utilisation de l’IA n’était pas cachée : elle était bien mentionnée au fil du texte (« Les images de cet article ont été générées par Midjourney », lit-on juste avant la première image). En revanche, cette précision n’a pas été répétée dans chaque légende.

On ignore si des images ont servi de base pour produire ces visuels. On ne sait pas non plus si des modifications ont eu lieu après la génération, par exemple avec un logiciel de retouche comme Photoshop, pour éditer telle ou telle partie. L’œil non exercé d’un profane en science ou en IA pourrait juger ces illustrations tout à fait crédibles.

Le type de prompt employé — c’est-à-dire l’instruction utilisée pour avoir un rendu — est également un mystère, comme le nombre d’essais requis pour arriver à ces résultats. On présume une adresse certaine dans la rédaction de la commande pour aboutir à de tels rendus et, en outre, qu’ils passent de toute évidence le cap du peer reviewed.

Du texte qui ne veut rien dire

Une observation plus attentive permet toutefois de déceler des défauts sur les images, en particulier au niveau du texte. Historiquement, Midjourney a toujours peiné à produire de l’écrit ayant du sens sur les images, même avec la récente version 6 — malgré tout, des progrès réels ont été observés ces derniers mois.

Ainsi, on peut voir des légendes qui n’ont pas beaucoup de sens, et c’est un euphémisme : « iollotte sserotgomar cell », « retat », « dck », « dissilced » « Tramioncatiion of zoepens », « Stats poflecation », etc. Certaines lettres ne sont d’ailleurs pas formées et il a fallu tenter de les deviner. Ailleurs, des termes formés intégralement ne veulent tout simplement rien dire.

Si l’on se réfère aux mentions se trouvant en bas de page sur le site, l’étude a été éditée par un chercheur indien, Amugam Kumaresan, travaillant pour l’institut national de recherche laitière (National Dairy Research Institute). Elle avait été également reçue par Frontiers le 17 novembre, avant la sortie en version alpha de Midjourney v6.

L’étude a été relue par une consœur indienne, Binsila B. Krishnan, rattachée à l’Institut national de nutrition et de physiologie animales (National Institute of Animal Nutrition and Physiology) et Jingbo Dai, de l’ONG américaine Northwestern Medicine. Ces soucis de légende n’ont visiblement pas été vus ou jugés graves.

Quant aux responsables de l’étude, Xinyu Guo et Dingjun Hao officient à l’hôpital de Hong Hui, au département de chirurgie de la colonne vertébrale. Ils interviennent aussi à l’université Jiaotong de Xi’an. Liang Dong, lui, est affilié à ce même hôpital.

Dans une première notice d’avertissement, Frontiers a déclaré le 15 février « déclare avoir connaissance de problèmes […]. L’article a été retiré pendant qu’une enquête est menée et cet avis sera mis à jour en conséquence après la conclusion de l’enquête ». Le 16, la décision est tombée, avec le retrait pur et simple de ces travaux.

« L’article ne répond pas aux normes de rigueur éditoriale et scientifique de Frontiers in Cell and Development Biology », est-il expliqué. Ce sont bien les « inquiétudes soulevées quant à la nature des chiffres générés par l’IA » qui ont abouti à cette issue, après des signalements qui ont été remontés à la rédaction de la revue par une partie du lectorat.

Des règles sur l’usage de l’IA dans les sujets scientifiques

Dans ses lignes directrices pour les auteurs, Frontiers fournit des règles pour encadrer l’usage des technologies en IA (ChatGPT, Jasper, Dall-E, Stable Diffusion, Midjourney, etc.) pour « écrire et éditer des manuscrits » que des scientifiques souhaitent faire publier. Celles-ci incluent des obligations en matière de transparence, d’exactitude et de lutte anti-plagiat.

L’auteur est responsable de la vérification de l’exactitude factuelle de tout contenu créé par la technologie d’IA générative, ajoute Frontiers. « Les illustrations produites ou éditées à l’aide d’une technologie d’IA générative doivent être vérifiées pour s’assurer qu’elles reflètent correctement les données présentées dans le manuscrit. »

Dans ce scénario, « cette utilisation doit être reconnue dans la section des remerciements du manuscrit et dans la section des méthodes si applicable. Cette explication doit énumérer le nom, la version, le modèle et la source de la technologie d’IA générative ». Des éléments qui n’ont visiblement pas été renseignés sur la page.

Enfin, Frontiers demande également aux auteurs de transmettre tous les prompts. Cela, afin de savoir de quelle manière le contenu artificiel figurant dans une étude, quel qu’il soit, a été produit. Mais ici aussi, l’étude semble faire l’impasse sur ces éléments, contrairement à une autre, beaucoup plus transparente.

L’étude « Group trust dynamics during a risky driving experience in a Tesla Model X »(Dynamique de confiance en groupe lors d’une expérience de conduite risquée dans une Tesla Model X), également publiée sur Frontiers et peer reviewed, utilise aussi des images par IA. Mais les indications sont plus nombreuses et plus nettes.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !