Il est désormais quasiment certain qu’à partir de 2020, les voitures totalement autonomes commenceront à être commercialisées et circuleront sur les routes. C’est déjà presque le cas avec l’Autopilot de Telsa que nous avions testé, même si le constructeur s’assure toujours que le conducteur reste attentif et soit en capacité de reprendre le volant à tout moment en cas d’urgence. Mais plus l’humain laissera le volant à la machine, plus la faculté de cette dernière à prendre des décisions posera des questions éthiques, et juridiques — voir à ce sujet notre compilation sur le droit et l’éthique des robots.

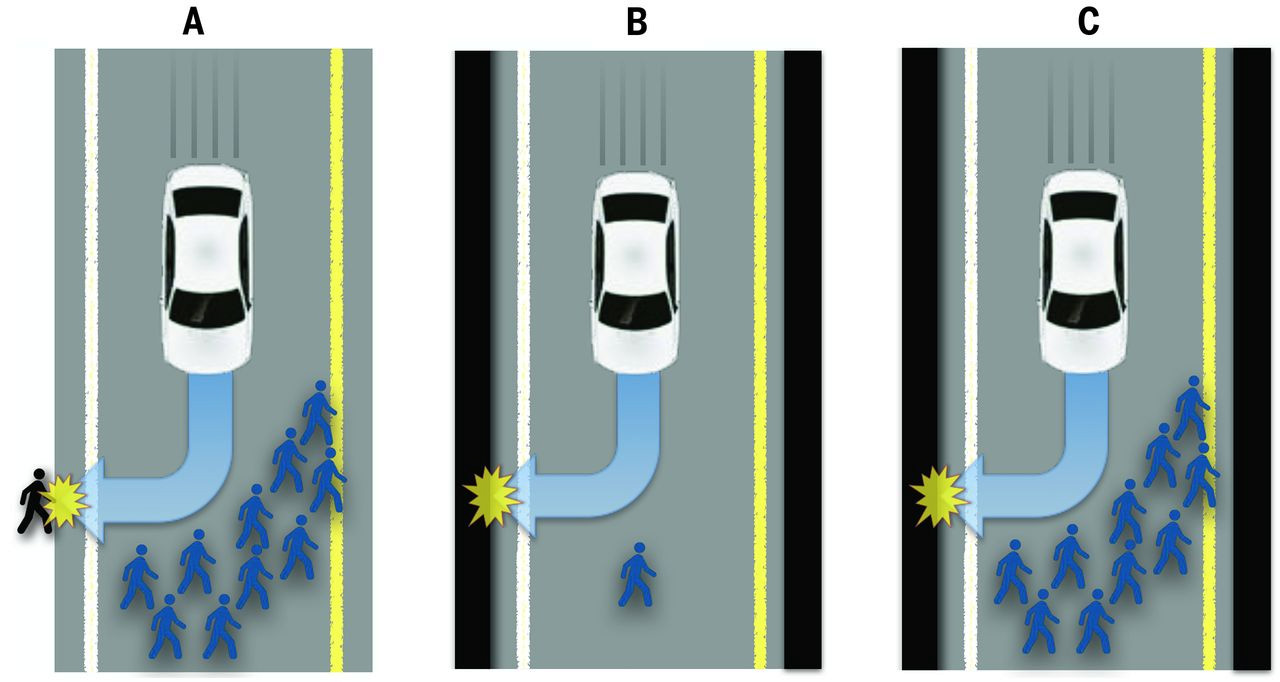

Imaginez en effet que vous soyez à bord d’un véhicule normalement lancé sur la route à 100 km/h, qui double une moto occupée par deux passagers au moment où un enfant surgit de nulle part et traverse brutalement la route par la gauche. Réalisant son geste, l’enfant reste tétanisé. Si votre voiture continue d’avancer, l’enfant sera percuté, et mourra. Si elle se déporte à droite, elle percutera la moto et les deux passagers pourraient mourir. Si la voiture se jette contre un arbre à gauche, elle peut éviter l’enfant et la moto, mais c’est vous qui mourrez. Quel choix faut-il opérer ?

Une option pourrait être proposée qui permette à chacun de choisir si l’on préfère sacrifier sa propre vie ou celle d’autrui

Pour apporter une réponse, une équipe de chercheurs franco-américaine a publié la semaine dernière dans Science les fruits d’une étude, qui montre toute la difficulté morale et psychologique du sujet. Ils ont interrogé 2 000 personnes et comme le rapporte le Huffington Post, quand on leur demande quoi faire dans l’absolu, « la majorité des sondés pensent que l’algorithme doit être conçu dans une logique utilitariste et doit donc sacrifier son conducteur pour sauver plusieurs personnes ». Mais « quand les chercheurs ont demandé aux sondés s’ils achèteraient une voiture autonome programmée pour sacrifier le passager afin de sauver le plus grand nombre, les réponses étaient en grande majorité négatives ».

« C’est une idée terrifiante, de posséder un objet programmé pour nous tuer. Il n’y a pas de précédent », note Jean-François Bonnefon, professeur à l’école d’économie de Toulouse, et co-auteur de l’étude. Pour les chercheurs, il y a donc un paradoxe supplémentaire. Il est acquis aujourd’hui que grâce à leurs capteurs infatigables et à leurs réflexes imbattables, les voitures autonomes feront certainement moins de morts que les voitures conduites par des humains, ce qui pourrait même amener à interdire aux êtres humains de conduire. Mais pour que la voiture autonome soit adoptée massivement, il faudra éviter de dire aux clients qu’elle est programmée pour sacrifier le propriétaire, et donc éviter de l’imposer.

L’option paramétrable : une solution réaliste ?

D’où une autre question, qui n’est pas abordée : faut-il faire de la mort programmée une option du tableau de bord, et est-ce réaliste ?

Certains pourraient en effet prétendre que ce n’est au fond ni au constructeur, ni au législateur de décider qui sacrifier dans un tel cas, mais que cela doit relever d’une décision du propriétaire ou de l’utilisateur de la voiture autonome. Dans ce cas, une option pourrait être proposée qui permette à chacun de choisir si l’on préfère sacrifier sa propre vie ou celle d’autrui. En cas d’accident, il serait alors beaucoup plus simple de déterminer la responsabilité civile et pénale, puisque c’est l’utilisateur qui a choisi de demander à la machine de tuer pour se préserver.

Mais alors, comment élaborer l’option ? Faut-il qu’elle soit à choix unique, ou faut-il différents niveaux de profondeur dans l’algorithme, par exemple pour dire qu’il est acceptable de tuer une femme qui traverse sans regarder, mais que ça devient inacceptable s’il s’agit d’une femme enceinte ? Ou pour signaler au robot que se sacrifier soi-même n’est acceptable qu’au delà d’un certain nombre d’autres personnes à épargner, et laisser le champ libre pour définir le seuil ?

La question est probablement l’une des plus passionnantes posées aux spécialistes de l’éthique, d’autant qu’elle n’est plus seulement théorique, mais devient extrêmement concrète et pragmatique. Il faudra très rapidement apporter des réponses pour savoir, qui de l’ingénieur ou du juriste de Google, du législateur, du propriétaire ou de l’utilisateur, doit savoir qui sacrifier dans une telle situation.

Si vous souhaitez vous « amuser » à répondre à de telles questions, les chercheurs ont créé un site dédié pour interroger les internautes.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !