Il n’y a même plus besoin de gribouiller quoi que ce soit pour générer des paysages très réalistes grâce à l’intelligence artificielle : désormais, quelques mots suffisent pour produire des vues naturelles, comme un rivage, des montages ou bien des monts et vallées. Cette performance est permise grâce à de nouvelles avancées en matière d’IA chez Nvidia, avec son outil GauGAN.

GauGAN ? C’est un nom qui est évidemment un clin d’œil au peintre postimpressionniste Paul Gauguin. Mais c’est surtout une manière de rappeler le fonctionnement de son outil, car GAN est l’acronyme de réseau antagoniste génératif, generative adversarial network en anglais (GAN). Il s’agit d’une méthode d’apprentissage non supervisée conçue par l’informaticien Ian Goodfellow.

L’idée est de faire appel à deux GAN pour qu’ils coopèrent de façon à atteindre un certain résultat. Le premier génère les visuels, tandis que le second, appelé le « discriminateur », se charge de les évaluer. Le « discriminateur » a reçu un entraînement avec de l’apprentissage profond — une technique qui consiste à nourrir l’IA avec des données préalables. Il « sait » donc à quoi les visuels doivent ressembler.

Tapez du texte, obtenez une image

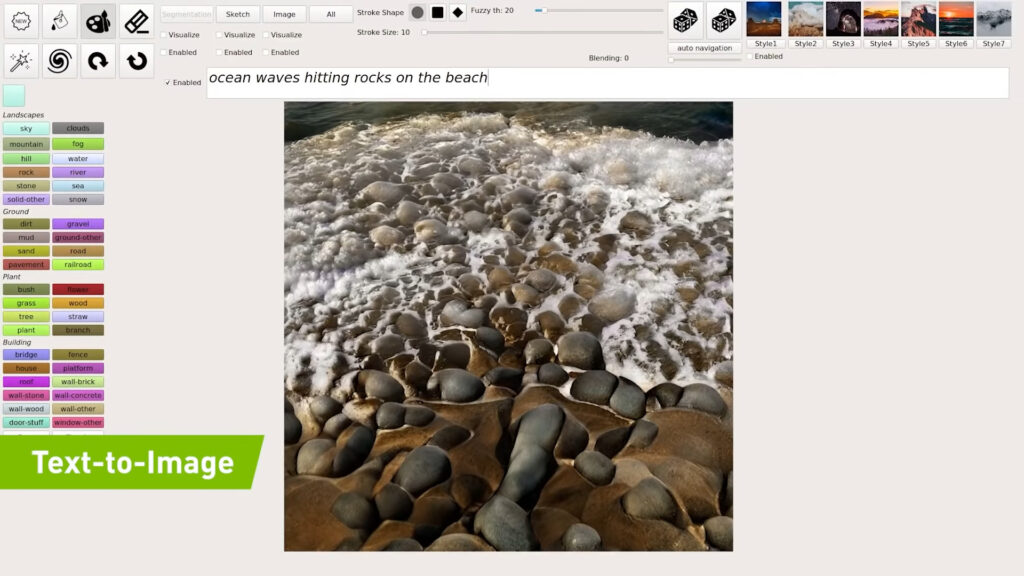

C’est sur cette base que Nvidia a itéré, de façon à pouvoir intégrer la prise en charge du texte. C’est ce que l’entreprise américaine développe dans une actualité publiée le 22 novembre, en évoquant GauGAN 2. Avec cet outil, que les internautes peuvent tester sur un site dédié, il est possible de générer un paysage en le décrivant avec des mots et, si besoin, de le compléter avec des gribouillis.

« Grâce à la polyvalence des invites textuelles et des croquis, GauGAN2 permet aux utilisateurs de créer et de personnaliser des scènes plus rapidement et avec un contrôle plus fin », se félicite Nvidia, qui note que sa démo est « l’une des premières à combiner plusieurs modalités — texte, segmentation sémantique, croquis et style — dans un seul cadre GAN. »

La vidéo de démonstration est évidemment très spectaculaire : au fil de la frappe et de l’ordonnancement des mots entre eux, le visuel photoréaliste change pour retranscrire la demande. Dans les faits, l’outil, lorsqu’on l’a testé, ne fonctionne pas en temps réel : il faut cliquer sur un bouton, une fois sa phrase inscrite (en anglais, mais le site semble aussi comprendre le français), pour voir le résultat.

« Le modèle d’IA de GauGAN 2 a été entraîné sur 10 millions d’images de paysages de haute qualité à l’aide du supercalculateur Nvidia Selene, un système Nvidia DGX SuperPOD qui figure parmi les 10 supercalculateurs les plus puissants du monde », pointe Nvidia. Le site précise que le réseau neuronal a aussi appris le lien entre les mots et les images auxquelles ils correspondent, comme « hiver », « brumeux » ou « arc-en-ciel ».

Si l’on sort des paysages, GauGAN 2 apparaît perdu et son interprétation d’un texte écrit devient aléatoire — mais cela peut donner, pour le coup, des visuels parfois fantastiques ou oniriques. On a voulu lui faire dessiner un mouton, mais le réseau semble ne pas savoir ce que c’est. Cependant, il suffirait de l’entraîner en montrant à l’un des deux GAN des millions de photos de mouton.

Source : Nvidia

Les travaux de Nvidia dans le domaine de l’intelligence artificielle l’ont déjà amené à créer autre chose que de jolis paysages. L’entreprise a procédé à des démonstrations sur des visages particulièrement réalistes, mais qui n’existent pas. Nvidia a même cloné virtuellement son PDG lors d’une conférence en août 2021, en mobilisant d’importants moyens techniques.

Ces travaux, très spectaculaires, ouvrent des perspectives à la fois enthousiasmantes et inquiétantes. Les solutions esquissées par Nvidia avec GauGAN pourraient avoir d’évidents débouchés dans les jeux vidéo, le cinéma, l’animation ou les séries, en association avec le travail des des designeurs. Mais on peut aussi imaginer des utilisations déplaisantes, que ce soit pour de la désinformation ou avec les deep fakes.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !