Avec son Vision Pro début 2024, Apple sait probablement qu’il n’est qu’au tout début de la révolution de l’informatique spatiale.

Le 6 décembre 2023, Google a dévoilé Gemini, son nouveau modèle de langage ultra-intelligent conçu pour être le cerveau de tous ses futurs produits et services. Présenté comme « la première intelligence artificielle multimodale », Gemini est capable de traiter du texte, des images et du son simultanément, comme s’il s’agissait d’une seule information. De quoi en faire un « allié » pour l’être humain, plutôt qu’un simple service numérique.

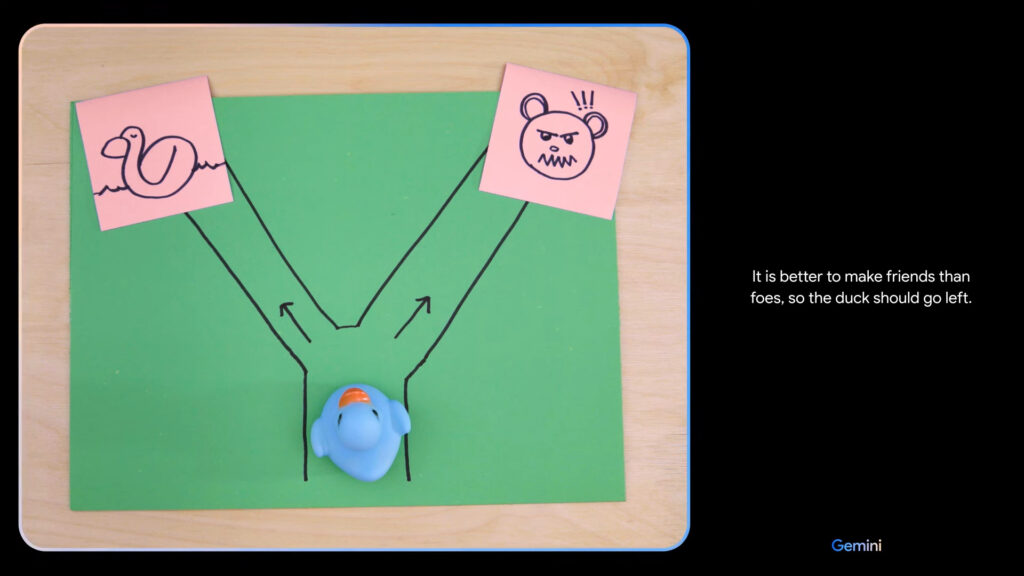

Dans une vidéo de 6 minutes et 22 secondes, Google montre Gemini en action. On y découvre une IA capable de commenter tout ce qu’elle voit, d’imiter la logique humaine, de plaisanter, de deviner ce qu’il va se passer dans une vidéo et de jouer à des jeux. L’émergence de casques de réalité mixte en 2024 pourrait donner du sens à cette démonstration.

Gemini a l’air incroyable

Avec une intelligence artificielle dotée de « yeux », Google a de quoi bouleverser l’informatique moderne. Si sa première implémentation dans Bard sera plus classique, avec un chatbot similaire à ChatGPT, le potentiel maximal de Gemini pourra être débloqué grâce à sa super-multimodalité, qui lui permet de comprendre ce qu’il voit.

Dans sa vidéo, Google montre divers exemples :

- Gemini réagit à un dessin en temps réel et commente chaque avancée, en essayant de deviner ce qu’il va se passer. Il peut aussi partager son étonnement lorsqu’il comprend ce que lui cachait le dessinateur.

- Gemini donne des cours de langue, pour apprendre à traduire des mots en expliquant leur étymologie.

- Gemini invente un jeu sur un planisphère et fait des blagues en fonction de ce que fait son utilisateur.

- Gemini joue avec son utilisateur, en devinant dans quelle main il cache une pièce et peut réagir avec humour si l’utilisateur l’a trompé.

- Gemini peut trouver les points communs entre deux objets.

- Gemini peut répondre à un dilemme en analysant une situation (quelle route prendre par exemple).

- Gemini peut prédire la suite d’une vidéo.

- Gemini peut inventer de la musique à partir d’une situation qui lui est montrée.

Le point commun entre toutes ces démos : l’utilisateur ne parle pas ou peu. Gemini commente juste ce qu’il voit et devine ce qu’il faut faire. L’utilisateur peut aussi lui poser des questions, comme s’il s’adressait à un vrai humain. Bluffant.

Sur quel appareil fonctionnera Gemini Ultra ?

Ce que Google ne dit pas est le matériel utilisé. Imagine-t-on vraiment quelqu’un tenir son smartphone pour filmer un dessin pendant plusieurs minutes, tout en parlant à haute voix ? En ouvrant « l’ère de Gemini », Google introduit théoriquement celle du post-smartphone. Ses intentions ne sont sans doute pas celles-là pour le moment, mais la porte est ouverte pour la première fois

Avec l’annonce de Gemini, Google nous fait différemment réfléchir à certains produits. Le Ai Pin de Humane, qui consiste en un pin avec une caméra accrochée sur la poitrine, aurait du sens pour parler à Gemini. Autre comeback : les Google Glass, version 2024, seraient nettement plus productives.

Le produit le plus évident pour une telle révolution technologique est le casque de réalité mixte, poussé par Apple avec son Vision Pro. Si la marque californienne est distancée sur le terrain de l’IA, son Vision Pro semble le produit idéal pour une intelligence artificielle capable de commenter ce qu’elle voit. Un Siri dopé à Gemini donnerait une nouvelle dimension au produit d’Apple, en le transformant en un super-cerveau humain.

En attendant les annonces d’Apple en juin 2024, qui pourrait annoncer son propre modèle de langage, Google a une carte à jouer. Allié à Samsung et à Qualcomm pour le développement d’un casque de réalité mixte concurrent de celui d’Apple, Google devrait lancer un Android XR en 2024. Si ce système d’exploitation embarque une version de Gemini capable de transformer le produit en une super-IA digne d’Iron Man, alors Google pourrait tenir sa revanche sur les Google Glass.

Attendu d’ici mars 2024, l’Apple Vision Pro semble bien parti pour se transformer très rapidement. visionOS 2.0 n’aura probablement rien à voir avec la première version, si Apple réussit à emboiter le pas de l’IA générative. Ce n’est pas gagné, mais cela semble inévitable à « l’ère de Gemini ».

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !