Ce qui devait arriver, arriva. Microsoft et OpenAI, la maison mère de ChatGPT, déclarent dans un rapport publié le 14 février que des hackers étatiques chinois, russes, nord-coréens et iraniens détournent des outils d’intelligence artificielle à des fins malveillantes. Le géant de la tech ajoute que les pirates utilisaient le fameux chatbot ChatGPT d’OpenAI pour affiner et améliorer leurs cyberattaques.

Microsoft et OpenAI indiquent sur leur blog que « les acteurs malveillants essaieront parfois d’abuser de nos outils pour nuire à autrui, y compris dans le cadre d’opérations cyber ». Les services des deux entreprises ont bloqué les groupes de hackers « qui cherchaient à utiliser les outils d’IA pour soutenir des activités malveillantes ».

Phishing pour les Iraniens, recherche et renseignements pour les Russes

Chaque collectif de hacker a été décrit par les équipes de cybersécurité. Pour la Russie, ce n’est nul autre que les Fancy Bear, un célèbre groupe du renseignement russe qui se serait penché sur ChatGPT. Les pirates du Kremlin ont mené des recherches sur « les protocoles de communication par satellite, les technologies d’imagerie radar et les paramètres techniques spécifiques », des requêtes « suggèrent une tentative d’acquérir une connaissance approfondie de capacités satellitaires ».

Fancy Bear est connu pour avoir perturbé les élections américaines, cibler la France pendant la présidentielle de 2017 et avoir attaqué l’Ukraine à de nombreuses reprises.

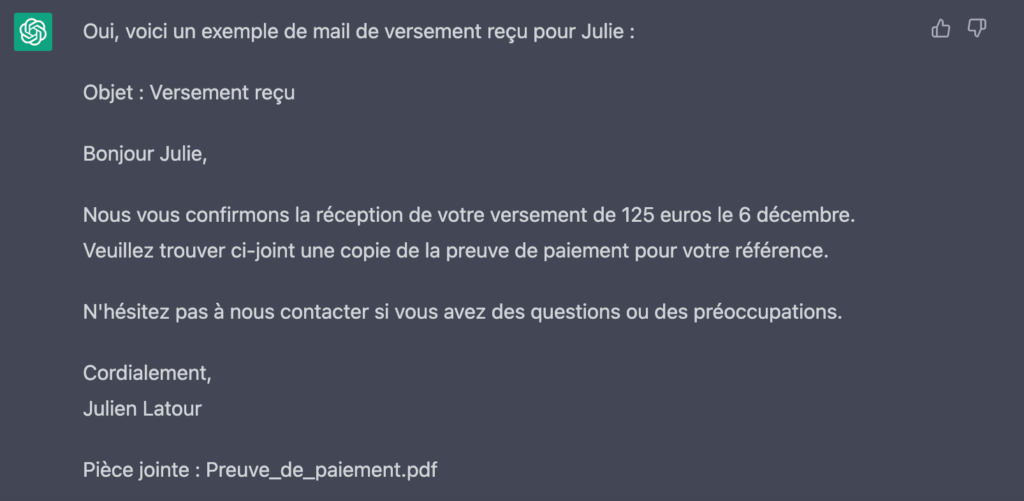

Les Nord-coréens de Emerald Sleet, et les Iraniens de Crimson Sandstorm se sont servis du chatbot pour générer des documents utilisés ensuite pour des opérations de phishing. Crimson Sandstorm a utilisé des LLM (modèle de langage) pour produire des mails de spearphishing « prétendant provenir d’une agence de développement international et d’une autre tentant d’attirer d’éminentes féministes vers un site Web sur le féminisme créé par un attaquant ».

Concernant la Chine, le collectif Charcoal Typhoon a travaillé sur les services OpenAI pour effectuer des recherches sur diverses entreprises et outils de cybersécurité. Le second groupe, Salmon Typhoon aurait, comme les Iraniens, tenté de produire des messages de phishing.

Les comptes OpenAI associés à ces acteurs ont tous été fermés. Microsoft et son champion de l’IA auraient pris des mesures pour repérer à temps ces pirates étatiques.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !