Cela fait désormais plusieurs années que Facebook multiplie les outils pour tenter d’éviter les suicides de ses utilisateurs les plus fragiles, que ce soit à l’aide d’un chat lancé en 2011 ou grâce à un bouton de prévention du suicide à l’international qui permet aux utilisateurs d’alerter le réseau social sur un comportement jugé inquiétant. La plateforme est particulièrement attendue dans ce domaine après les cas de suicide en direct recensés sur son outil Facebook Live ces derniers mois.

Désormais, le réseau social de Mark Zuckerberg teste — exclusivement aux États-Unis pour l’instant — une intelligence artificielle chargée d’identifier les messages jugés inquiétants, qu’il s’agisse des publications d’utilisateurs concernés ou des réactions laissées en commentaires par leurs amis. L’alerte peut être déclenchée par l’IA à la vue d’un commentaire qui demande à un utilisateur : « Est-ce que tout va bien ? » ou encore « Je m’inquiète pour toi ».

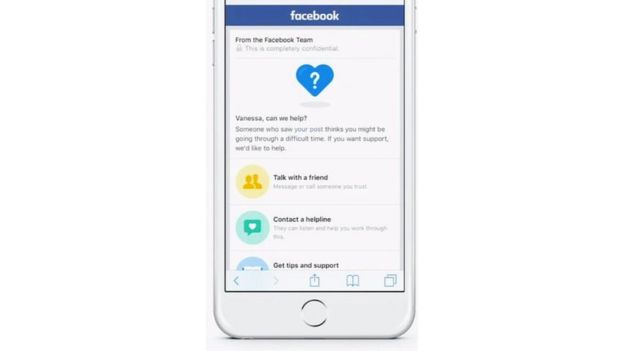

Une fois identifié comme tel, le message est étudié par une équipe de Facebook qui propose si besoin à la personne concernée des conseils pour se tourner vers un spécialiste ou de contacter un ami de leur liste de contacts.

Des mesures également déployées sur Facebook Live

Vanessa Callison-Burch, une responsable de Facebook interviewée par BuzzFeed, explique que l’IA se révèle souvent plus pertinente que les humains lorsqu’il est question d’identifier un vrai motif d’inquiétude : « L’IA est plus précise que les signalements de suicide ou d’auto-mutilation réalisés par les utilisateurs. Nous avons plus tendance à déployer notre aide aux personnes dont le signalement a été effectué par l’IA que par celles révélées par un humain. »

Facebook s’engage aussi pour les utilisateurs de sa plateforme vidéo en direct, Facebook Live. Maintenant, lorsque quelqu’un partage, grâce à l’option dédiée, son « inquiétude » au sujet du diffuseur de la vidéo, Facebook lui demande comment aider ce dernier et transmet l’information à son équipe dédiée pour un examen rapide.

John Draper, directeur d’une association de prévention contre le suicide, apprécie l’initiative mais la juge perfectible : « Nous avons discuté avec Facebook [de la possibilité de faire plus que donner de simples conseils]. Plus nous pouvons mobiliser le réseau d’une personne en situation de détresse, plus elle aura de chances d’être aidée. La question reste de savoir comment le faire sans se montrer intrusif. »

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !