Le 21 juillet 1969, l’histoire s’est écrite ainsi. Le module lunaire Eagle s’est posé sur la surface de la lune dans la soirée (vers 21 heures, à Paris) et Neil Armstrong, vêtu de sa combinaison spatiale, a descendu l’échelle avant de poser le pied sur le sol. C’est alors qu’il a prononcé sa phrase restée célèbre : « C’est un petit pas pour l’homme, mais un bond de géant pour l’humanité ».

L’uchronie par l’informatique

Mais si les choses avaient été différentes ? L’art a depuis longtemps dépeint d’autres récits. Dernier exemple en date, For All Mankind, une série télévisée produite pour Apple TV+ qui se place dans un monde où ce sont les Soviétiques, et non les Américains, qui ont été les premiers à marcher sur la Lune. Et aujourd’hui, ces uchronies peuvent même être générées grâce aux deepfakes.

Le deepfake est un mot-valise entre une technique d’apprentissage automatique utilisée en intelligence artificielle, le deep learning, et fake, qui veut dire faux, contrefaçon, en anglais. Le terme désigne les vidéos (deepfakes) dans lesquelles un visage est remplacé par un autre grâce aux algorithmes, pour donner l’illusion que c’est quelqu’un d’autre qui est en scène. Cela marche aussi avec les gestes, le corps et la voix.

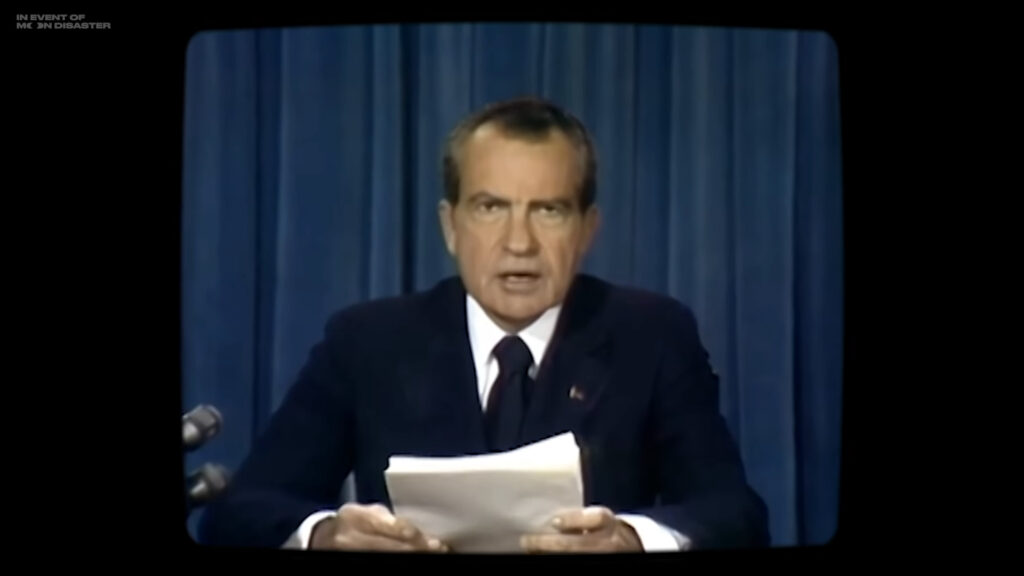

C’est justement ce que propose le projet In Event of Moon Disaster, en manipulant des images d’archive pour imaginer ce qui aurait pu se passer si jamais la mission Apollo 11 avait tourné au désastre. Car il s’avère que le gouvernement américain avait préparé un discours officiel pour Richard Nixon, alors président, au cas où il aurait fallu annoncer à la nation la perte des astronautes.

Une trace de ce discours existe. Relativement bref, il a été écrit par le rédacteur William Safire afin de fournir à la Maison-Blanche du contenu en cas de scénario catastrophe. Il donnait aussi des indications sur la conduite à tenir à l’égard des veuves et des familles, ainsi que sur le rite funéraire à observer, en l’occurrence celui qui est d’ordinaire suivi en cas de sépulture en mer.

Évidemment, ce discours n’a jamais été prononcé par le président américain. Mais l’outil informatique peut vous faire croire que c’est le cas — ce qui est tout à la fois spectaculaire comme prouesse technique et inquiétant quant aux manipulations et aux tromperies que cela peut induire, avec tout ce qu’il est possible d’imaginer comme réécriture historique et dérive complotiste.

Une piqûre de rappel contre la manipulation

Un point sur lequel insistent d’ailleurs les auteurs de In Event of Moon Disaster. « Ce projet montre les dangers de la désinformation. Les deepfakes utilisent l’intelligence artificielle pour simuler des personnes faisant et disant des choses qu’elles n’ont jamais faites, généralement sans leur consentement », est-il expliqué à la fin de la vidéo, avant d’inviter le public à « vérifier ses sources ».

Ce « projet immersif vous invite à entrer dans cette histoire alternative et nous impose à tous de réfléchir à la façon dont les nouvelles technologies peuvent tordre, réorienter et obscurcir la vérité autour de nous », concluent les responsables de l’initiative. « En créant ce récit alternatif, le projet explore l’influence et l’omniprésence de la désinformation et des technologies dans notre société contemporaine ».

Pour aller plus loin, le site regroupe plusieurs articles, en anglais, sur les motivations qui ont poussé à donner naissance à ce projet, mais aussi sur des problématiques comme l’éducation aux médias à l’ère de la désinformation, les théories du complot autour de la Lune et de la conquête spatiale, des risques de manipulation causés par ces vidéos et de de la capacité de l’IA à contrer les trucages générés… par l’IA.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !