On ne compte plus les études, tribunes et éditos qui montrent à quel point l’outil de recommandation automatique de YouTube est l’un des plus dangereux du web. On le dit partial, vecteur de théories de complots dès qu’il en a l’occasion ou encore, « le plus grand outil de radicalisation ». La lecture automatique de vidéos similaires suggérées par YouTube a en effet une tendance à tomber très rapidement dans le désert de la pensée, où les conspirations les plus tordues côtoient des vidéos glauques adressées aux enfants. Le 25 janvier 2019, YouTube a enfin annoncé la fin de cette politique qui, peut-on le croire, lui rapportait du temps passé sur la plateforme et donc de l’argent.

« Nous allons réduire la recommandation automatique de contenus problématiques et de contenus qui peuvent désinformer les utilisateurs et leur causer du tort. Nous parlons de vidéos qui mettent en avant des cures miracles pour des maladies graves, qui disent que la Terre est plate ou qui avancent des théories absolument fumeuses sur des événements historiques comme les attentats du 11 septembre ». En d’autres termes, toutes ces vidéos qui tentent de réinformer et brouillent le discours scientifique ou les faits avérés sur des événements. Le problème est si prononcé qu’une récente enquête de BuzzFeed News a montré que l’algorithme pouvait amener, en 9 recommandations, d’une vidéo tout à fait neutre et légitime sur le Congrès américain à un discours de haine conspirationniste sur les migrants.

YouTube, ni censeur, ni conspi

C’est un grand pas pour YouTube, mais qui n’en reste pas moins difficile : ce faisant, la plateforme se reconnaît, pour la première fois, arbitre du contenu qui est publié. Elle ne se pose pas en censeur et ne supprimera pas de sa plateforme ces vidéos qui resteront accessibles, ne contrevenant pas aux règles. Mais, en garantissant cette liberté d’expression, YouTube se donne aussi l’opportunité de mieux informer ses utilisateurs et estime qu’il est de son devoir de ne pas laisser son algorithme recommander n’importe quoi.

Pour cette phase de transition, d’ailleurs, le contrôle de l’algorithme sera partiellement remis entre les mains d’employés humains, formés à détecter les vidéos qui entrent dans le cadre de cette nouvelle politique. Cela permettra à l’algorithme de s’entraîner sur une nouvelle base. Évidemment, YouTube ne clarifie pas avec précision ce qu’il considérera comme une vidéo conspirationniste ou comment il identifiera, à terme, ce type de vidéo.

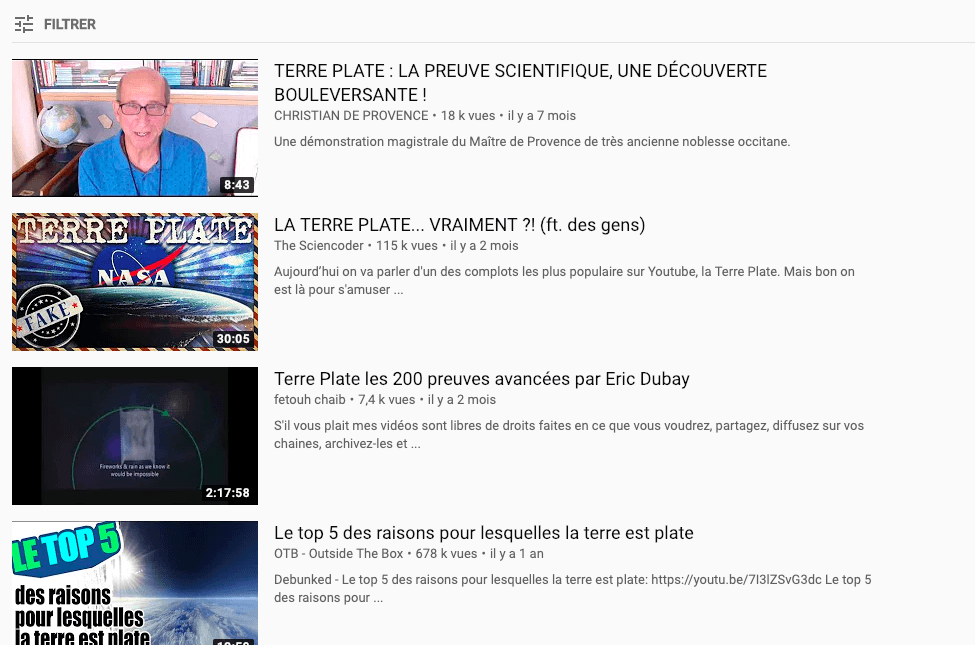

Donner les règles du jeu précises permettrait en effet à ces vidéastes de les contourner. Mais ce faisant, YouTube s’expose également à des critiques légitimes de la part de vidéastes qui se trouveraient dévalorisés pour des vidéos mal identifiées. Le problème est nécessairement difficile à résoudre et on ne peut, aujourd’hui, qu’attendre de voir comment la solution de YouTube se comportera. Et on ne peut que se réjouir, quand on voit qu’aujourd’hui, aucune vidéo scientifique sur la rotondité avérée de la Terre n’est mise en avant quand on recherche « terre plate » sur la plateforme.

L’expérience de YouTube commencera aux États-Unis et, si elle fonctionne, sera déployée partout dans le monde.

Taper Terre Plate dans YouTube aujourd'hui n'amène aucune vidéo scientifique sur le sujet

Source : YouTube

Évidemment, la Société des Terre-Platistes a condamné la décision.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !