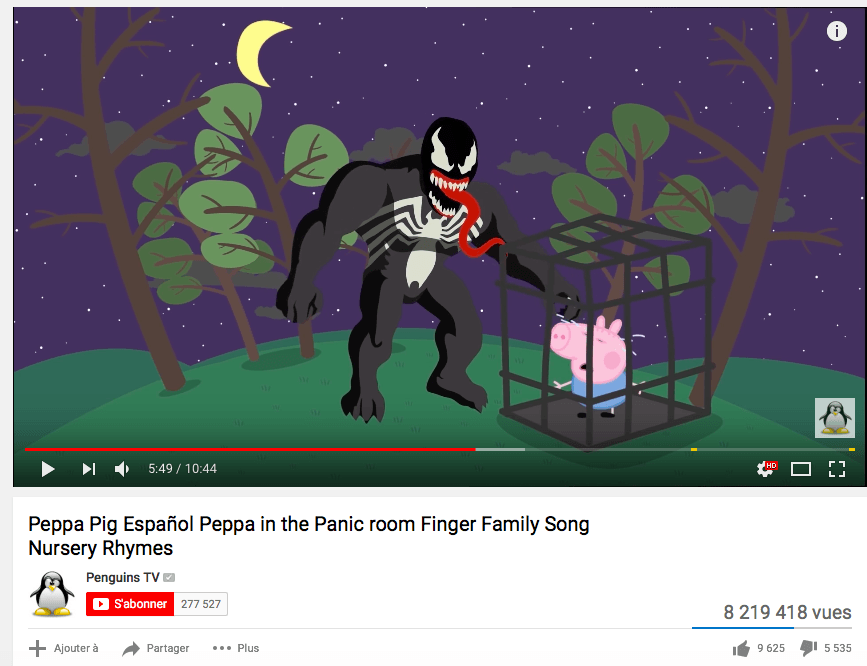

Pour mettre fin aux dérives liées à ses vidéos malsaines pour enfants — qu’il s’agisse de parodies de dessins animé à caractère violent comme sexuel ou encore de productions qui mettent en scène des mineurs dans des contextes perturbants –, YouTube compte faire appel à plus de 10 000 modérateurs en 2018.

Mais l’origine du problème ne vient pas tant du manque de main d’œuvre que des consignes qui sont données aux équipes actuellement en poste, à en croire BuzzFeed. Le site américain a en effet interrogé plusieurs prestataires chargés « d’entraîner » les algorithmes de la plateforme vidéo pour qu’ils fournissent les résultats de recherche les plus pertinents, en se basant sur un document en date d’avril 2017, non mis à jour malgré la polémique de ces derniers mois — qui a notamment provoqué le boycott de certains annonceurs.

Leur travail consiste notamment à noter les vidéos mises en ligne sur la plateforme pour évaluer leur qualité. Or, les consignes fournies par YouTube ont selon eux tendance à valoriser la forme au fond, en exigeant systématiquement d’attribuer des bonnes notes aux productions esthétiquement irréprochables : « Lorsqu’une vidéo est perturbante ou violente, on peut la signaler mais on doit malgré tout la qualifier de vidéo de grande qualité [selon des critères relevant de la qualité de la réalisation, de l’animation, etc.] »

La viralité au détriment de la pertinence ?

De son côté, la plateforme vidéo de Google reconnaît le travail fourni par ces prestataires mais minimise sa portée : « Nous faisons appel à ces [personnes] pour évaluer la qualité des résultats de recherche sur YouTube et nous assurer que les vidéos les plus pertinentes ressortent selon différents mots-clé. Mais [ces prestataires] ne déterminent pas le classement des contenus dans les résultats, ou s’ils violent nos conditions d’utilisation, sont supprimés, soumis à une limite d’âge et non monétisables. »

La plateforme souligne qu’une équipe dédiée est chargée de ce questions — alors que des modérateurs bénévoles ont déjà dénoncé le manque de soutien de YouTube en la matière. En pratique, ce système permet à ces vidéos malsaines de rester en ligne sur la plateforme — et même de gagner en visibilité, ce qui augmente leur nombre de vues et entretient ce cercle vicieux.

Bart Selman, un spécialiste de l’intelligence artificielle à l’université de Cornell, explique ainsi à BuzzFeed le paradoxe en vigueur, qui oppose directement les intérêts de YouTube et ceux du public désireux de préserver ses enfants de ce type de vidéos : « Les contenus controversés — que ce soit des vidéos, du texte ou des actualités — se partagent plus facilement, ce qui offre plus de vues, plus de présence sur la plateforme et donc plus de revenus. »

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !