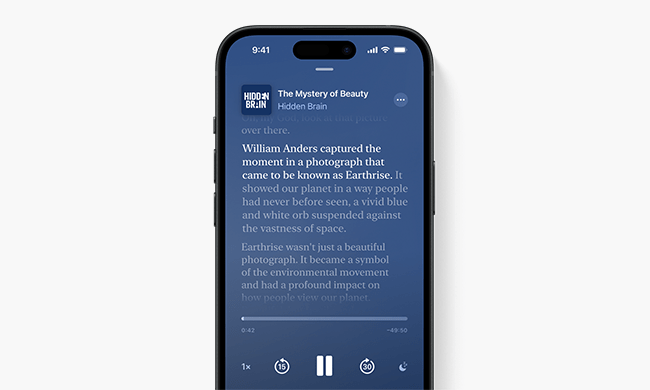

De prime abord, on pourrait trouver curieux de retranscrire par écrit un podcast. Pourquoi lire une conversation qui a été conçue pour être écoutée ? Cette option arrive pourtant dans Apple Podcasts, avec la mise à jour iOS 17.4 (pour l’instant disponible qu’en bêta).

En réalité, cette idée est bien pratique. Elle présente au moins deux atouts : le premier porte sur l’accessibilité, puisque les podcasts diffusés par le service de la firme de Cupertino pourront aussi être compris par les personnes sourdes et malentendantes, en leur donnant accès au texte généré automatiquement. La transcription prend à peine quelques secondes, selon Apple.

Le second facilite l’exploitation d’un épisode de podcast par les auditeurs et les auditrices. Vous voulez chercher un mot clé en particulier ? Podcasts le permet et vous dira s’il le trouve ou non. Si oui, l’application vous donne la possibilité de vous rendre pile à l’endroit du podcast où il est prononcé. Les journalistes, par exemple, apprécieront. Les personnes à la recherche d’un moment précis aussi.

Apple Podcasts gère le transcript en français

La retranscription écrite des podcasts repose sur un procédé bien connu, appelé reconnaissance automatique de la parole. On retrouve cette technique quand une personne pose une question à un assistant virtuel comme Siri. L’outil capte la parole, identifie les mots, les comprend, traite la demande et répond avec une voix de synthèse.

Cette option de transcription est transparente pour les auteurs et autrices de podcast. Apple précise toutefois que la qualité audio du fichier devra être de bonne facture pour que l’outil puisse fonctionner. Si besoin, il est possible de fournir le fichier texte soi-même, mais aussi d’apporter des corrections si des passages sont erronés.

Selon Apple, cette reconnaissance automatique de la parole parvient de toute évidence à distinguer ce qui relève des intervenants et ce qui vient d’un éventuel fond sonore, si jamais un chant est capté. « Les paroles de musique ne sont pas non plus affichées dans les transcriptions », est-il ainsi indiqué.

L’application Podcasts va être mise à jour globalement (170 pays et régions sont éligibles, d’après Apple), mais la prise en charge linguistique est bien plus resserrée. Pour le moment, quatre langues sont supportées : l’anglais, l’espagnol, l’allemand et le français. De quoi déjà couvrir un large nombre de locuteurs dans le monde. C’est aussi un premier pas vers la première IA générative d’Apple, attendue en juin.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !