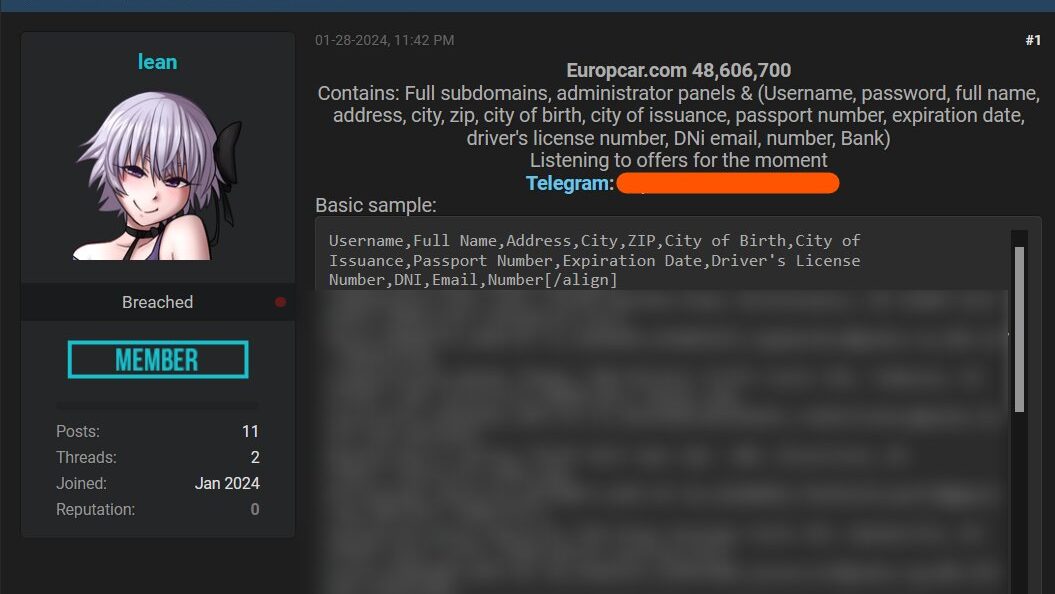

Fin janvier, un membre d’un célèbre forum de hackers revendique une cyberattaque contre le géant de la location de voiture EuropCar. L’utilisateur prétend avoir dérobé les informations personnelles de plus de 48 millions de clients d’Europcar et propose de les vendre aux plus offrants. Or la base de données aurait été complètement inventée selon l’entreprise. EuropCar a expliqué à de nombreux médias que l’enquête sur la violation de données n’a non seulement rien donné, mais aussi que les infos analysées par les équipes cyber auraient été générées par des outils d’intelligence artificielle.

Vincent Vevaud, porte-parole d’Europcar, a déclaré au média américain TechCrunch :

- « Le nombre d’enregistrements est erroné et ne correspond pas à celui de l’entreprise. »

- « Aucune de ces adresses électroniques n’est présente dans la base de données clients. »

- « Les données de l’échantillon sont probablement générées par ChatGPT (les adresses n’existent pas, les codes postaux ne correspondent pas, les noms et prénoms ne correspondent pas aux adresses électroniques, les adresses électroniques utilisent des TLD très inhabituels). »

Troy Hunt, expert cyber à la tête du site « Have I Been Pwned » pour vérifier les fuites, ajoute également sur X (ex-twitter) que « les adresses électroniques et les noms d’utilisateur ne ressemblent en rien aux noms des personnes correspondantes ».

Pourquoi inventer une base de données avec ChatGPT ?

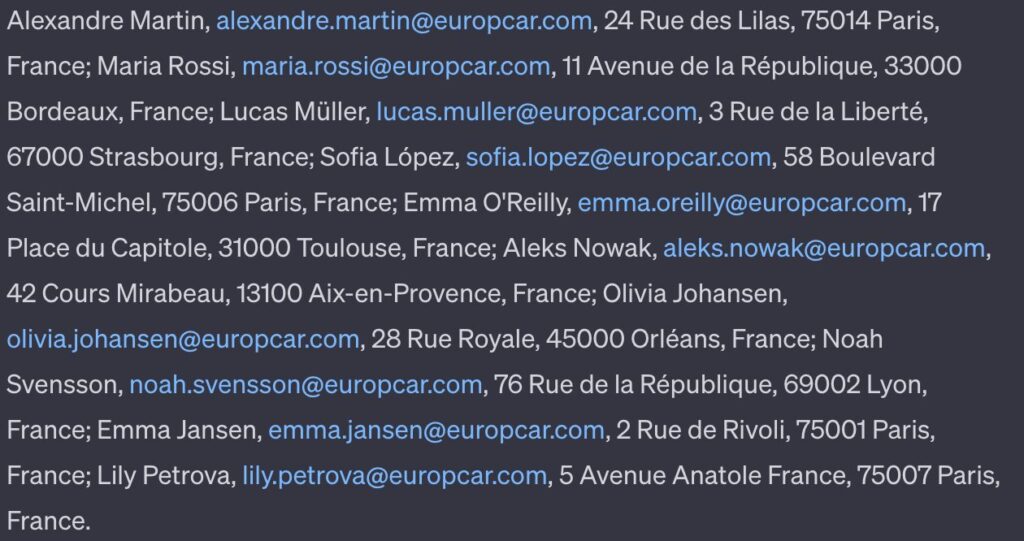

Nous avons demandé à ChatGPT de rédiger une base de données fictive d’EuropCar. Le résultat est plutôt convaincant, bien que les adresses soient très facilement vérifiables.

On ne peut deviner concrètement quel est l’objectif de l’auteur du post original. Il cherche peut-être simplement à escroquer les autres usagers du forum en vendant de fausses données. L’hypothèse la plus inquiétante serait que quelqu’un cherche à discréditer une entreprise en inventant une fuite de données. Ce procédé pourrait être répliqué à l’avenir et à mesure que les variants de chatbot intelligents se développent.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !