Comment faire évoluer au mieux l’intelligence artificielle et, par extension, les robots ? Pour Josh Tobin, l’un des scientifiques impliqués au sein d’OpenAI, la réponse est claire : « Les bébés naissent avec la capacité d’imiter ce que fait autrui [comme tirer la langue]. L’imitation permet aux humains d’apprendre rapidement de nouveaux comportements, nous aimerions que nos robots apprennent aussi de cette manière ».

OpenAI, le collectif fondé par Elon Musk en 2015 avec plus d’un milliard de dollars d’investissement afin de « faire avancer l’intelligence numérique de la manière qui serait la plus profitable à l’humanité, sans que ces recherches soient dictées par le besoin d’un retour sur investissement », recourt de fait à un algorithme original pour entraîner ses robots.

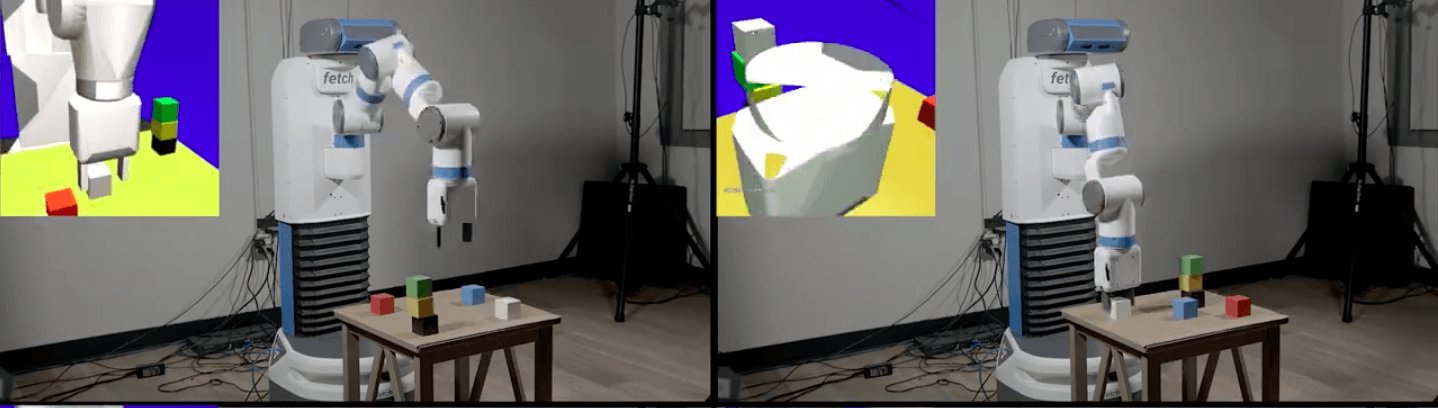

Dans une vidéo publiée mardi 16 mai sur Facebook, Josh Tobin détaille le fonctionnement de ce système qui permet au bras robotique d’OpenAI de reproduire une action accomplie par un humain après l’avoir vu accomplie une seule et unique fois grâce à l’enregistrement réalisé pendant une démonstration en réalité virtuelle par un porteur de casque HTC Vive.

Une tâche reproductible avec une gestuelle différente

Grâce au seul visionnage virtuel de cet enregistrement où son bras, reproduit en 3D, empile des cubes pour constituer une tour, le robot est ensuite capable d’imiter ce geste dans le monde réel. Une unique démonstration lui suffit pour reproduire la tâche, même lorsqu’il se trouve confronté à différentes configurations de départ sur la table située devant lui.

« Au terme de cet entraînement, le réseau est capable de retrouver les cubes dans le monde réel alors qu’il n’a jamais vu d’images [de ces cubes] extraites d’une véritable caméra » souligne Josh Tobin.

Concrètement, le système s’appuie sur deux réseaux de neurones complémentaires. Le premier — dit de « vision » — utilise les informations visibles dans sa caméra pour analyser l’environnement immédiat et situer les objets (en l’occurrence, les cubes). C’est à ce moment-là qu’intervient le deuxième réseau de neurones — d’imitation : il s’appuie sur l’enregistrement en VR, en déduit son objectif et les étapes indispensables pour l’accomplir à son tour. « Notre robot est maintenant capable d’accomplir cette tâche alors même que ses mouvements diffèrent nécessairement de ceux aperçus dans la démonstration » se réjouit Josh Tobin.

Il précise que cette technologie ouvre des possibilités assez larges : « Rien, dans notre système, n’est spécifique aux cubes. Il s’agit d’un prototype qui constituera la colonne vertébrale de l’ensemble de nos créations robotiques ». En clair, il pourrait bien s’agir d’une première étape pour permettre — par exemple — aux robots de reproduire facilement des tâches ménagères.

Nouveauté : Découvrez

La meilleure expérience de Numerama, sans publicité,

+ riche,

+ zen,

+ exclusive.

Si vous avez aimé cet article, vous aimerez les suivants : ne les manquez pas en vous abonnant à Numerama sur Google News.