C’est une affaire qui est en train de prendre une certaine ampleur aux États-Unis. Début décembre, il a été rapporté dans plusieurs médias américains que l’informaticienne éthiopienne Timnit Gebru, qui se consacre aux biais algorithmiques, a été licenciée de son poste chez Google à cause d’un papier de recherche. L’intéressée a confirmé son départ sur Twitter, mais a précisé que le choix ne lui avait pas été laissé.

« Apparemment, la responsable de mon chef a envoyé un mail à mes subordonnés directs pour leur dire qu’elle acceptait ma démission. Je n’avais pas démissionné — j’avais d’abord demandé des conditions simples et j’avais dit que je répondrais quand je reviendrais de vacances. Mais je suppose qu’elle a décidé pour moi », a-t-elle expliqué, ajoutant qu’elle était pourtant disposée à négocier une sortie de crise.

Chez Google, Timnit Gebru était membre de l’équipe en charge des sujets éthiques dans l’intelligence artificielle. Elle est aussi cofondatrice de Black in AI, une initiative qui vise à accroître la présence des personnes noires dans l’intelligence artificielle. Elle a travaillé précédemment pour Microsoft et ses travaux comme son engagement ont attiré l’attention des médias, à l’image du New York Times ou de The Economist.

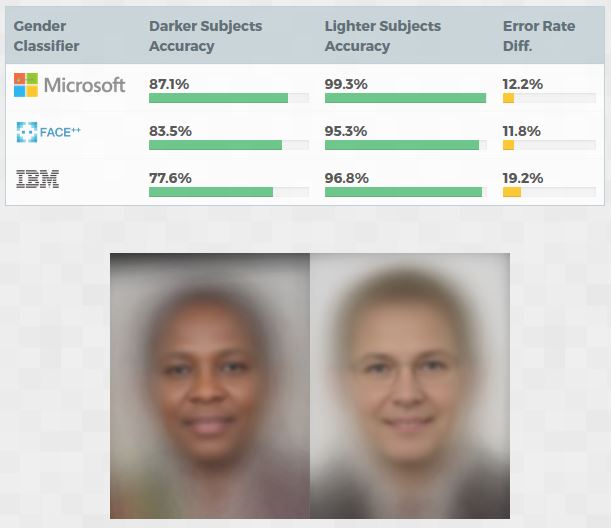

Tout particulièrement, le papier qu’elle a cosigné en 2018 lorsqu’elle était encore chez la firme de Redmond avait fait forte impression.

Ciblant la reconnaissance faciale, elle avait souligné les taux d’erreur plus importants pour l’identification des personnes à la peau foncée que pour les personnes à la peau claire. Cela est causé, selon l’étude, par les jeux de données qui sont utilisés pour entraîner les outils d’intelligence artificielle. En clair, était-il conclu, les lots de photos montrent trop souvent des personnes blanches.

Tensions autour d’un papier de recherche et un mail

Les raisons de la rupture entre Google et Timnit Gebru émergent à peine et c’est pour le moment deux paroles qui s’affrontent, en partie publiquement.

Du côté de la hiérarchie directe de Timnit Gebru, deux raisons ont, semble-t-il, motivé la décision de se séparer de l’informaticienne.

D’abord, le refus apparent de l’intéressée de rétracter un papier de recherche écrit avec quatre autres personnes membres de Google ainsi que quelques contributeurs externes. Pour demander sa rétractation ? Parce qu’il n’aurait pas suivi le processus normal de validation en interne, ni laissé assez de temps à un examen pour s’assurer qu’il atteint bien les seuils de qualité que l’on peut attendre d’un travail de recherche.

« Les articles nécessitent souvent des modifications au cours du processus d’examen interne (ou sont même jugés impropres à la soumission). Hélas, cet article particulier n’a été communiqué qu’un jour avant la date limite — nous avons besoin de deux semaines pour ce type d’examen », regrette Jeffrey Dean, le responsable de l’IA chez Google, tout en notant que Timnit Gebru a déjà été publiée à de nombreuses reprises.

Or, continue-t-il, « au lieu d’attendre les commentaires des examinateurs, [ce travail] a été approuvé et soumis ». Le problème, d’après l’entreprise américaine, c’est que l’article « ne répondait pas aux critères de publication ». Jeffey Dean dit comprendre la déception résultant de cette décision, les auteurs ayant alors été prévenus, mais il s’agit de suivre le processus classique de publication.

L’autre grief est un courrier électronique que Timnit Gebru a envoyé à des collègues, dans lequel elle rend compte de l’attitude brusque que ses managers auraient eu à son encontre pour obtenir le retrait de ce papier. Un mail qui aurait donc contrarié sa hiérarchie, d’autant que celui-ci invite les autres employés de la firme de Mountain View à ne plus contribuer au programme DEI (Diversité, Équité et Inclusion) de Google.

Sur Twitter, Timnit Gebru a expliqué avoir soumis ses conditions pour régler le souci de ce papier, soit en retirant son nom, soit en envisageant une autre date. Mais, d’après Timnit Gebru, il n’y a pas eu d’échange en la matière. La supérieure directe « a envoyé un courriel à mes subordonnés directs pour leur dire qu’elle acceptait ma démission ». Mais pour Jeffrey Dean, ces conditions sonnaient comme un ultimatum.

Cependant, du point de vue de Timnit Gebru, les faits sont présentés de manière partiale. Dans son mail, elle assure que son papier a été soumis à plus d’une trentaine de ses pairs pour des retours sur ses travaux, qu’elle a également averti en amont certains départements de Google sur son champ d’étude afin qu’ils puissent réagir et enfin qu’elle avait préparé différents scénarios pour s’adapter à d’éventuels retours négatifs.

Un extrait de l’étude à laquelle a contribué Timnit Gebru,montrant l’imprécision accrue des outils de reconnaissance faciale avec les peaux noires.

Or, continue l’intéressée, elle n’a eu aucun retour utile en deux mois de ces départements, sauf pour lui demander de nouvelles informations. Et puis soudain, une semaine avant son départ en vacances, une réunion apparaît dans son agenda sans que son objet soit précisé. Cette réunion, indique Timnit Gebru, était en fait destinée à lui faire savoir que la décision avait été prise et qu’il fallait retirer cet article.

On lui a simplement opposé un document, dont elle ne connaît pas la provenance alors qu’il porte sur son travail, ni d’ailleurs la manière dont il a produit. « Vous essayez alors d’engager une conversation sur le fait que ce n’est pas acceptable et les gens commencent à faire le contraire de toute sorte d’introspection — en essayant de trouver des boucs émissaires à blâmer », lit-on dans son mail.

C’est autour de l’existence de ce document énigmatique, son origine, son ou ses auteurs et sa conception que la crispation s’est formée.

Selon Jeffrey Dean, « Timnit a répondu par un mail exigeant qu’un certain nombre de conditions soient remplies pour qu’elle puisse continuer à travailler chez Google, notamment la révélation de l’identité de chaque personne à qui Megan [la supérieure directe de Timnit] et moi avions parlé et que nous avions consultée dans le cadre de l’examen du document et des retours d’information ».

Il poursuit en expliquant que la chercheuse a ajouté « que si nous ne satisfaisions pas à ces exigences, elle quitterait Google ». Refusant l’ultimatum, la société a accepté son départ.

Soutien de la communauté scientifique

La chercheuse, elle, regrette l’issue. « Le fait de traiter les gens comme des outils et de leur donner des ordres plutôt que de les faire participer à un simple dialogue a fait escalader les choses inutilement. Dans quel monde est-il logique de répondre en disant ‘non, la sortie est par là’, à des conditions demandant des réunions et d’éclaircir les paramètres de la recherche ? »

« Je me pose vraiment la question. Est-ce qu’ils attendent juste le bon moment pour se débarrasser de moi et ont décidé qu’il vaut mieux le faire une fois pour toutes et serrer les dents avec le retour de flamme ? Ou ne s’attendaient-ils pas simplement à l’absence de réaction négative ? En quoi est-ce le meilleur résultat pour eux ? C’est vraiment ahurissant », a-t-elle conclu.

Sur les réseaux sociaux comme dans les colonnes de nombreux médias américains, ce retour de bâton ne s’est en tout cas pas fait attendre. De nombreux pairs de Temnit Gebru ont pris la parole pour prendre sa défense, aussi bien au sein de Google qu’en dehors. Une lettre ouverte avec plus de 400 signataires a d’ailleurs émergé, exigeant des clarifications et alertant sur ce qui s’apparente à une censure de la recherche.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !