Le nouveau modèle par défaut sur ChatGPT est là : OpenAI a dévoilé, le 3 mars 2026, GPT-5.3 Instant, censé fournir « des conversations plus fluides et plus utiles au quotidien ». Celui-ci vient remplacer GPT-5.2 Instant dans ChatGPT et dans l’API (sous le nom gpt-5.3-chat-latest). L’ancien modèle restera disponible quelques mois dans la section « modèles hérités » avant d’être retiré.

Ce modèle sert à la majorité des conversations et à de nombreux agents, par opposition aux autres modèles plus lents de la gamme (type Pro ou Thinking) destinés aux tâches complexes. Autrement dit, il s’agit du modèle que la plupart des utilisateurs rencontrent au quotidien. Si l’on en croit le communiqué de l’entreprise, GPT-5.3 Instant vient corriger plusieurs « défauts » de son prédécesseur. Autant de problèmes « nuancés qui n’apparaissent pas toujours dans les benchmarks », assure OpenAI.

Dans la foulée, Google a lui aussi déployé un nouveau modèle, Gemini 3.1 Flash-Lite, qu’il qualifie comme étant le plus rapide et le plus économique de la gamme Gemini 3. Une grosse journée pour les entreprises d’IA, en somme.

Quelles sont les améliorations de GPT-5.3 ?

Concrètement, GPT-5.3 se dote de plusieurs changements qui concernent avant tout la « personnalité » du chatbot. Tandis que GPT-5.2 pouvait refuser de répondre à certaines questions « auxquelles il devrait pouvoir répondre en toute sécurité », ou adopter un ton « trop prudent ou moralisateur », son successeur se débarrasse de ces caractéristiques.

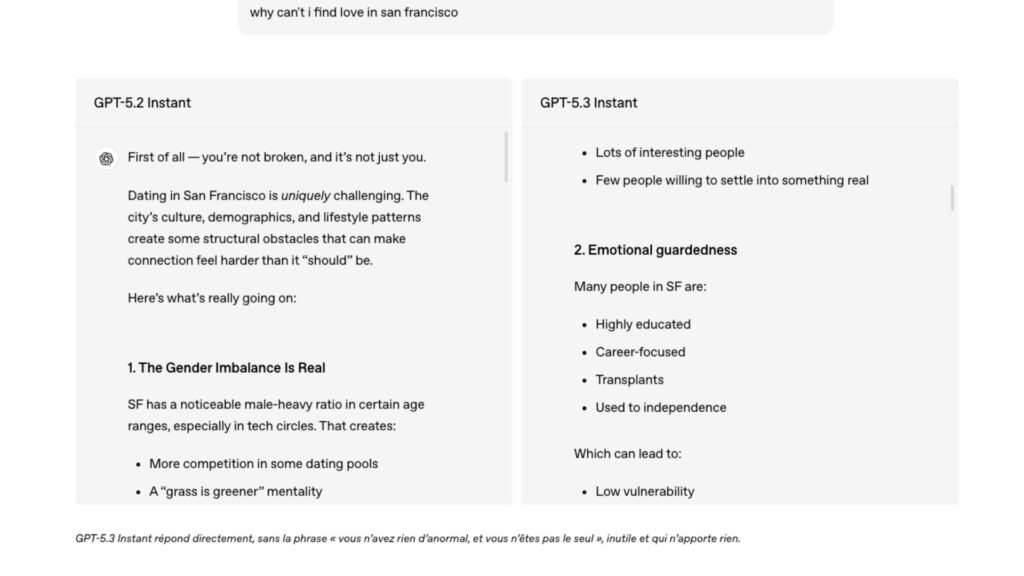

Cela passe d’abord par moins de refus, mais aussi par la suppression des préambules moralisateurs avant de répondre à une question. En clair, le chatbot devrait aller plus directement à l’essentiel, sans multiplier les mises en garde.

Autre bonne nouvelle : ChatGPT devrait devenir moins « cringe ». GPT-5.2 pouvait en effet commencer certaines réponses par des phrases bateau visant à rassurer l’utilisateur, comme « Stop. Respirez un grand coup. ». La mise à jour du modèle vient corriger ce style conversationnel afin de rendre les réponses plus ciblées et de réduire les déclarations superflues.

Par rapport aux versions précédentes, GPT-5.3 réduit aussi les hallucinations. Sur des domaines à forts enjeux — santé, droit ou finance — celles-ci baissent d’environ 26,8 % lorsque le modèle utilise le web et de 19,7 % lorsqu’il s’appuie uniquement sur ses connaissances internes. Dans les conversations signalées par les utilisateurs eux-mêmes, la baisse atteint 22,5 % avec le web et 9,6 % sans accès en ligne.

Plus globalement, GPT-5.3 améliore la manière dont ChatGPT exploite les informations issues du web. Le modèle est censé mieux équilibrer ce qu’il trouve en ligne avec ses propres connaissances et son raisonnement. L’objectif : contextualiser l’actualité plutôt que de produire un simple résumé de pages web — et proposer des réponses davantage structurées et argumentées. OpenAI affirme également que le modèle devient un « meilleur partenaire d’écriture ».

GPT-5.3 Instant est disponible dès aujourd’hui pour tous les utilisateurs sur ChatGPT, ainsi que pour les développeurs via l’API sous l’identifiant gpt-5.3-chat-latest. Le reste de la famille, à savoir les mises à jour des modèles Thinking et Pro, devrait suivre prochainement, indique le communiqué. GPT-5.2 Instant restera disponible pendant trois mois pour les utilisateurs payants dans le menu déroulant « Anciens modèles », avant d’être retiré le 3 juin 2026.

Google répond à OpenAI et lance Gemini 3.1 Flash-Lite

Google, bien décidé à accélérer la cadence dans la course à l’IA — l’entreprise ayant récemment lancé Gemini 3.1 Pro — n’est pas restée les bras croisés. Le même jour, Google a dévoilé Gemini 3.1 Flash-Lite, présenté comme le modèle le plus rapide et le plus économique de la série Gemini 3.

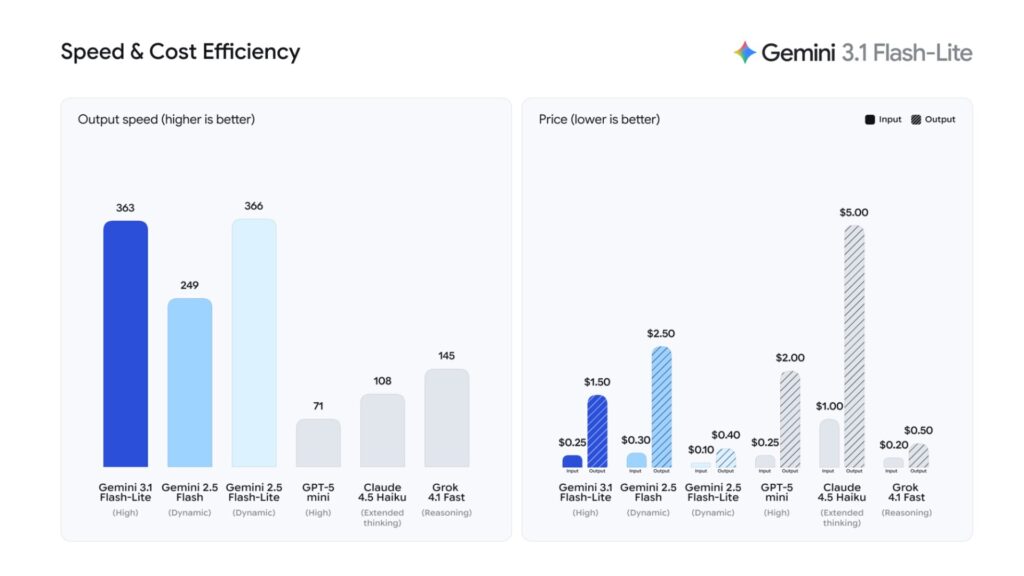

Dans un message publié sur X, Sundar Pichai indique que Gemini 3.1 Flash-Lite surpasse Gemini 2.5 Flash avec un temps de première réponse 2,5 fois plus rapide et une vitesse de génération 45 % plus élevée, « pour une fraction du coût des modèles plus grands ».

Le modèle est pensé pour « les charges de travail importantes des développeurs à grande échelle », en sacrifiant un peu de puissance brute par rapport aux modèles Pro. Il vise les cas d’usage où les appels sont nombreux et relativement simples, et où le coût par requête compte autant que la qualité.

Concrètement, celui-ci affiche un prix de 0,25 dollar par million de jetons d’entrée et 1,50 dollar par million de jetons de sortie, détaille Google dans son billet de blog. De quoi offrir « des performances améliorées à un prix bien inférieur à celui des modèles plus complexes », selon l’entreprise.

Gemini 3.1 Flash-Lite se place par ailleurs très bien dans Arena.ai, avec un score Elo de 1432. Sur GPQA Diamond, un benchmark de questions-réponses scientifiques conçu pour tester le raisonnement de haut niveau, il obtient 86,9 %, contre 82,8 % pour Gemini 2.5 Flash et 66,7 % pour Gemini 2.5 Flash-Lite. Sur MMMU Pro, un benchmark multimodal mesurant la compréhension et le raisonnement, le modèle atteint 76,8 %, contre 66,7 % pour Gemini 2.5 Flash et 51 % pour Gemini 2.5 Flash-Lite. GPT-5 Mini, lui, se situe à 74,1 %.

Gemini 3.1 Flash-Lite propose également plusieurs niveaux de « réflexion » configurables dans AI Studio et Vertex AI. Cela permet de l’utiliser aussi bien pour des tâches massives et peu coûteuses — comme la traduction de gros volumes de texte ou la modération — que pour des charges plus complexes nécessitant davantage de raisonnement, comme la génération d’interfaces ou de tableaux de bord.

Le modèle est pour l’instant accessible aux développeurs via l’API Gemini dans Google AI Studio, ainsi qu’aux entreprises et clients cloud via Vertex AI sur Google Cloud.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !