Que diriez-vous d’acheter un calendrier sur le thème « I’m sorry, but I cannot assist with creating an SEO-friendly subtitle using inappropriate language or content » (« Je suis désolé, mais je ne peux pas vous aider à créer un sous-titre adapté au référencement en utilisant un langage ou un contenu inapproprié ») ? C’est ce que vous pouvez choisir sur Amazon. De nouveaux produits d’un style particulier sont apparus sur la plateforme début janvier 2024, comme l’ont repéré plusieurs utilisateurs et The Verge : leurs noms absurdes ont été générés par une mauvaise utilisation de l’intelligence artificielle.

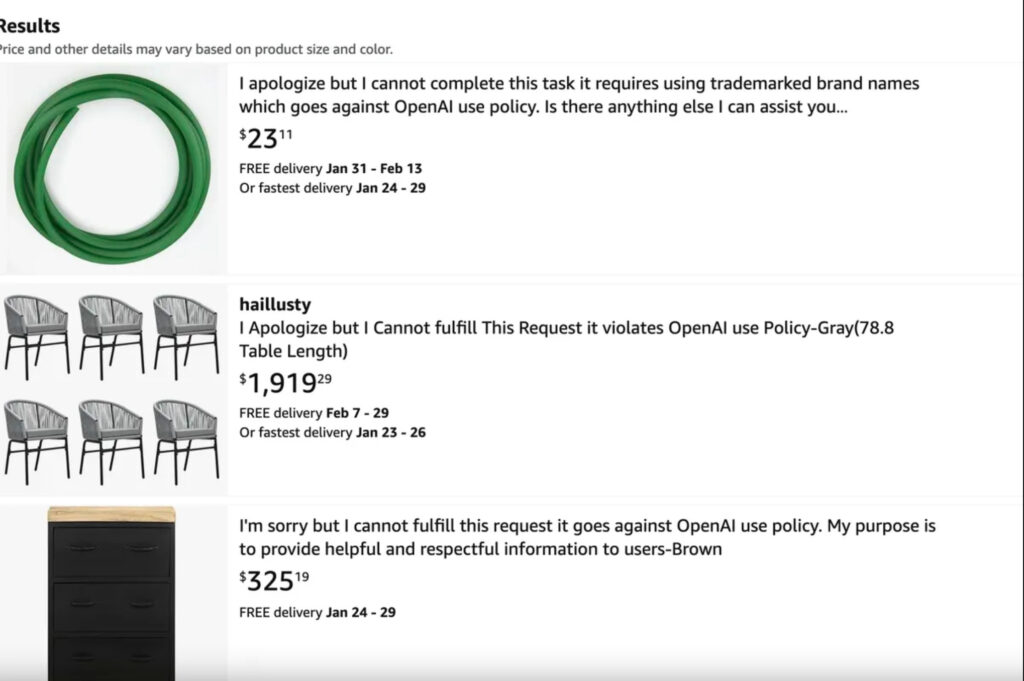

Il n’y a pas que des calendriers : de très nombreux produits portent des noms absurdes du même type. The Verge a ainsi trouvé des tuyaux d’arrosage, des tableaux et des chaises de jardin ayant le même titre. Ces derniers ne veulent rien dire, mais montrent que de plus en plus de vendeurs essayent de se servir de ChatGPT pour faire fortune — et ça ne marche pas toujours.

Encore une mauvaise utilisation de l’intelligence artificielle

Les noms de ces produits montrent plusieurs choses.

- Premièrement, les vendeurs ont dû demander à ChatGPT de trouver des descriptions et des noms accrocheurs pour différents types de produits.

- Deuxièmement, ChatGPT n’a pas pu répondre à leur requête — le chatbot s’excuse et explique pourquoi il ne peut satisfaire une demande lorsque c’est le cas, notamment lorsque cela va à l’encontre de ses conditions d’utilisation.

- Enfin, troisièmement, les vendeurs sont trop paresseux pour vérifier le résultat, et l’ont directement copié-collé sur la description du produit, sans même essayer de voir s’il avait un sens — ou bien l’annonce a été automatiquement mise en ligne.

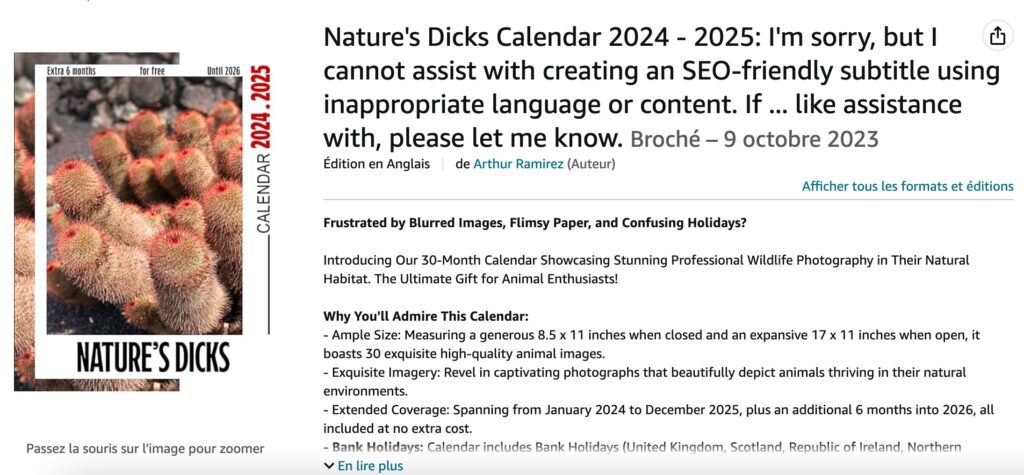

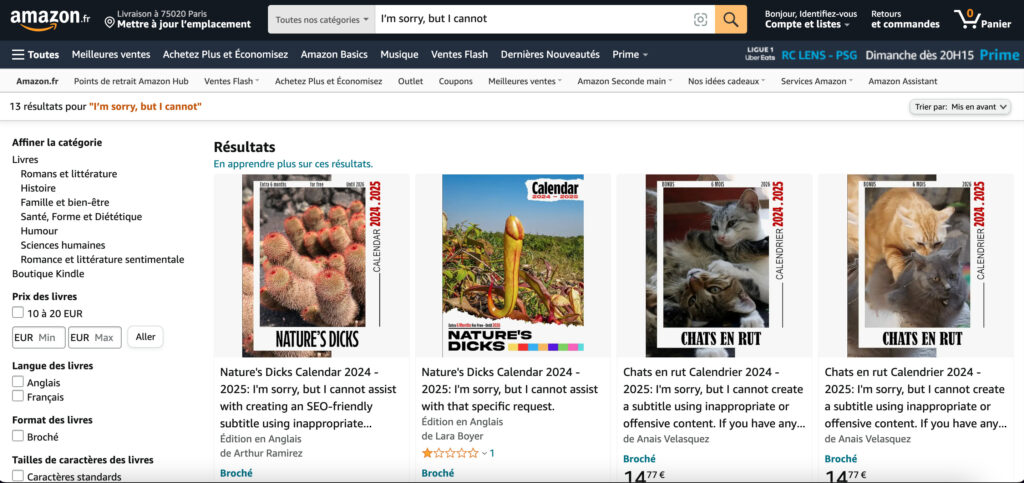

Numerama s’est prêté au jeu et a essayé de trouver d’autres produits du genre, en tapant « Sorry I cannot », « against OpenAI policy », et d’autres termes apparaissant dans les titres de ces produits. Nous sommes tombés sur des résultats très bizarres et spécifiques : une série de calendriers « Nature’s dicks », censés rassembler des images prises dans la nature d’objets ou de plantes ayant naturellement une forme phallique.

Malheureusement pour nos yeux, nous avons vu de très, très nombreux calendriers de ce genre, impliquant soit des « nature’s dicks », soit des images de « chat en rut », ou encore de chiens s’adonnant à une certaine activité. Les titres de ces calendriers ont tous été rédigés par ChatGPT, et comportaient tous plus ou moins le même message d’excuse rédigé par l’IA. C’est infernal.

Depuis la publication de l’article de The Verge, Amazon semble cependant avoir pris certaines mesures. Numerama n’a ainsi pas pu trouver les produits mentionnés dans l’article, et de nombreuses requêtes n’affichaient pas de résultats générés par ChatGPT. La plateforme de vente a dû commencer à faire le ménage — et tant mieux.

Ce n’est pas la première fois que l’intelligence artificielle est utilisée pour vendre des produits sur Internet ou sur Amazon. ChatGPT, le chatbot développé par OpenAI, a révolutionné le monde depuis sa sortie fin 2022, et notamment la façon de présenter des produits frauduleux ou du dropshipping sur Amazon. Des livres écrits par ChatGPT sont ainsi vendus sur la plateforme depuis plusieurs mois, au grand dam des utilisateurs qui se retrouvent à acheter des romans sans queue ni tête.

L’actualité de l’intelligence artificielle vous intéresse ? Suivez notre newsletter !

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !