C’est un acronyme que l’on voit désormais associé couramment à l’intelligence artificielle : « GPT ». Ces trois lettres se retrouvent dans le nom de ChatGPT, le fameux chatbot conçu par l’entreprise américaine OpenAI. Ou bien dans les modèles de langage qui servent à le faire fonctionner, comme GPT-3 et GPT-4. D’autres projets s’en servent aussi, comme Auto-GPT.

Que signifie GPT ?

GPT signifie en anglais Generative Pre-trained Transformer, soit transformeur génératif pré-entraîné. Il s’agit d’un modèle de langage développé par la société américaine OpenAI, qui sert de « moteur » à l’agent conversationnel (ou chatbot) ChatGPT. Plusieurs générations de GPT existent. Il y en a quatre en tout. Mais en disant cela, on ne saisit pas comment cela fonctionne.

La formulation Generative Pre-trained Transformer peut paraître intimidante de prime abord. Il s’avère néanmoins que l’on peut apprivoiser pas à pas en regardant chaque terme qui compose cet acronyme. Ainsi, le mot génératif sert à renseigner que le système est en capacité de générer du contenu : du texte ou des images par exemple.

Vous le voyez déjà avec ChatGPT, si vous avez utilisé cet outil : il produit des phrases cohérentes en se basant sur le texte que vous lui avez envoyé. Leur justesse est certes discutée (on dit parfois que cette IA « hallucine » quand elle raconte n’importe quoi). Mais toujours est-il que sur un plan strictement grammatical, ChatGPT tient debout.

Le segment pré-entraîné est aussi très clair : cela suggère que l’outil a été entraîné au préalable sur de grands volumes de données, pour qu’il apprenne à agencer les mots logiquement. Cela donne lieu à des modèles statistiques qui estiment l’agencement et la distribution des termes. Cela est possible grâce aux immenses quantités d’informations préalablement ingérées.

Par exemple, le modèle GPT-2 d’OpenAI disposait d’un ensemble de données composé de 40 gigaoctets (Go) de texte. GPT-3 a été préparé sur 570 Go de données, venant du net, comme Reddit et Wikipédia. On ne sait pas, en revanche, la taille du corpus qui a permis à OpenAI de créer GPT-4. Il s’agit aujourd’hui de son modèle de langage le plus avancé.

On peut avoir tendance à l’oublier, mais une masse de quelques centaines de Go pour du texte est considérable. À titre de comparaison, le poids de tout Wikipédia — la plus vaste encyclopédie jamais inventée — dépasse à peine la dizaine de Go. Le texte occupe en effet beaucoup moins de place sur une machine qu’une vidéo ou une image. Les corpus sont donc immenses.

La phase d’entraînement est aussi une phase de réglage pour rendre l’activité d’une intelligence artificielle conforme aux intentions de la société qui la conçoit. OpenAI a par exemple passé six mois pour ajuster le fonctionnement de GPT-4. Durant cette période, des ajustements manuels peuvent avoir lieu, sous la supervision d’équipes spécialisées dans l’IA.

Le transformeur : une révolution dans le travail de l’IA

La partie la plus technique est celle liée au transformeur. Ce terme désigne une approche relativement inédite dans le champ de l’intelligence artificielle. Celle-ci a été présentée en 2017 dans un papier de recherche signé par des membres des équipes de recherche de Google — dont la division Google Brain, spécialisée dans l’intelligence artificielle justement.

Les transformeurs sont un type d’architecture de réseau neuronal qui ont le vent en poupe. Outre le texte, ils servent aussi à la génération d’image (comme DALL-E, Stable Diffusion, Midjourney) ou aux réseaux de neurones classificateurs, tels AlexNet. Ils découlent de l’apprentissage profond (deep learning), un procédé courant dans l’apprentissage automatique.

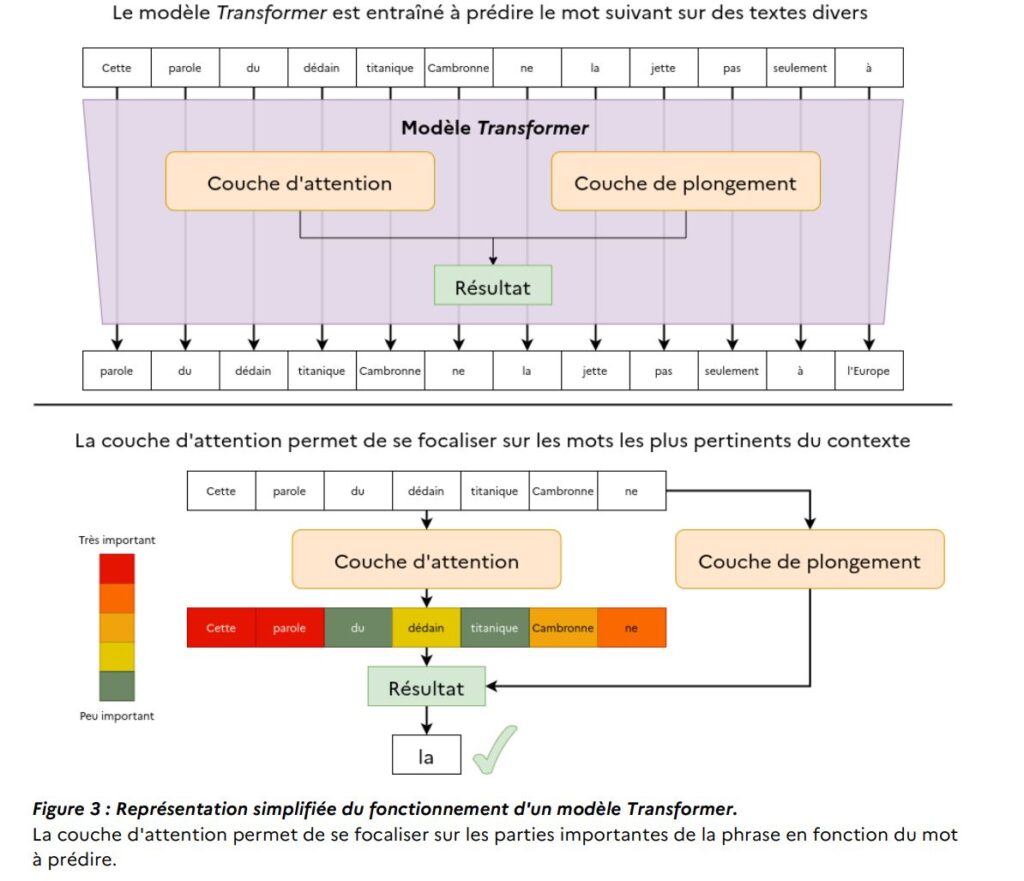

C’est un papier, titré L’attention est tout ce dont vous avez besoin, qui va donner naissance aux architectures appelées Transformers. Voilà ce qu’explique le pôle d’expertise de la régulation numérique (Peren) dans un éclairage sur ChatGPT. Le Peren a pour rôle d’appuyer les services de l’État sur les questions liées aux nouvelles technologies.

« Le mécanisme de l’attention permet de résoudre le problème des phrases

complexes. Le modèle s’entraîne à reconnaître l’importance des mots du contexte en fonction du mot considéré », dit le Peren. Il s’agit de « la dernière grande avancée du domaine », ajoute-t-il. OpenAI ne s’y est pas trompé en intégrant cette manière de procéder.

Pour expliquer le fonctionnement de cette attention, le Peren a pris l’exemple de la phrase suivante : « le chat a poursuivi le rat, puis il l’a mangé ». Quand le modèle va se porter sur le mot « il », son attention va se porter sur le mot « chat ». En clair, il saisit le sens du mot « il » et à quel sujet il renvoie dans la phrase. On retrouve la même idée dans l’infographie, avec « cette parole ».

Google a publié en 2021 une vidéo sur YouTube pour présenter le fonctionnement des transformeurs, qui « ont complètement transformé l’état de l’art en matière de traitement du langage naturel ». Dithyrambique, la firme de Moutain View l’affirme : « les transformeurs peuvent tout faire ». Google a utilisé un transformeur pour son projet BERT pour améliorer sa recherche.

Un an après le papier de Google sur le mécanisme de l’attention, OpenAI a partagé en 2018 un papier de recherche intitulé Améliorer la compréhension des langues grâce à l’apprentissage non supervisé. Dans celui-ci, OpenAI explique combiner « deux idées existantes » : les transformateurs et le pré-entraînement non supervisé.

« Ces résultats fournissent un exemple convaincant que l’association de méthodes d’apprentissage supervisé et de pré-entraînement non supervisé fonctionne très bien », écrivait à l’époque OpenAI. « Nous avons obtenu des résultats de pointe sur une série de tâches linguistiques diverses avec un système évolutif et agnostique », se félicitait à l’époque la société.

« Ces résultats fournissent un exemple convaincant que l’association de méthodes d’apprentissage supervisé et de pré-entraînement non supervisé fonctionne très bien », ajoutait-elle, en reconnaissant que cette idée avait été déjà explorée avant par d’autres. Ce travail a été rétrospectivement appelé GPT-1 puisqu’il s’agissait de la première itération du modèle.

GPT-2 est arrivé en 2019, GPT-3 en 2020 et GPT-4 en 2023.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !