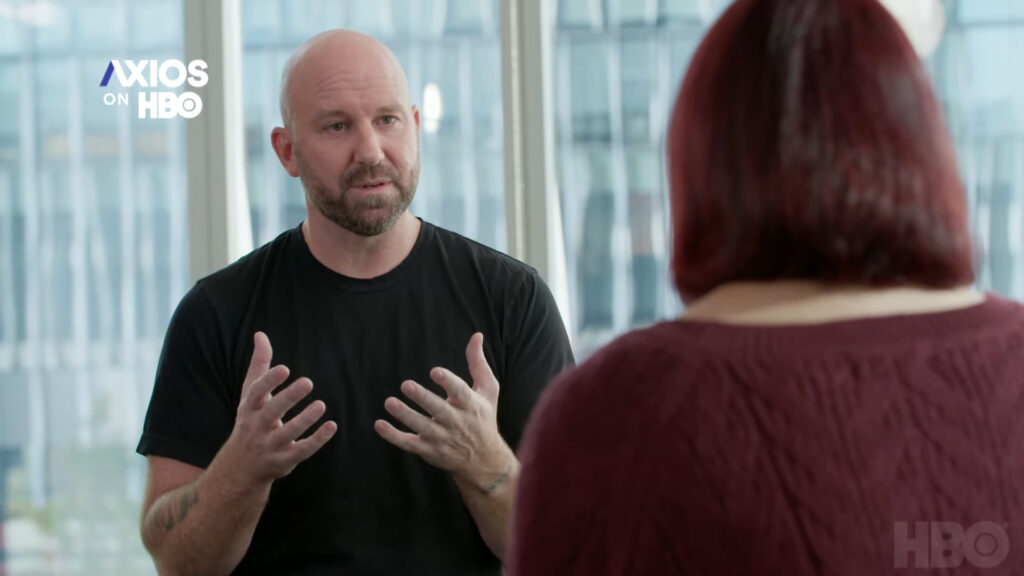

« Même si nous dépensions tout notre argent dans la prévention, cela n’empêcherait quand même pas les gens de voir des choses qu’ils n’aiment pas. Cela n’éliminerait pas toutes les possibilités que les gens ont d’utiliser la plateforme de manière mal intentionnée ». La phrase vient d’Andrew Bosworth, le vice-président de Facebook en charge de la réalité virtuelle, qui prendra en janvier le poste de CTO de Meta, la maison-mère de Facebook.

Le futur chief technology officier du réseau social était interviewé par Ina Fried, une journaliste d’Axios, qui lui demandait ce que Facebook pourrait faire de plus pour diminuer ses « effets néfastes ». Et la réponse du futur chef de toute la technologie de la plateforme à de quoi laisser perplexe.

« Ce sont les individus qui choisissent ou non de croire aux posts qu’ils voient sur la plateforme, ce sont eux qui choisissent de partager ou non certains contenus, et jamais je ne me permettrais de dire qu’ils n’ont pas le droit de le faire parce que je ne suis pas d’accord avec ce qu’ils disent », explique-t-il. Dans les faits, ce sont bien les utilisateurs et utilisatrices de Facebook qui partagent les fake news, et qui sont à l’origine de leur création. Mais nier la responsabilité de la plateforme, et son algorithme, dans la propagation des fake news et au mieux mensonger, au pire dangereux.

« Je suis fier des outils que nous avons construits »

L’interview d’Andrew Bosworth a lieu alors que Facebook est sous le feu des critiques depuis plusieurs mois, notamment à la suite de la publication des Facebook Files. Le leak d’un nombre très important de documents par la lanceuse d’alerte France Haugen a permis à de nombreux médias d’exposer certaines pratiques du réseau social. Outre le fait que la modération sur la plateforme ne s’appliquerait pas de la même manière pour tout le monde, ou que le réseau social aurait avantagé les contenus les plus clivants, on trouve aussi parmi ces révélations des faits plus graves : Facebook aurait aidé à la propagation des fake news sur le Covid, et la plateforme n’aurait pas mis en place des outils de modération suffisants pour permettre de lutter efficacement contre les messages violents dans toutes les langues.

Andrew Bosworth n’a cependant jamais mentionné ces problèmes lors de son interview — alors même que l’abondance de fake news et que le rôle de Facebook dans leur propagation était discuté. À la place, le futur CTO a reporté la faute sur les utilisateurs et utilisatrices du réseau social. « Ce sont les individus qui choisissent ou non de croire aux posts qu’ils voient sur la plateforme », a-t-il déclaré, « ce sont eux qui choisissent de partager ou non certains contenus, et je ne me permettrais pas de dire qu’ils n’auraient pas le droit de le faire parce que je ne suis pas d’accord avec ce qu’ils disent. »

« Si votre démocratie ne peut pas tolérer les discours de certaines personnes, alors je ne suis pas sûr de quel genre de démocratie il s’agit », a continué Andrew Bosworth lorsque la journaliste lui a demandé ce qu’il pensait du danger des fake news pour la démocratie. « Je comprends que les discours de ces gens peuvent être dangereux, je le comprends vraiment, mais fondamentalement nous sommes une technologie démocratique, et je crois que nous pouvons donner accès à plus d’informations aux utilisateurs, et permettre à tout le monde de se connecter avec d’autres, et il ne faut pas donner cette opportunité seulement à un petit groupe, à une élite. Je suis fier des outils que nous avons construits ».

Reporter la faute sur les utilisateurs semble être une réponse relativement peu étoffée par rapport à l’ampleur des nuances à prendre en compte, et la force des biais algorithmiques que l’on connait, ainsi que leur impact sur la vie réelle. La responsabilité de la plateforme est également impossible à balayer d’un revers de la main, tant il est devenu clair (pour Facebook lui-même) que la technologie n’est pas « neutre » et que les entreprises font des choix.

Le nombre insuffisant de modérateurs dans certaines langues, et le mauvais fonctionnement des boutons de signalement dans d’autres, montrent que Facebook avait choisi de ne pas investir assez dans la sécurité.

« Notre capacité à savoir ce qui est de la désinformation est en elle-même à remettre en question, donc je ne suis vraiment pas pour dire que nous possédons assez de connaissances et de légitimité à décider ce qu’un autre humain devrait dire, ou non, et qui il devrait écouter », conclut le futur-CTO, en contradiction avec le principe-mêmes des règles d’une plateforme de la tech, qui fait, jour après jour, des choix de modération en accord ou non avec ses règles d’utilisation.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !