Souvent critiqué pour l’opacité de son fonctionnement, Facebook a fait mardi 24 avril un effort de transparence assez important en dévoilant ses directives internes qui permettent à son équipe de modération de savoir comment appliquer les « standards de la communauté » — c’est-à-dire le règlement intérieur du réseau social, celui que les membres doivent respecter pour ne pas avoir d’ennui.

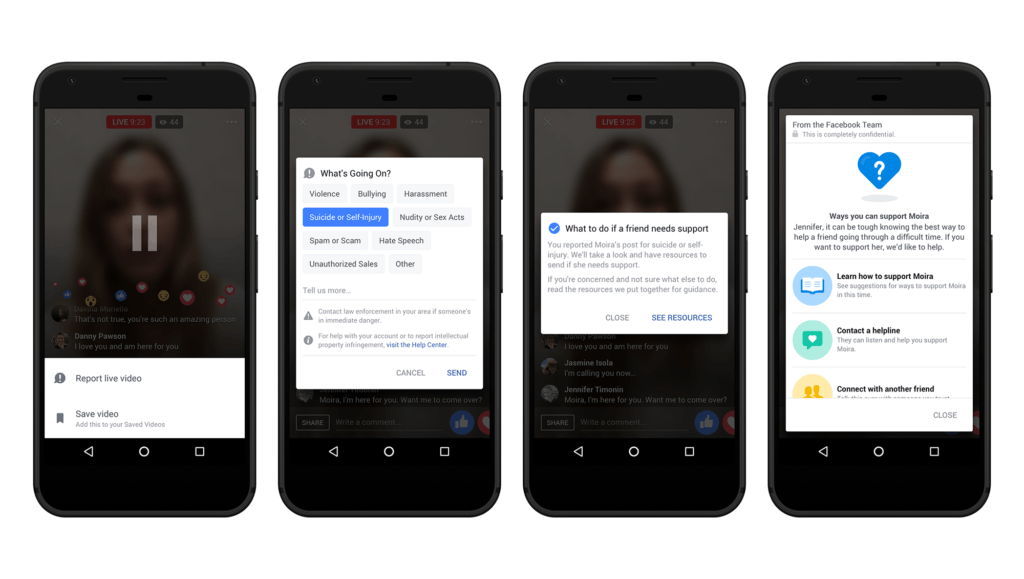

Particulièrement fournies, ces consignes sont réparties dans six rubriques (violence et comportement criminel, sécurité, contenu répréhensible, intégrité et authenticité, respect de la propriété intellectuelle, et données relatives aux contenus), chacune pouvant ensuite être divisée en plusieurs sections afin de traiter de problématiques précises, comme le suicide, le harcèlement, la nudité ou les menaces.

Opération transparence

Jusqu’à présent couvertes par le sceau du secret (par le passé, la presse a toutefois réussi à connaître une partie de ces règles, comme ProPublica et le Guardian), ces directives ont été publiées pour deux raisons, selon Facebook : la première consiste à «aider chacun à comprendre où nous plaçons la limite sur les questions complexes ou nuancées », tandis que la seconde vise à les améliorer.

« En fournissant ces détails, il est plus facile pour tout le monde, y compris les experts dans différents domaines, de nous faire part de leurs observations, afin que nous puissions améliorer ces directives – ainsi que les décisions que nous prenons – au fil du temps », écrit le site communautaire. En effet, sa politique de modération et son règlement font depuis longtemps l’objet de controverses.

Coopération avec des experts

Facebook assure toutefois ne pas avoir attendu la publication de ses directives pour se tourner vers des spécialistes. Dans une foire aux questions accompagnant la diffusion publique de son règlement interne, le site américain dit avoir travaillé avec professeur à l’université d’Oxford, Timothy Garton Ash, « pour examiner les questions relatives au discours de haine sur une base interculturelle ».

Autre exemple pris par le réseau social, celui de l’exploitation sexuelle : pour rédiger sa politique en la matière, Facebook dit avoir réuni autour de lui « plus de 150 organisations et experts en sécurité dans des pays du monde entier, dont les États-Unis, le Kenya, l’Inde, l’Irlande, l’Espagne, la Turquie, la Suède et les Pays-Bas », afin de constituer des consignes à même de protéger les personnes vulnérables.

Quelques règles restent secrètes

L’effort de transparence, s’il est louable, n’est toutefois pas total. Interrogée par Le Monde, Siobhan Cummiskey, responsable de la politique des contenus chez Facebook, admet ainsi que certains points précis du règlement interne demeurent secrets, « afin d’empêcher des gens de contourner le système ». Les règles internes révélées par la presse ont montré que Facebook s’appuie sur des exemples, que l’on ne retrouve pas ici.

Dans les extraits du Guardian, on pouvait lire que « frapper un roux » et « allons tabasser les gros » sont des messages tolérés, mais pas « Poignardons et devenons le cauchemar des sionistes ». ProPublica a de son côté cité un quiz sur la connaissance des règles par les modérateurs, en leur demandant par exemple quelle est la catégorie à protéger : hommes blancs, femmes chauffeuses ou enfants noirs.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !