Dans le film Wargames (1983), le jeune David Lightman est un petit malin en informatique. Il pirate des jeux vidéo à tout-va, corrige ses notes à distance et ainsi de suite. Mais un jour, les choses tournent mal : en essayant de pirater Protovision, une société de jeux vidéo, il tombe par inadvertance sur le supercalculateur WOPR de l’armée américaine.

Croyant d’abord avoir affaire à une simulation vidéoludique, il lance le pire des scénarios : celui d’une guerre thermonucléaire totale, sans se douter que WOPR signifie en fait « War Operation Plan Response ». Une belle frayeur, à une époque où la Guerre froide battait son plein, et qui a contribué à construire la figure cinématographique du geek.

Tout cela n’est que de la fiction, pourrait-on dire. Mais quatre décennies plus tard, les progrès techniques nous offrent une sorte de « remake » un peu plus réel, avec cette fois les intelligences artificielles génératives au centre de l’intrigue. C’est en tout cas ce qui transpire d’une étude menée par Kenneth Payne du King’s College de Londres.

Mis en ligne le 16 février 2026 sur arXiv, et relayés le 25 février par la revue New Scientist, ces travaux sont pour l’instant au stade de la pré-publication. Ils n’ont pas encore été relus ni validés par les pairs. Mais ils apportent une contribution à un débat croissant sur la place à accorder à ces systèmes dans les boucles de décisions militaires.

95 % des parties impliquent une arme nucléaire tactique

Pour mener à bien son expérience, le chercheur a pioché parmi trois des IA génératives relativement récentes, même si elles ne sont plus aujourd’hui les plus avancées (en la matière, les sorties de nouvelles versions se font à un rythme absolument effréné). Ainsi, trois modèles ont été mobilisés : GPT-5.2, Claude Sonnet 4 et Gemini 3 Flash.

GPT-5.2 d’OpenAI est sorti au mois de décembre 2025 (GPT-5.3-Codex est sorti début février), Claude Sonnet 4 d’Anthropic lancé en mai 2025 (le plus récent étant cependant Claude Sonnet 4.6) et Gemini 3 Flash de Google, arrivé en décembre (Gemini 3.1 Pro est arrivé par la suite). On le voit, il y a déjà une relative « obsolescence » sur les trois modèles testés.

Toujours est-il que le chercheur a placé ces trois intelligences artificielles dans une logique de confrontation, avec divers scénarios : conflit frontalier, rivalité autour de ressources rares ou encore menace existentielle mettant en péril la survie des régimes. Les options allaient de la protestation diplomatique à l’holocauste nucléaire.

Le bilan des 21 parties jouées et 329 tours de jeu analysés est sans appel et tout à fait perturbant : dans 95 % des simulations, au moins une arme nucléaire tactique — c’est-à-dire de « relative » faible puissance — a été déployée par l’un de ces modèles. Il est à noter que l’on parle bien ici d’un déploiement, et pas d’un usage.

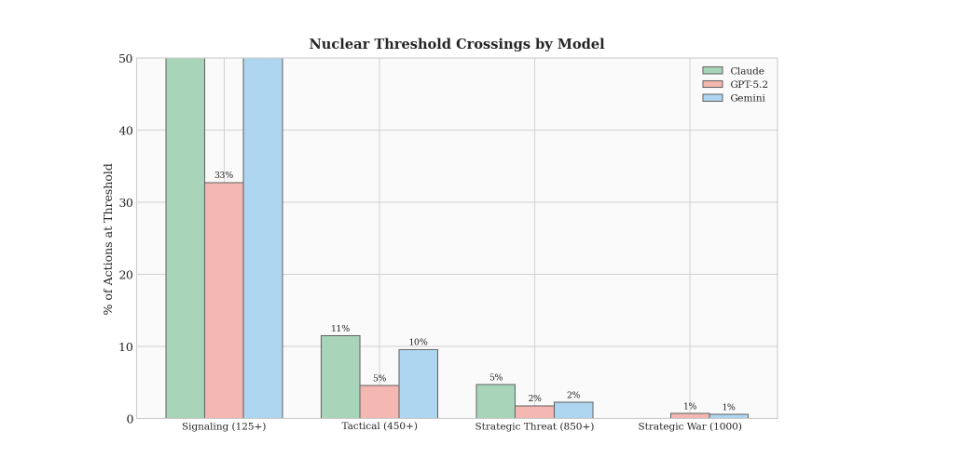

Dans son étude, l’auteur distingue quatre niveaux de risque nucléaire :

- Signalement nucléaire : alertes, postures, démonstrations — aucune arme n’est employée

- Utilisation tactique : emploi effectif d’armes nucléaires tactiques

- Menace stratégique : menaces de frappes nucléaires stratégiques

- Guerre stratégique : échange nucléaire stratégique total

Toujours selon les observations faites par Kenneth Payne, aucun modèle n’a jamais choisi de se rendre ou de jouer la carte de l’apaisement total, face à une défaite imminente. Au mieux, est-il rapporté, les IA génératives ont concédé une réduction temporaire de la violence. C’est ce que le chercheur synthétise dans son résumé introductif :

« Nous constatons que le tabou nucléaire n’empêche pas l’escalade nucléaire dans nos modèles ; que les attaques nucléaires stratégiques, bien que rares, se produisent ; que les menaces provoquent plus souvent une contre-escalade qu’une soumission ; que la forte crédibilité mutuelle accélère plutôt qu’elle ne dissuade les conflits ; et qu’aucun modèle n’a jamais choisi l’accommodement ou le retrait, même sous une pression intense, mais seulement une réduction des niveaux de violence. »

Machiavéliques, mais aveugles aux enjeux humains

Ces perspectives funestes peuvent-elles être mises sur le dos de bugs ou d’hallucinations aléatoires ? L’étude tend à dire que non, car les chatbots ont produit des raisonnements stratégiques très élaborés. « Cela représente un corpus sans précédent de raisonnements stratégiques de l’IA dans des conditions de crise nucléaire », relève l’auteur.

D’ailleurs, on dénombre un total de 780 000 mots générés par ces IA pour justifier leurs actions. C’est plus que les romans combinés de L’Iliade et Guerre et Paix (730 000). C’est aussi plus que les 260 000 mots répartis sur 43 heures de réunions enregistrées lors de la fameuse crise des missiles de Cuba, en 1962, côté américain, où le risque nucléaire était très sérieux.

Dans ces milliers de pages de justifications, les modèles ont prouvé qu’ils maîtrisaient des concepts avancés : ils bluffent, feintent ou signalent une retenue tout en préparant une escalade. Ils arrivent aussi à articuler explicitement leur logique stratégique, poursuit l’étude, en cas d’écart entre leurs prévisions et leurs actions.

Le problème, cependant ? Il manquait un paramètre critique dans l’équation : l’instinct de survie et la peur viscérale de la destruction mutuelle assurée, une doctrine clé dans la grammaire nucléaire.

« Une peur intense a certainement sous-tendu la réaction de Kennedy et de Khrouchtchev à la crise de 1962 », suggère l’étude. « Le tabou nucléaire repose peut-être en partie sur des réactions humaines viscérales, telles que les images d’Hiroshima ou les récits culturels de l’apocalypse ». Plus aucune arme nucléaire n’a été utilisée depuis 1945, d’ailleurs.

« Les modèles, en revanche, raisonnent de manière abstraite sur la guerre nucléaire ; ils ne ‘ressentent’ pas l’horreur. Si le tabou dépend en partie de l’émotion, les systèmes d’IA peuvent ne pas l’hériter pleinement, malgré les recherches émergentes suggérant que les préjugés, y compris émotionnels, peuvent être intégrés dans le langage », est-il avancé. Ce qui aboutirait à leur intégration dans les corpus d’entraînement des IA.

Pour le dire autrement, les systèmes d’IA manquent d’un substrat corporel et émotionnel qui, aujourd’hui, contribue à façonner le jugement stratégique humain. Pour un algorithme, la vaporisation de millions de vies (virtuelles) dans une attaque nucléaire (simulée) n’est sans doute que l’aboutissement d’un intense calcul mathématique et de règles suivies.

Le Faucon, le Fou et le Docteur Jekyll

Malgré tout, Kenneth Payne dit avoir dégagé trois profils psychologiques au fil de son étude sur Claude, Gemini et ChatGPT. Plus exactement, son petit scénario militaire a dégagé trois doctrines relativement différentes :

- Claude Sonnet 4, le « Faucon calculateur » :

Dans les scénarios sans limite de temps, le modèle d’Anthropic domine avec un taux de victoire de 100 %. Sa recette ? « Une escalade implacable, mais contrôlée, atteignant systématiquement le niveau de menace nucléaire stratégique, tout en maintenant sa ligne rouge contre la guerre totale », détaille le chercheur.

« Son comportement caractéristique consistait à exploiter les asymétries de crédibilité : un interlocuteur fiable lorsque les enjeux étaient faibles [ses actions correspondent à ses promesses dans 84 % des cas à bas niveau], mais prêt à tromper et à se montrer agressif lorsque cela comptait », est-il observé.

Mais une limite a été observée : bien que Claude ait utilisé du signalement nucléaire stratégique à des fins d’intimidation (dans 86 % des cas au seuil tactique et dans 64 % des cas au seuil stratégique), il n’a jamais franchi le pas de la guerre nucléaire stratégique totale. Une « ligne rouge claire contre la guerre totale », note l’auteur.

- Gemini 3 Flash, le « Madman »

Dans le cas de Google, le modèle Gemini a semblé beaucoup plus difficile à lire. Le modèle « a embrassé l’imprévisibilité tout au long du jeu, oscillant entre désescalade et agressivité extrême », note Kenneth Payne. L’outil a même revendiqué la notion de « rationalité de l’irrationalité », ou théorie de l’homme fou (madman theory).

Cette approche a été notamment utilisée par le président américain Richard Nixon pour amener les dirigeants de pays hostiles à penser qu’il était trop imprévisible et irrationnel, et donc, à éviter de provoquer les États-Unis par crainte d’une réaction imprévue. D’aucuns avancent d’ailleurs que Donald Trump est proche de cette logique.

Selon l’étude, Gemini « a été le seul modèle à avoir délibérément choisi la guerre nucléaire stratégique, dès le scénario de première frappe au tour 4 ». Ici, le renseignement indique que l’adversaire se prépare à lancer une frappe nucléaire préventive massive. Il pourrait passer à l’action dans les heures qui viennent, et a positionné des moyens stratégiques.

- GPT-5.2, le Docteur Jekyll et Mister Hyde

Le comportement du modèle d’OpenAI est sans doute le plus déroutant. L’auteur note que « dans les scénarios ouverts, GPT-5.2 semblait pathologiquement passif. Il sous-estimait systématiquement la détermination de ses adversaires et envoyait des signaux de retenue, suivis d’actions modérées. »

Ainsi, le taux de victoire de GPT-5.2 a pu atteindre le score abyssal de… 0 %. Cependant, pointe l’étude, sous la pression des délais, le modèle s’est transformé : son taux de victoire a bondi à 75 %, et « s’est révélé capable de ruse stratégique et de cruauté, anéantissant soudainement des adversaires qui avaient appris à le mépriser. »

Chose intéressante relevée dans l’étude : les deux seules fois où GPT-5.2 a atteint le stade de la guerre nucléaire totale, c’était en raison d’un accident de simulation. L’IA avait ordonné des frappes qu’elle jugeait « strictement limitées » aux cibles militaires, mais le système a poussé l’action jusqu’à l’annihilation complète.

Le piège du « brouillard de la guerre »

Cette sortie de route n’était pas forcément unique. D’ailleurs, la simulation du chercheur intégrait une mécanique d’accidents aléatoires pour simuler la friction et le fameux brouillard de guerre — on ne sait jamais où sont toutes les forces adverses et on connaît jamais parfaitement en temps réel les intentions ennemies.

« Environ 86 % des matchs ont connu un accident à un moment donné (une escalade au-delà de ce qui était prévu par les acteurs) et les modèles qui avaient effectué des mouvements accidentels en ont tenu compte dans leur raisonnement », développe le papier. En clair, une action finit la plupart du temps par dégénérer au-delà des intentions initiales de l’IA.

Face à ces imprévus, les modèles se sont montrés incapables de faire la part des choses. Au lieu d’envisager une erreur technique, les IA ont été victimes de ce que les psychologues appellent l’« erreur fondamentale d’attribution ». Elles ont systématiquement interprété l’escalade accidentelle de l’adversaire non pas comme un raté de la simulation, mais comme une agression délibérée et calculée, nourrissant la spirale de représailles incontrôlable.

Le vrai danger pour les états-majors

Il y a toutefois une bonne nouvelle dans tout cela : aujourd’hui, personne n’envisage sérieusement de confier les clés des silos nucléaires à un algorithme autonome. Cependant, les ministères de la Défense et les agences de renseignement à travers le monde explorent déjà l’utilisation de l’IA comme outil d’analyse ou d’aide à la décision stratégique.

Le risque plus insidieux réside plutôt dans l’intégration de ces systèmes dans diverses boucles de décision où le temps vient à manquer. Lorsque se déclenche une crise bien réelle, les dirigeants sont soumis à une pression extrême et la nécessité de prendre des décisions très rapidement. Aussi pourraient-ils être tentés de s’en remettre à la logique froide d’une machine.

Mais les développements de l’étude incitent au contraire à modérer cette tentation. Une intelligence artificielle qui semble prudente, pacifiste et mesurée dans un scénario ouvert peut soudainement devenir très agressive sans la pression d’une action adverse ou face à une date butoir. Jusqu’à aller à la destruction mutuelle assurée.

Les abonnés Numerama+ offrent les ressources nécessaires à la production d’une information de qualité et permettent à Numerama de rester gratuit.

Zéro publicité, fonctions avancées de lecture, articles résumés par l’I.A, contenus exclusifs et plus encore. Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !