Chacune des formes d’expression de l’être humain est désormais concernée par un modèle d’intelligence artificielle. ChatGTP imite notre façon d’écrire, Midjourney crée des tableaux, et il y a même MusicLM, l’IA de Google qui génère de la musique en version encore très expérimentale. Désormais, VALL-E propose de son côté de générer un message audio avec votre voix. Début janvier 2023, des chercheurs de Microsoft ont révélé la création de ce dernier modèle dans un article mis en ligne sur arvix, site de prépublications en ligne (des articles qui ne sont pas encore relus par des pairs). Ils annoncent qu’avec trois secondes d’enregistrement, VALL-E peut reproduire votre voix sur n’importe quel texte.

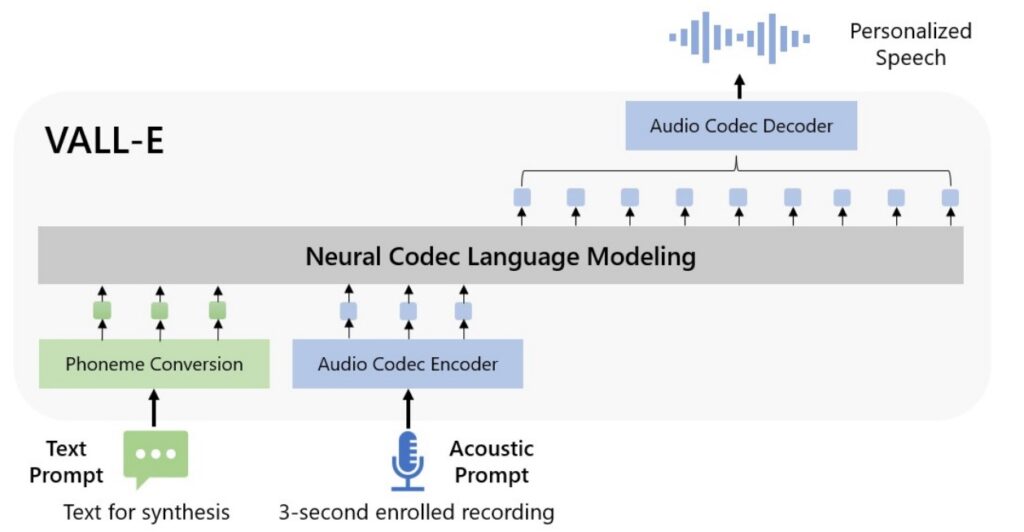

VALL-E est un modèle de génération de parole à partir de texte (text-to-speech synthesis ou TTS, en anglais). Comme son nom l’indique, un modèle capable de créer un enregistrement sonore qui déclame le discours de votre choix. Pour le faire fonctionner, il faut deux entrées. D’une part, un texte écrit, celui que l’on veut générer sous format audio. De l’autre, l’enregistrement d’une voix disant n’importe quel texte. Ce message peut ne durer que trois secondes, soit bien moins que ce que proposait Amazon — avec soixante secondes — l’an dernier.

Comme VALL-E ne comprend ni un texte audio, ni un texte écrit, chacun des deux est converti sous un format mathématique adapté au modèle. Puis, grâce à son entraînement, VALL-E sait comment passer du message audio introduit à celui qu’on veut lui faire dire avec la voix du locuteur de départ.

Un modèle qui dépasse les performances actuelles

Au final, le modèle doit rendre un fichier que nous sommes en mesure de comprendre, un message audio. Alors une étape de traduction est nécessaire, un peu l’inverse de celle au départ. « À la fin, on revient dans le domaine “réel” des ondes sonores, qui peuvent être jouées par des systèmes de sons », décrit Louis-François Bouchard, doctorant à l’Institut québécois d’intelligence artificielle et créateur de la chaîne What’s AI sur YouTube.

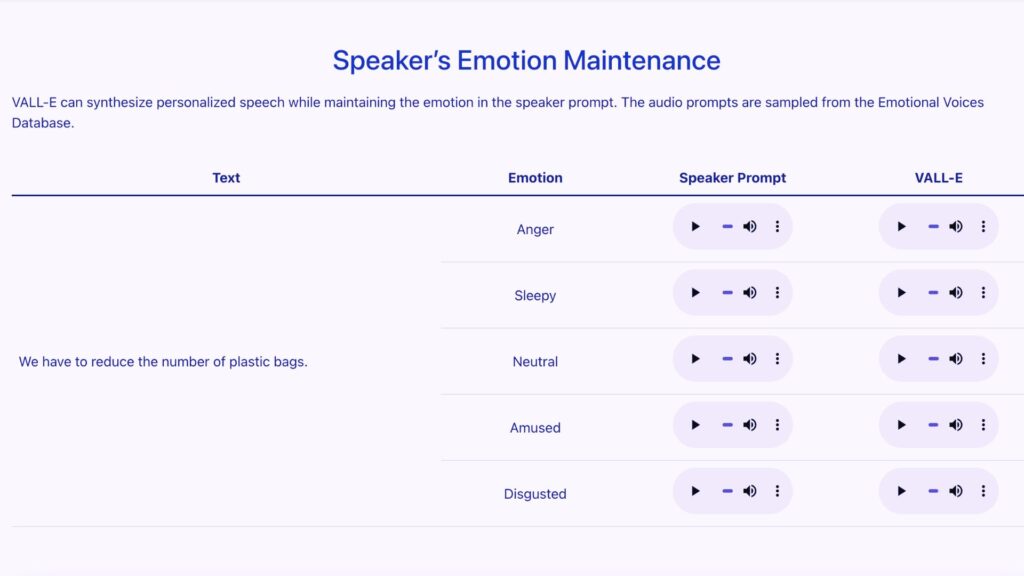

Les résultats semblent au rendez-vous : après des tests quantitatifs et qualitatifs, les chercheurs assurent avoir dépassé les performances des modèles actuels sur le réalisme — le message n’est pas à un discours robotique — et sur la ressemblance avec la voix de la personne. Pour le mesurer, ils ont notamment comparé les performances de VALL-E à celles de l’un des derniers modèles de génération de parole YourTTS. Sur le naturel ou le taux d’erreur par rapport au script, VALL-E a produit de meilleurs résultats. « Alors même que répliquer le réalisme reste extrêmement difficile », précise Louis-François Bouchard.

Pour rendre compte de la vraisemblance du message ainsi généré, une démonstration a été mise en ligne par l’équipe de Microsoft.

VALL-E ne marche encore qu’en anglais

Les modèles de génération de parole ne sont pas nouveaux, mais connaissent un essor de leurs performances grâce à l’intelligence artificielle. « Rien qu’en trois ans, on peut voir qu’il y a eu de grands progrès. Alors, j’ai vraiment hâte de voir la qualité de ces modèles dans quelques années », avoue Louis-François Bouchard. Pour VALL-E, c’est le corpus d’apprentissage qui fait la différence, il est composé de 60 000 heures d’enregistrement en anglais avec 7 000 personnes différentes. Pour YourTTS, le corpus ne contenait que quelques centaines d’heures.

Mais là où YourTTS a été entraîné sur de l’anglais, du français et du portugais, le corpus de VALL-E n’était composé que d’anglophones. Il n’est donc pas encore prêt à de la génération dans une autre langue. Et « il est certainement moins bon avec des accents qui n’étaient pas représentés dans la base de données d’entraînement », glisse Louis-François Bouchard.

Mais cela n’empêche pas d’imaginer le nombre « énorme d’applications de ces modèles dans l’audiovisuel, pour la simplification de la production ou la réduction des coûts », assure-t-il. Avec ces outils, il est facile de corriger un message où un mot a été écorché (plus besoin de le réenregistrer). Il serait également possible de créer automatiquement la traduction d’un discours en utilisant la même voix que le locuteur actuel.

La crainte de deepfakes vocaux

La production de contenus se retrouverait simplifiée à toutes les étapes avec l’intelligence artificielle. Encore faudrait-il que cela ne se fasse pas au détriment de la qualité… « C’est un outil qui peut être utile et utilisé totalement légalement. Mais il peut aussi être mal utilisé. Tout dépend des mains entre lesquelles il sera », estime Louis-François Bouchard.

Ces technologies font notamment craindre la diffusion de deepfakes. Surtout que toutes les étapes peuvent être automatisées avec les modèles de langue pour écrire le discours et des algorithmes de changement de visages (des face swappers) pour l’image.

« Il faudra être très vigilants dans ce que nous voyons et entendons en ligne »

Louis-François Bouchard

« Je pense qu’à l’avenir, il faudra être très vigilants dans ce que nous voyons et entendons en ligne », prévient Louis-François Bouchard. L’équipe de Microsoft est au courant de ces dangers. Ainsi explique-t-elle sur leur démonstration en ligne qu’avant de rendre publique l’utilisation du modèle, il faudra ajouter un protocole pour s’assurer que le locuteur approuve l’utilisation de sa voix.

De quelle manière cela sera-t-il mis en place ? Dans combien de temps pourrons-nous utiliser VALL-E ? Interrogé, Microsoft refuse encore de répondre explicitement à ces questions. « Nous continuons à nous concentrer sur VALL-E en tant que projet de recherche. Au fur et à mesure que des cas d’utilisation réalisables seront définis, nous vérifierons qu’ils sont conformes à nos principes en matière d’IA », se contentent-ils de nous dire. Affaire à suivre donc.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !