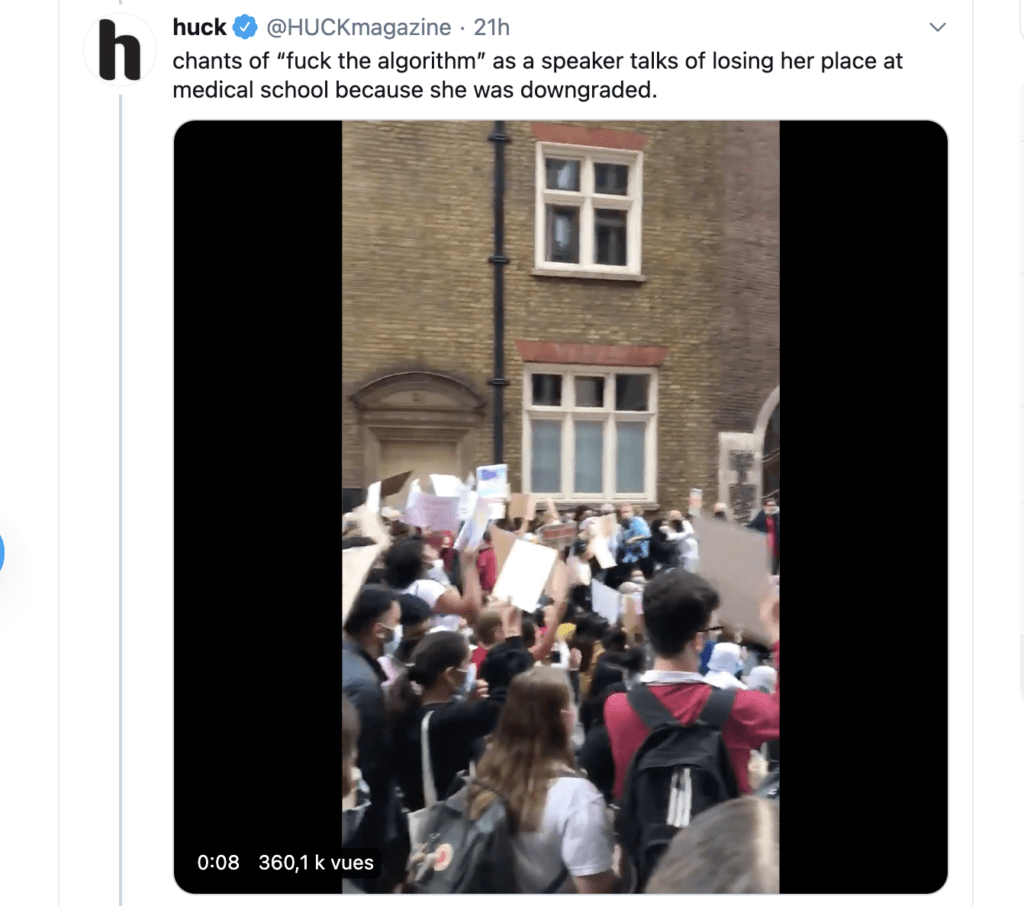

« Fuck the algorithm », pouvait-on entendre dans les rues de Londres, plus précisément devant le ministère de l’Éducation. À cette injonction qui semble tout droit sortie d’un scénario d’anticipation, d’autres étudiants répondaient « Fuck Eton », du nom de cette institution réservée à l’éducation de l’élite anglaise. Quel est le rapport entre un algorithme et une école privée ? La réponse tient en un énoncé : les résultats d’admission aux grandes écoles et universités anglaises pour cette année universitaire chamboulée par une pandémie hors du commun.

Mais dans les faits, le malaise est plus profond que cela.

Un père inquiet avait prévenu les autorités

Tout commence, comme à chaque fois en 2020, au beau milieu de la pandémie de coronavirus. Alors que les institutions comprenaient que les examens de fin d’année ne pourraient avoir lieu, l’Ofqual, pour Office of Qualifications and Examinations Regulation, organe de l’état anglais chapeautant les concours, a pris une décision : utiliser un algorithme qui permettrait d’harmoniser les notes, afin qu’elles ne soient pas trop revues à la hausse. L’institut craignait en effet qu’une admission aux écoles basée sur le contrôle continu et donc des notes de professeurs ne suffirait pas à neutraliser les résultats comme peut le faire un examen anonyme que tout le monde passe dans les mêmes conditions.

La petite histoire dans la grande, que raconte brillamment le Guardian, permet de voir ce qui s’est mal passé. Même si l’Ofqual a assuré que l’algorithme s’assurerait qu’il n’y aurait pas trop de différences en moyenne entre les notes des années précédentes et celles de 2020, un père a douté. Huy Duong, craignant que son fils scolarisé dans un lycée public ne puisse pas accéder à la prestigieuse Oxford à cause de l’algorithme, a utilisé toutes les informations à sa disposition pour voir si un problème pourrait avoir lieu.

Docteur en physique et aidé de sa sœur, statisticienne, Huy Duong a tenté de comprendre le modèle statistique que l’Ofqual utiliserait pour normaliser les notes. Il est arrivé à une conclusion : « 39 % des notes entre A* (ndlr, la plus haute) et D seront abaissées par rapport à ce que les professeurs auront jugé ». Sa découverte a été communiquée à l’office en question. Dans le même temps, étudiants et médias commençaient aussi à questionner la capacité de cet algorithme à rendre justice aux étudiantes et étudiants. Ce qui devait arriver arriva : le fils de Huy Duong a finalement reçu une note légèrement inférieure par rapport à celle qu’il attendait et qu’il avait reçue toute l’année. Une excellente note, mais qui ne lui ouvrait pas la porte d’Oxford. Pour la famille, le coupable était clair : l’algorithme.

Parfois, des suspicions de ce type ne sont pas avérées. D’autres fois, les organismes publics ne reconnaissent jamais une erreur. Mais dans le cas du système anglais, un aveu a mis le feu aux poudres : l’Ofqual a admis que 39,1 % des élèves dans le pays ont reçu une note inférieure à ce qu’ils auraient dû recevoir, notamment dans la catégorie des notes les plus élevées (les « A »). Le calcul de Huy Duong et de sa sœur était donc presque exact et le comité n’a rien fait.

Cela a été résumé assez fidèlement par nos confrères anglais par une « punition statistique ». L’algorithme a fait au mieux, essayant de limiter la casse en général et a sacrifié 39,1 % de cas particuliers pour atteindre son objectif chiffré. Une normalisation qui, pour ces étudiantes et étudiants, ne passe pas : « comment l’algorithme peut-il savoir qu’il a baissé la note d’un étudiant qui a été surnoté ? », s’interroge Huy Duong.

Du confinement à la rue

Ce cri d’injustice est répété dans la rue. Huck Magazine a suivi cette protestation sur Twitter et rapporte que des étudiants rassemblés devant des lieux du pouvoir anglais ont brûlé leurs notes, même les meilleures. Certains pleuraient, d’autres énonçaient ce qu’ils avaient perdu à cause de cette normalisation — des entrées dans les prestigieuses écoles du pays pour certains, l’accession à des classes supérieures pour d’autres.

Une autre accusation émerge contre le système d’Ofqual, notamment dans les rangs du Labour, la gauche anglaise : les notes des lycées privées ont été algorithmiquement préservées. Pour la députée Angela Rayner, dans un entretien donné à iTV, les élèves des zones défavorisées auraient été bien plus touchés que ceux des établissements les plus prestigieux et les plus onéreux. « Dans les quartiers du nord-est ou du nord-ouest, que je représente, les enfants ont eu des notes dévaluées, bien plus d’une fois », estime-t-elle.

https://twitter.com/carolecadwalla/status/1295277889412304897

Si cela était confirmé, ce qui n’est pas le cas pour l’instant, le scandale serait double pour l’éducation anglaise : l’algorithme aurait puni injustement, mais en plus, l’humain a fait en sorte de préserver une partie de la population au détriment d’une autre.

En France, ParcourSup, algorithme de classement et non de notation, n’a pas échappé à une vague de critiques, parfois légitimes.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !