Quand on parle de deepfakes, c’est souvent pour évoquer de fausses vidéos mettant en scène des personnalités politiques. Pourtant, ce type de contenus ne serait vraiment pas le plus courant. Deeptrace, une entreprise spécialisée dans la cybersécurité, a publié un rapport à ce sujet ce 7 octobre. 96 % des vidéos qu’elle a pu trouver en ligne étaient des deepfakes de nature pornographique.

Des contenus pornographiques très populaires

Les deepfakes sont des vidéos si bien manipulées grâce aux outils technologiques qu’elles semblent réelles. Deeptrace a analysé plusieurs milliers d’entre elles. Elle a étudié à la fois des sites pornographiques dédiés aux deepfakes, des sites pornographiques mainstream, des hébergeurs de vidéos comme YouTube, Vimeo ou Dailymotion, les résultats de recherches Google et des forums (Reddit, 4chan, 8chan, etc).

96 % des contenus sont décrits comme des contenus pornographiques non consentis. Il s’agissait notamment de stars (actrices, chanteuses, etc) dont le visage avait été rajouté sur le corps d’une actrice pornographique.

Sur 4 gros sites dédiés aux contenus pornographiques de type deepfakes, les spécialistes estiment que ces vidéos ont généré 134 millions de vues, depuis décembre 2018. Le nombre de vidéos y aurait doublé ces 7 derniers mois, passant d’environ 7 000 à plus de 13 000. Ces sites spécialisés hébergeaient pour la plupart des contenus de nature pornographique, à savoir plus de 13 000. Les sites pornographiques mainstream n’en contenaient que 800 environ.

Seules quelques vidéos ont été qualifiées de tentatives de manipulation politique, notamment au Gabon et en Malaisie. L’une d’entre elles était en lien avec un coup d’État et aurait pu avoir de fortes implications politiques, selon les auteurs de l’enquête.

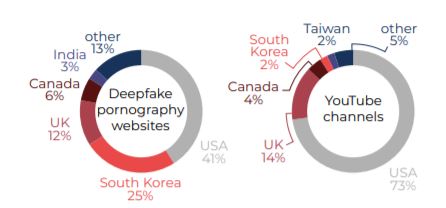

Le rapport nous en apprend un peu plus sur l’origine des deepfakes pornographiques : bon nombre d’entre eux seraient créés grâce à des outils numériques par des internautes chinois ou sud-coréens. « Pourtant, nous n’avons étudié que des sites anglophones », précise le rapport.

Des manipulations politiques ?

Ces derniers mois, les techniques se sont perfectionnées et les craintes concernant les deepfakes se sont logiquement accrues. Beaucoup craignent notamment que ces contenus soient utilisés à des fins de manipulation politique.

Les personnalités politiques sont en effet une cible de choix pour les deepfakes. Le dernier en date met en scène Donald Trump. Créé par l’association française Solidarité Sida, il fait dire au président des États-Unis que « le sida c’est fini ». Il s’agit d’un faux, comme le rapporte Le Figaro. En l’occurrence, il a pour objectif de sensibiliser à une cause. Mais cela peut aussi s’apparenter à de la désinformation, car il n’est pas précisé qu’il s’agit d’un montage.

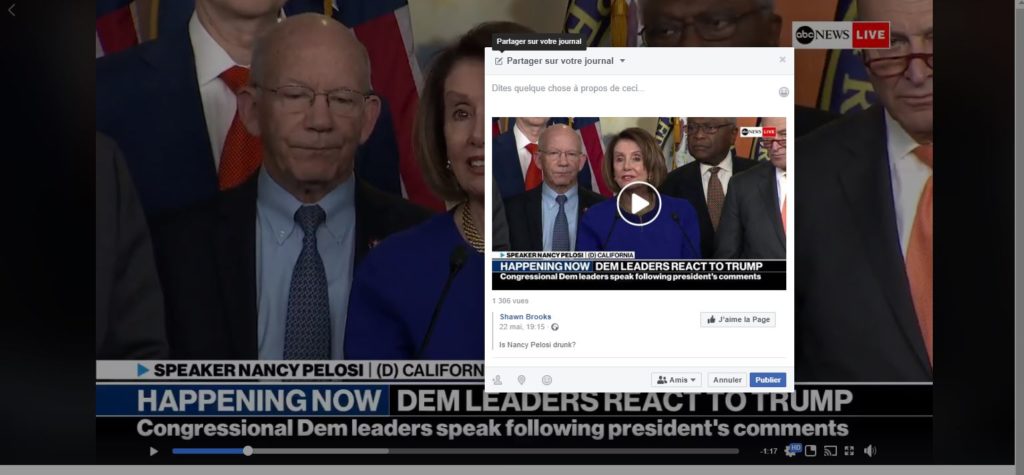

En mai 2019, Nancy Pelosi, la présidente de la chambre des représentants américaine, a fait l’objet de tentatives de déstabilisation, grâce à une vidéo deepfake. On l’y voyait prononcer un discours en bafouillant. Elle semblait confuse, sinon ivre. Le montage avait été largement partagé sur les réseaux sociaux — y compris par Donald Trump –, malgré des efforts pour faire cesser sa diffusion.

Rien ne nous indiquait au premier abord qu'il s'agit d'une fausse vidéo.

Source : Capture d'écran Facebook / NumeramaLes femmes, premières victimes de ces montages

La pornographie a toujours été liée aux deepfakes, depuis leurs débuts. Dès 2017, une vidéo avec une fausse Gal Gadot avait été créée. Le visage de l’actrice et mannequin avait été incrusté sur le corps d’une actrice pornographique.

Plus récemment, un site a été épinglé car il permettait de « dénuder » des célébrités. Il a depuis été supprimé par son créateur et banni de GitHub. Le point commun de ces histoires est le fait que ce sont à chaque fois des femmes qui font les frais de telles manipulations. Selon le rapport de Deeptrace, elles représenteraient… 100 % des victimes sur les sites pornographiques dédiés aux deepfakes. « C’est un phénomène qui cible exclusivement les femmes, est-il écrit. À l’inverse, les deepfakes non-pornographiques analysés sur YouTube contenaient principalement des hommes. »

Plus de 90 % des sujets de deepfakes sur YouTube étaient des occidentaux, estime le rapport. En revanche, lorsque l’on s’intéresse aux deepfakes de sites pornographiques, près d’un tiers des vidéos ont pour victime des personnes sud-coréennes. Il s’agirait principalement de stars de K-pop, un genre musical populaire partout dans le monde. 99 % des victimes viennent aussi du milieu du divertissement (cinéma, musique, art, etc).

Rares sont les États à avoir pris des mesures spécifiquement dédiées aux deepfakes pornographiques pour le moment. En Virginie, une telle pratique est depuis quelques mois considérée comme un délit de revenge porn.

En France, la loi interdit la diffusion de montages pornographiques. Dans l’article 226-8 du Code pénal, on lit : « Est puni d’un an d’emprisonnement et de 15 000 euros d’amende le fait de publier, par quelque voie que ce soit, le montage réalisé avec les paroles ou l’image d’une personne sans son consentement, s’il n’apparaît pas à l’évidence qu’il s’agit d’un montage ou s’il n’en est pas expressément fait mention ».

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !