La vidéo a été visionnée des millions de fois sur Internet. Nancy Pelosi, la présidente de la chambre des représentants américaine, y prononce un discours peu clair, en bafouillant. Elle semble ne pas trop savoir ce qu’elle dit, voire être trop alcoolisée. En réalité, il s’agit d’un montage visant à discréditer la Démocrate. Sa viralité est telle que Donald Trump lui-même l’a partagée sur son compte Twitter. La vidéo a été rapidement supprimée de YouTube, mais pas de Facebook, où elle continue à circuler. Le réseau social s’en est justifié vendredi 24 mai.

Laisser le choix aux utilisateurs d’y croire ou non

Monika Bickert est la responsable des politiques globales chez Facebook. Dans une interview accordée à CNN, elle est revenue sur l’histoire de la vidéo, qui a été identifiée comme fausse par de nombreux experts — on le voit sur ces images à partir de 2’46.

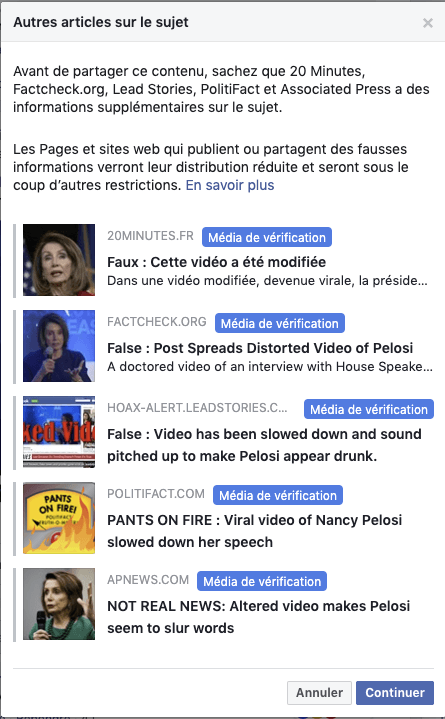

Elle confirme dans cette interview que le fait de laisser la vidéo virale en ligne était bien un choix éclairé. Au lieu de la supprimer, le réseau social a fait en sorte de limiter sa portée : ses algorithmes la recommandent moins par exemple. Par ailleurs, les utilisateurs qui voudraient la regarder verront apparaître un encadré. Réalisé par des équipes de fact-checking avec lesquelles Facebook travaille depuis quelques années, il précise que la vidéo a été identifié comme étant fausse.

Selon Monika Bickert, il serait important de laisser le « choix » aux utilisateurs de croire ou partager ce qu’ils souhaitent. « Nous pensons qu’il est important que les gens fassent leurs propres choix, éclairés, sur ce à quoi ils veulent croire, a-t-elle dit. Notre travail est de s’assurer qu’ils aient accès à l’information nécessaire. »

Les fausses informations ne sont en soit pas interdites de Facebook. Elles ne sont supprimées que lorsqu’elles peuvent avoir des conséquences directes : par exemple, si elles incitent à la violence, le réseau social les bannit. Monika Bickert estime que Facebook n’est pas « un média, mais un réseau social ».

Est-ce vraiment efficace ?

Facebook et les autres plateformes, comme Twitter et YouTube, peinent à faire face à la désinformation. Supprimer de faux contenus n’est pas aisé. Aussitôt sont-ils bannis, que des copies sont généralement republiées. La question de la censure centralisée, aux mains des plateformes, se pose également : doivent-elles, elles seules, faire le tri ? Privilégier plutôt des encadrés informatifs n’est donc à priori pas absurde.

Cependant, l’efficacité de cette méthode pose doublement question. D’abord, on peut se demander si tous les utilisateurs liront les informations données par les fact-checkeurs, et si ils seront susceptibles d’y croire, dans une période de grande défiance envers les médias et Facebook, régulièrement accusés de manipulation. En 2017, Facebook expliquait que toutes les méthodes n’était pas efficaces. Le fait d’ajouter un drapeau sur les informations indiquées comme étant fausses ne fonctionnait pas vraiment, mais les articles connexes seraient eux plus utiles, selon l’entreprise.

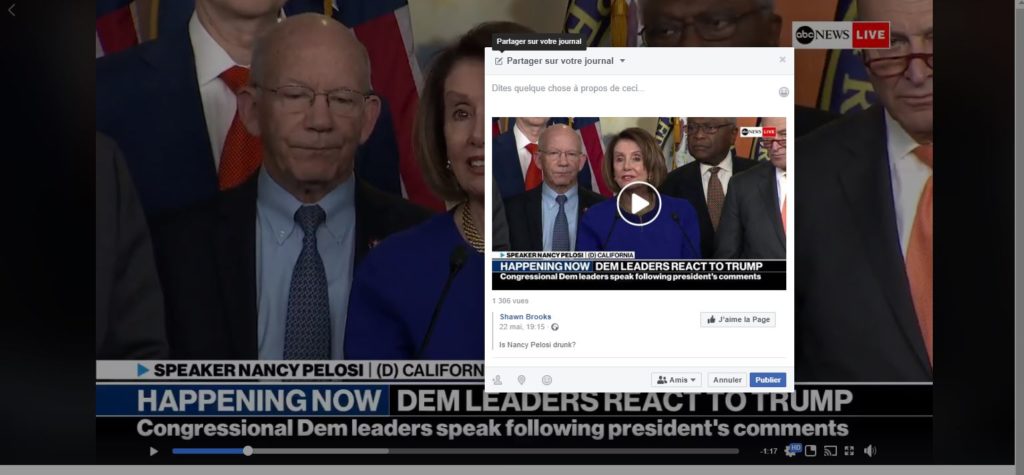

Par ailleurs, l’encadré ne semble pas apparaître systématiquement. Nous avons cherché la vidéo sur Facebook, et l’avons trouvée sans aucune peine, en tapant « Pelosi drunk » (Pelosi saoule). Nous avons cliqué sur 5 vidéos au hasard et nous n’avons vu d’encadré informatif sur aucune d’entre elles. En essayant de partager le contenu, là encore, aucune mise en garde n’a été faite.

Facebook nous a pourtant confirmé qu’ils avaient bien été appliqués aussi en France.

Rien ne nous indiquait au premier abord qu'il s'agit d'une fausse vidéo.

Source : Capture d'écran Facebook / NumeramaLes articles des fact-checkers devraient normalement apparaître à deux endroits : dans la section « articles connexes » si la vidéo apparaît sur votre fil d’actualité, ou lorsque vous essayez de partager la vidéo. Les utilisateurs qui l’ont déjà partagée reçoivent en théorie une notification leur indiquant qu’il s’agit d’un faux.

Le problème des deep fake

Cette affaire remet aussi en avant la problématique des deep fake. Il s’agit de contenus, photos ou vidéos, tellement bien manipulés et retouchés, notamment par de puissants algorithmes, qu’ils semblent vrais. Ce n’est pas la première fois qu’ils sont utilisés à des fins de manipulation politique.

En novembre 2018, la Maison Blanche avait utilisé une vidéo très modifiée pour justifier de l’éviction d’un journaliste. De fausses déclarations de Barack Obama avaient également été réalisées, même si elles n’avaient pas servi pour manipuler l’opinion.

Twitter n’a pas souhaité commenter le cas de la vidéo de la démocrate Nancy Pelosi. YouTube de son côté, a supprimé des copies de cette vidéo.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !