C’est tout bonnement extraordinaire. Alors que la société britannique DeepMind, une filiale de Google, a déjà réussi à terrasser assez aisément l’élite mondiale du jeu de go grâce à un système d’intelligence artificielle extrêmement performant, AlphaGo, voilà qu’une nouvelle version de ce programme informatique vient d’être révélée au public. Et celle-ci est encore plus efficace pour remporter des parties.

Le nom de cette nouvelle version ? AlphaGo Zero. « Zéro », car la particularité de cette mouture est qu’elle est capable de progresser toute seule au jeu de go, sans l’aide de personne. Il lui suffit simplement de jouer sans relâche contre elle-même, des millions de fois, pour atteindre de nouveaux sommets à ce jeu de plateau ancestral tout droit venu de Chine. C’est une approche complètement différente.

Jusqu’à présent, DeepMind exposait AlphaGo à des parties jouées à très haut niveau par des êtres humains pour lui montrer le fonctionnement du jeu de go, les stratégies qui donnent des résultats et les coups gagnants. Il s’agissait alors d’apprentissage supervisé, DeepMind injectant des données utiles dans le programme informatique pour améliorer son niveau de jeu.

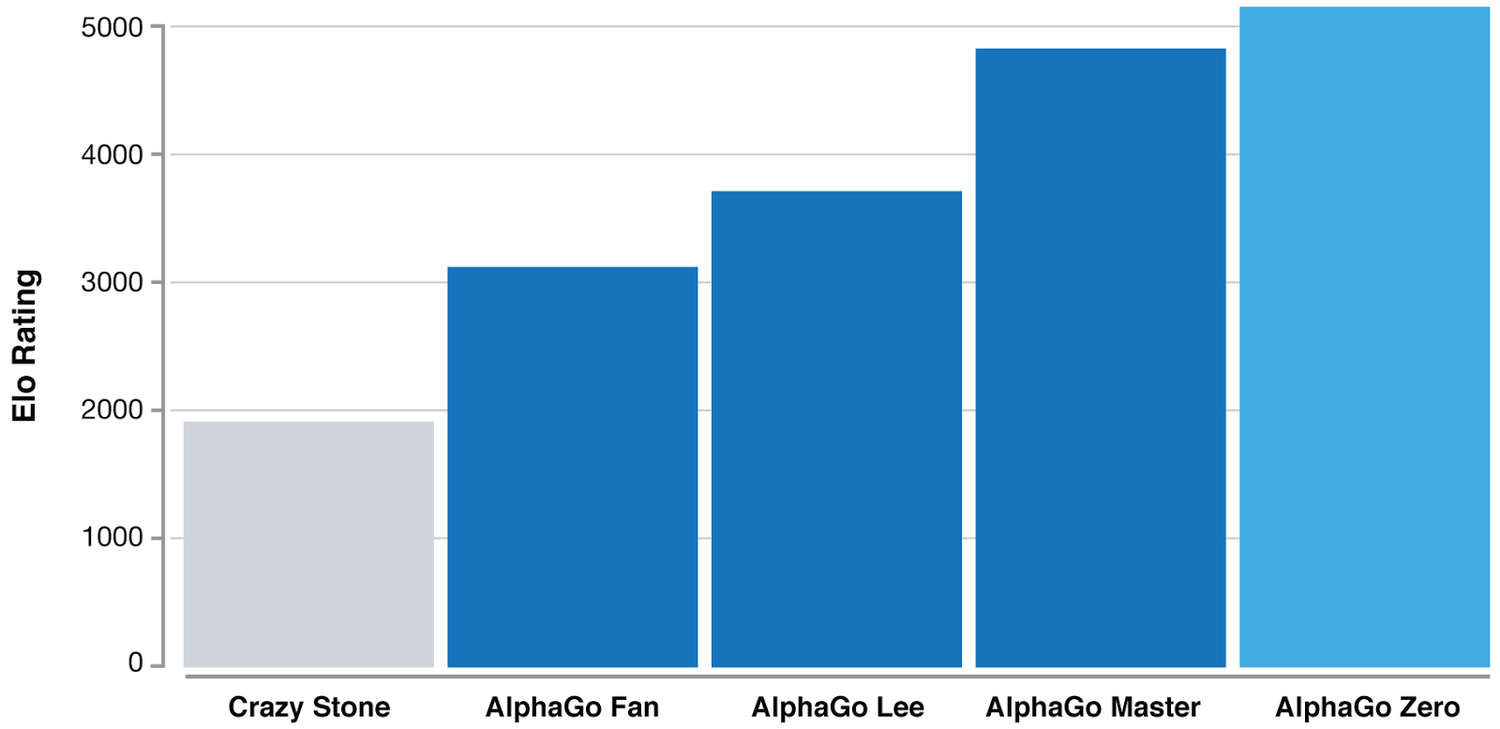

Cette approche était ensuite complétée par de l’apprentissage par renforcement, qui consiste à faire s’affronter deux instances d’AlphaGo. Cela a payé : en 2015, le programme bat le champion européen en titre de go, Fan Hui ; en 2016, il se paie Lee Sedol, l’un des meilleurs au monde ; puis, en 2017, il défait le champion actuel ainsi que tout le gratin invité lors d’un évènement, même dans un format de cinq contre un.

Ici, AlphaGo Zero n’a pas fait appel à de l’apprentissage supervisé pour progresser. Seul de l’apprentissage par renforcement a été utilisé. La seule aide dont a bénéficié AlphaGo Zero est un livre de règles, qui a été intégré au programme, afin de lui permettre de savoir de quelle façon une partie se déroule (utilisation des pierres sur le plateau, principe du tour par tour, notions de territoire, calcul des points, etc).

Une fois les règles intégrées, AlphaGo s’est lancé sans aucune assistance humaine, d’abord avec maladresse puis, au fil des parties contre lui-même, avec talent : les coups aléatoires ont progressivement été remplacés par une stratégie de plus en plus élaborée. Néanmoins, cela ne s’est pas fait en un clin d’œil : il a fallu jouer des millions de fois pour qu’il gagne en compétence.

100 victoires à 0

Résultat des courses ? La version d’AlphaGo qui a été utilisée contre Lee Sedol et qui avait donc déjà donné de très bons résultats (victoire à l’époque 4 points à 1) a été écrasée 100 à 0. Il n’a fallu que trois jours d’entraînement à AlphaGo Zero pour en arriver là (trois jours qui ont toutefois permis de jouer des millions de parties, celles-ci étant jouées à un rythme bien plus soutenu que ce qu’on l’on peut voir d’ordinaire).

Ainsi, AlphaGo Zero a dû jouer 4,9 millions de parties contre lui-même pour balayer la mouture AlphaGo Lee. C’est beaucoup, mais c’est quand même six fois moins de parties que ce qu’a dû ingérer AlphaGo Lee lorsqu’il a dû affronter Lee Sedol en 2016.

Selon DeepMind, au bout de trois heures d’entraînement, AlphaGo Zero joue comme un débutant. Au bout de 19 heures, il a intégré des fondamentaux utilisés dans les parties avancée; et au bout de 70 heures, il a déjà atteint un niveau surhumain.

Pour surclasser AlphaGo Master, la version d’AlphaGo qui a été utilisée pour vaincre Ke Jie, le champion actuel du jeu de go, AlphaGo Zero a eu besoin d’un peu plus de temps : il a fallu attendre le 21e jour d’entraînement pour qu’AlphaGo Zero arrive à son niveau. Et au bout du 40e jour, AlphaGo Zero est devenu bien plus fort que n’importe quelle autre mouture du programme informatique.

Cette approche « est plus puissante que les versions précédentes d’AlphaGo car elle n’est plus restreinte par les limites de la connaissance humaine », explique DeepMind dans un billet de blog. « Au lieu de cela, AlphaGo est capable d’apprendre à partir de zéro auprès du joueur le plus fort au monde: AlphaGo lui-même ». Le pas franchi est tel qu’il a même fait l’objet d’un article publié dans Nature, une revue scientifique très réputée.

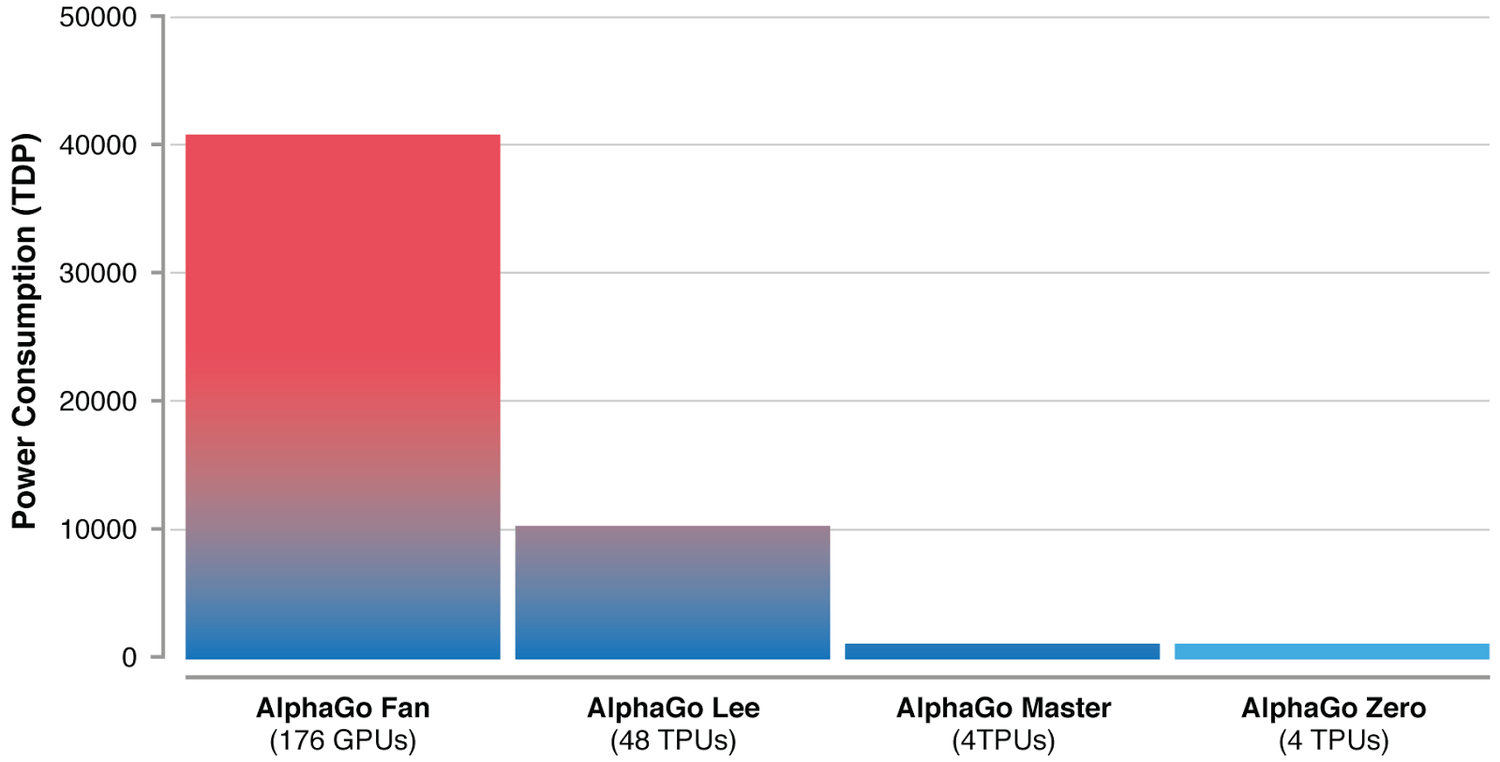

De plus, AlphaGo Zero a bénéficié d’optimisations techniques lui permettant de ne pas être uniquement plus efficace au jeu de go : le programme informatique sollicite désormais bien moins de ressources informatiques pour fonctionner.

Quoiqu’il en soit, Google a de quoi être très fier des progrès accomplis par DeepMind en l’espace de trois ans. Surtout que le développement de cette version du logiciel est sans doute la meilleure réponse que sa filiale peut faire aux critiques qui étaient apparues au moment du match entre AlphaGo et Lee Sedol, en 2016. Critiques formulées entre autres par Yann LeCun.

Rivalités chez les géants du net

L’intéressé, l’un des pionniers de l’apprentissage profond, également professeur à New York et directeur du laboratoire d’intelligence artificielle de Facebook à Paris, avait ainsi cherché à remettre les choses en perspective : « maintenant, pouvez-vous faire la même chose en passant uniquement par l’apprentissage par renforcement, sans un réseau de neurones à convolution pré-entraîné avec des jeux enregistrés entre humains ? », avait-il écrit à l’issue du deuxième match.

C’est visiblement ce que vient d’accomplir Google, puisque le réseau de neurones qui sert à faire jouer AlphaGo est aujourd’hui capable, à partir des seules règles de go, de devenir invincible, sans jamais avoir recours à des parties enregistrées entre humains. Mais au-delà des batailles aux enjeux stratégiques qui se cachent derrière ces propos, qui traduisent une forte rivalité entre les géants du net sur le terrain de l’IA, ce développement constitue une formidable promesse pour l’avenir de l’intelligence artificielle.

Nouveauté : Découvrez

La meilleure expérience de Numerama, sans publicité,

+ riche,

+ zen,

+ exclusive.

Si vous avez aimé cet article, vous aimerez les suivants : ne les manquez pas en vous abonnant à Numerama sur Google News.