Pour prouver à Mark Zuckerberg à quel point il avait tort de minimiser l’impact des articles de désinformation sur Facebook, Daniel Sieradski, un journaliste indépendant de 37 ans, a réalisé une extension de navigateur permettant de vérifier la véracité d’une actualité sur le réseau social.

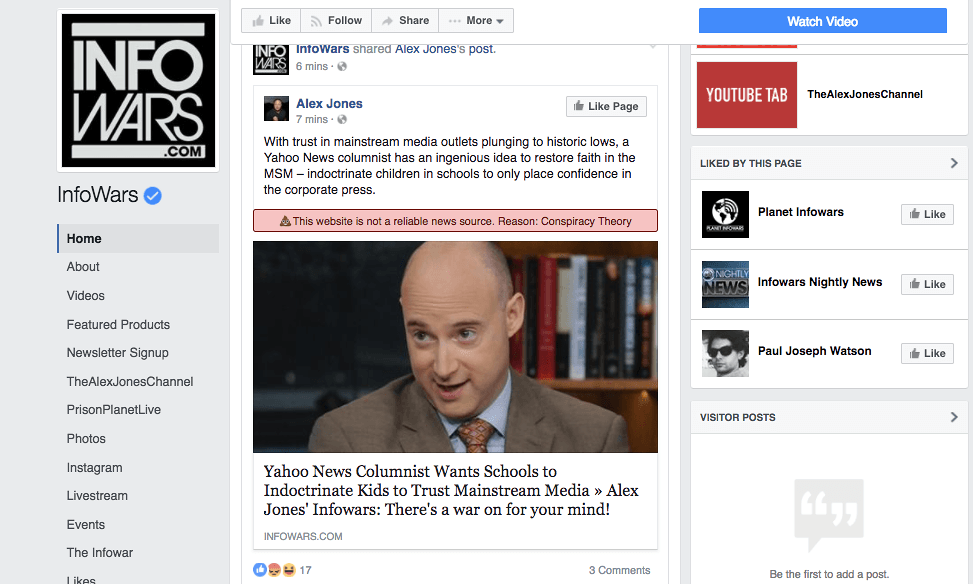

Une fois installé, le « BS Detector » (« détecteur de conneries ») ajoute au-dessus des articles erronés ou mensongers un avertissement explicite — « Ce site n’est pas une source fiable d’actualité » — accompagné d’une précision (« Motif : théorie du complot », par exemple).

Le BS Detector, qui aurait été téléchargé plus de 25 000 fois selon son créateur, repose sur un principe simple : il compare les liens postés sur Facebook avec sa compilation — mise à jour régulièrement — de sites d’actualité d’une fiabilité douteuse. Si l’extension détecte une concordance entre les deux, elle déploie alors son avertissement sur fond rouge. La méthode permet aussi de classer les actualités selon différentes catégories : fausse information, satire, article très orienté, théorie conspirationniste…

Quand l’outil anti-désinformation alimente lui-même une fausse actualité

Ironiquement, le détecteur de désinformation a lui-même alimenté indirectement ce fléau après l’annonce, par le site spécialisé TechCrunch, du déploiement d’un outil anti-désinformation par Facebook. Le média avait visiblement oublié qu’il avait simplement téléchargé le BS Detector auparavant et que celui-ci était activé…

Sieradski est sidéré par cette méprise : « Je pense que c’est l’une des choses les plus métaphysiques que j’ai pu voir : une fausse actualité à propos d’un détecteur de fausse actualité. » Il s’empresse de contacter le média pour souligner cette erreur. TechCrunch met son article à jour.

Pour Daniel Sieradski, « la prolifération de la désinformation a sérieusement réduit la capacité des gens à faire des choix en connaissance de cause quand il s’agit de politique. » À ses yeux, il est donc fondamental de rétablir des filtres et des avertissements.

Facebook a d’abord bloqué le lien vers l’extension avant de reculer

Visiblement gêné par l’initiative de Sieradksi et de son détecteur, Facebook n’a pas tardé à bloquer la diffusion, sur sa plateforme, du lien menant au GitHub de l’extension, pour « des raisons de sécurité » selon le message d’erreur adressé aux utilisateurs qui souhaitaient le partager.

Le créateur de l’extension explique au Guardian que selon lui « ce n’est évidemment pas pour des raisons de sécurité, car l’extension n’affecte aucun paramètre de sécurité. Cela n’affecte pas l’intégrité de Facebook, l’extension ajoute seulement des éléments HTML sur une page. Elle ne fait rien de malveillant… Je pense que [Facebook] n’a pas du tout aimé l’article de TechCrunch. »

Si Facebook n’a pas répondu aux sollicitations du quotidien anglais sur la question, il a toutefois fini par débloquer le lien quelques heures après, en prétendant avoir fait une erreur. Exactement comme M. Sieradski l’avait lui-même prévu dans un tweet :

https://twitter.com/selfagency/status/804708836133244928?ref_src=twsrc%5Etfw

En fin de compte, l’histoire nous révèle surtout la grande méfiance du monde de la presse technologique sur la volonté de Facebook l’idée de régler le problème de la désinformation.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !