Sur les réseaux sociaux, les algorithmes sont capables (avec plus ou moins d’efficacité et parfois des biais) de légender le contenu d’une photo. Cela revient à interpréter le contenu d’une image pour en tirer une description. Une intelligence artificielle du nom de Dall-E sait faire l’inverse : créer une image à partir d’un texte.

Dall-E a été conçu par OpenIA. La société américaine s’est récemment illustré avec l’outil appelé GPT-2, qui a fait polémique pour sa capacité à produire des paragraphes proches de ceux écrits par un humain — l’IA est alors censée pouvoir faire des articles ou des poèmes. Estimant que ce modèle était trop dangereux car trop puissant, ils ont renoncé à publier le code. Puis ils ont finalement publié une version plus légère, appelée GPT-3, qui reste tout à fait puissante puisqu’elle a trompé un site comme HackerNews cet été 2020.

Ce que Dall-E peut faire

Dall-E est un réseau de neurones artificiels basé sur le code de GPT-3. Pour GPT-3, il faut entrer auprès de l’algorithme un certain nombre d’entrées textuelles, qui servent de thèmes sur lesquels l’IA extrapole pour produire un résutlat sous forme de texte. Dall-E fonctionne exactement pareil, à la différence que l’algorithme répond aux entrées en produisant des images plutôt que des textes.

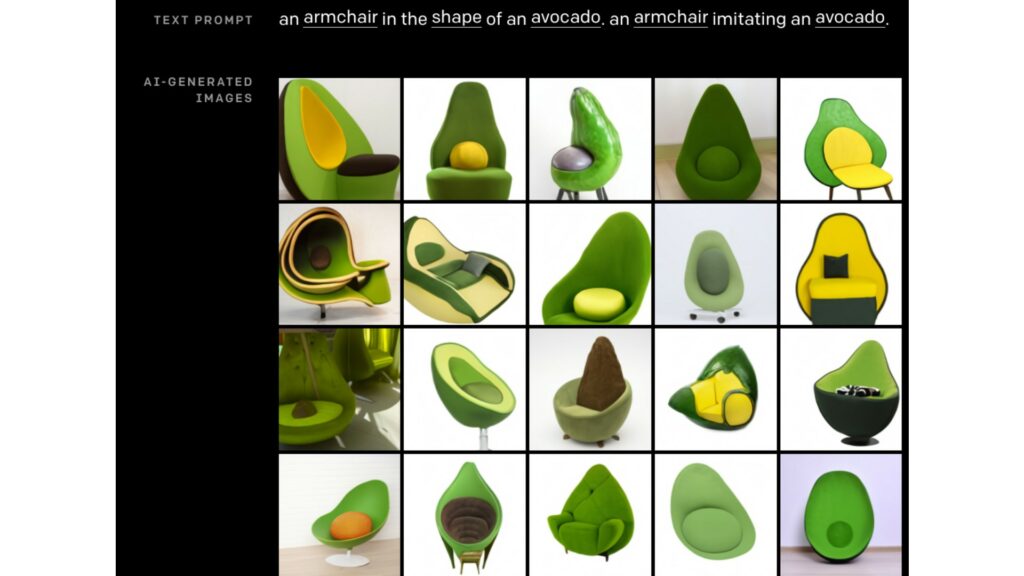

Par exemple, avec l’entrée « un fauteuil de bureau en forme d’avocat », Dall-E va générer une image on ne peut plus ressemblante à cette pourtant étrange description, que ce soit sur les couleurs, les formes. Cela reflète, selon OpenIA, sa « capacité à produire un objet qui semble pratiquement fonctionnel » tout comme sa capacité à générer quelque chose à partir de deux idées qui n’ont théoriquement rien à voir entre elles.

Source : OpenIA

« Nous avons constaté que [Dall-E] possède un ensemble de capacités diverses, notamment la création de versions anthropomorphes d’animaux et d’objets, la combinaison de concepts sans rapport entre eux de manière plausible, le rendu de texte et l’application de transformations à des images existantes », explique OpenIA.

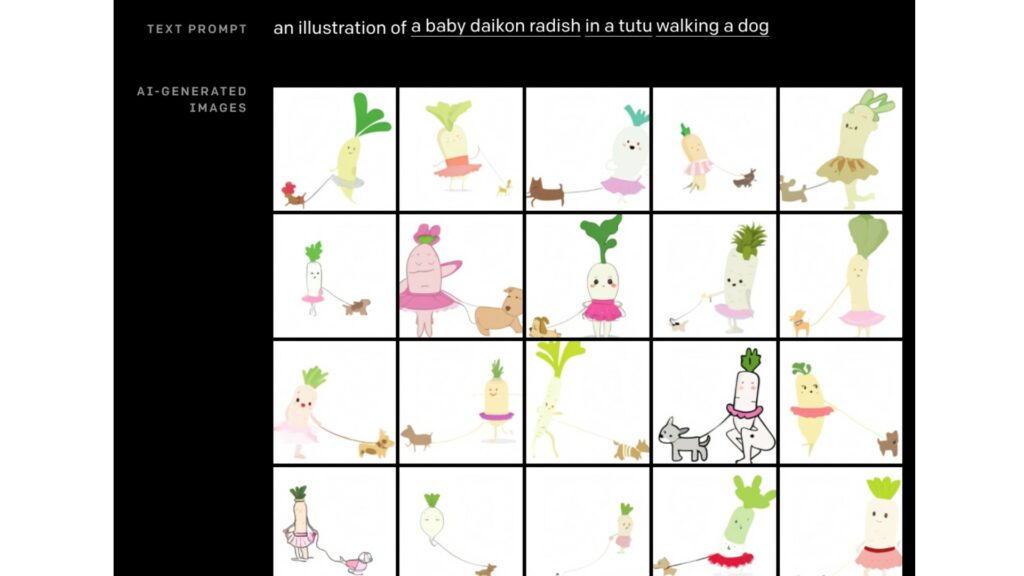

Pour l’image ci-dessous, l’entrée était un « bébé radis blanc dans un tutu promenant un chien ». On constate que la présence de caractéristiques humaines dans la légende — on n’imagine pas naturellement un radis dans un tutu en train de promener un animal — a provoqué la génération d’un radis anthropomorphisé.

Source : OpenIA

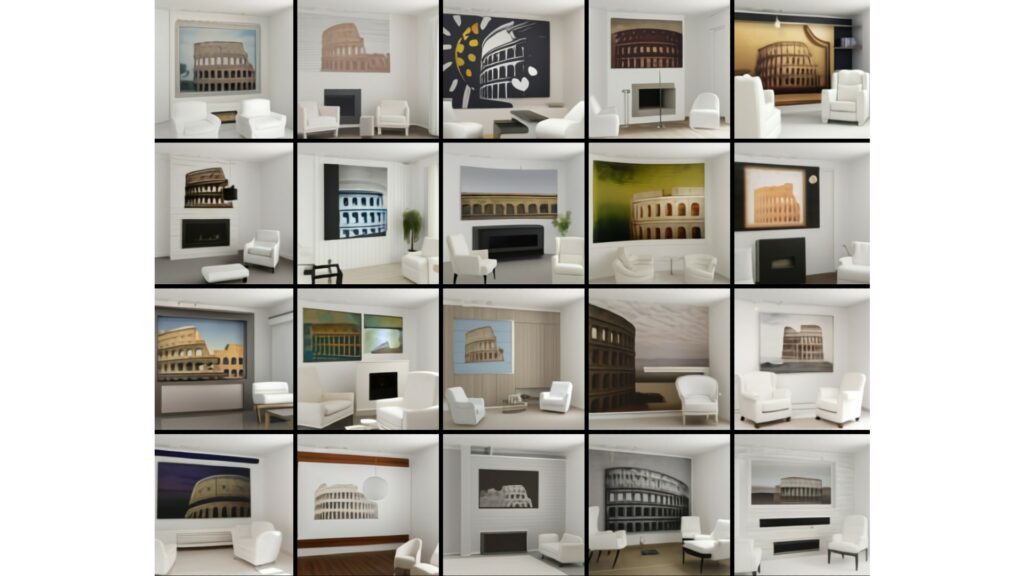

OpenIA montre par ailleurs sur son site internet qu’il ne s’agit pas seulement d’un même modèle appliqué systématiquement. Sur un même sujet, aux entrées variées, comme « un salon avec deux fauteuils blancs et un tableau du Colisée. Le tableau est monté au-dessus d’une cheminée moderne », Dall-E génère plusieurs possibilités.

Source : OpenAI

D’autres paramètres complexes peuvent être compris par l’IA, comme une image de nuit ; un certain type de peintures ; un focus spécifique. Il faut en tout cas garder à l’esprit qu’il s’agit d’un réseau de neurones artificiels qui a été entraîné pour accomplir cette tâche précise, cela ne relève donc pas d’une créativité pure ni d’une forme d’intelligence.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !