Vous êtes propriétaire d’une enceinte connectée, comme l’Amazon Echo Dot ou bien le Google Home ? Peut-être trouvez-vous qu’elle vous rend de très précieux services, en vous faisant un point sur l’actualité ou en vous indiquant la météo pour la journée. Mais il s’avère qu’elle pourrait aussi vous causer du tort… en théorie, du moins. C’est ce qu’ont découvert des universitaires et des spécialistes en sécurité informatique.

Grâce à l’utilisation de lasers, pointés directement sur le microphone, il est possible de contrôler à distance les enceintes connectées et de leur passer des instructions. Il a aussi été constaté que certains smartphones sont vulnérables à cette manipulation lumineuse. C’est ce que décrit un papier de recherche, publié par quatre universitaires du Michigan et un autre de la faculté d’électro-communication, au Japon.

Une page web plus facile d’accès est aussi disponible.

Attaques par injection au laser

Les travaux des chercheurs, intitulés «Commandes lumineuses : attaques par injection audio au laser sur des systèmes à commande vocale », montrent que la lumière d’un laser sur un microphone perturbe sa membrane et que le rayon est interprété comme un signal à traiter, de la même façon que le son. En variant l’intensité lumineuse, les scientifiques ont pu ainsi envoyer des commandes à distance.

Potentiellement, l’attaque servirait à déverrouiller la porte du garage ou d’entrée, si la victime a configuré leur ouverture avec une commande vocale — ce n’est pas improbable vu qu’il est possible de faire dans une maison connectée. Les voitures pourraient être attaquées de cette façon. Des commandes sur des sites marchands pourraient être passées.

Dans leurs tests, ce sont des lasers à la lumière visible qui ont été essentiellement mis à l’épreuve. Ils ont assez peu expérimenté le cas de laser invisible à l’œil nu, c’est-à-dire en infrarouge, parce qu’ils craignaient d’aveugler ou de causer des brûlures à un tiers. Ce cas de figure n’a été mis en œuvre que sur de courtes distances, mais il est clairement utile pour une attaque encore plus discrète.

Dans le cas des enceintes connectées, sur seize modèles qui sont passés sur le banc d’essai, presque tous ont enregistré les commandes envoyées à une distance de près de 50 mètres. C’est assez loin pour atteindre un appareil qui pourrait se trouver dans une maison, si celui-ci est visible depuis l’extérieur et que les vitres ne diffractent pas trop le faisceau. Dans le cas des smartphones, les résultats sont moins spectaculaires.

Certaines attaques marchent au-delà de 100 mètres

En ce qui concerne l’iPhone, l’engin est sensible jusqu’à 10 mètres. Quant à Android, deux modèles ont réagi jusqu’à 5 mètres. Le risque est toutefois moins élevé que dans le cas d’une enceinte, car le microphone d’un smartphone est souvent hors de vue — parce qu’il est rangé dans une poche ou un sac — ou difficile à cibler. Pas sûr que la technique puisse être réaliste en pleine rue, par exemple.

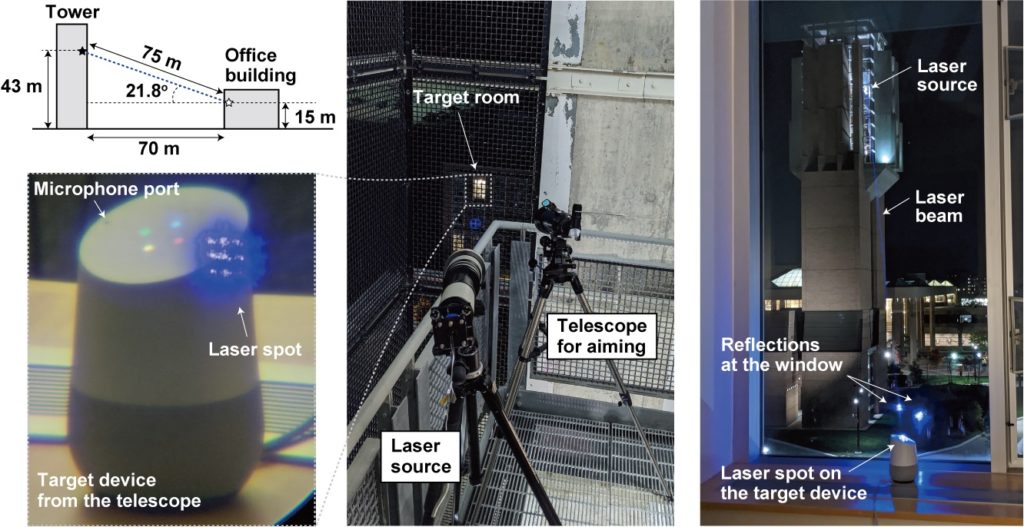

Avec un autre type de laser, des distances encore plus grandes ont pu être atteintes, mais avec un taux de réussite moindre. Un Google Home et un Echo Plus de première génération peuvent être contrôlés jusqu’à près de 110 mètres. Un Google Home situé à l’intérieur d’un bâtiment voisin a pu aussi être ciblé avec succès, alors qu’il se trouvait à environ 76 mètres et derrière une fenêtre.

Un tableau comparatif est proposé par les universitaires avec plusieurs produits testés. Il est à noter, pour les deux dernières colonnes, que les expériences ont pris place dans des couloirs longs de 50 et 110 mètres respectivement. Il est possible que les microphones des enceintes connectées puissent être déclenchés d’encore plus loin, mais les conditions de test n’ont pas permis de le vérifier.

| Appareil | Système de reconnaissance vocale |

Puissance Minimale du laser à 30 cm [mW] | Distance max à 60 mW [en mètres] | Distance max à 5 mW [en mètres] |

| Google Home | Google Assistant | 0.5 | 50+ | 110+ |

| Google Home mini | Google Assistant | 16 | 20 | – |

| Google NEST Cam IQ | Google Assistant | 9 | 50+ | – |

| Echo Plus 1st Generation | Amazon Alexa | 2.4 | 50+ | 110+ |

| Echo Plus 2nd Generation | Amazon Alexa | 2.9 | 50+ | 50 |

| Echo | Amazon Alexa | 25 | 50+ | – |

| Echo Dot 2nd Generation | Amazon Alexa | 7 | 50+ | – |

| Echo Dot 3rd Generation | Amazon Alexa | 9 | 50+ | – |

| Echo Show 5 | Amazon Alexa | 17 | 50+ | – |

| Echo Spot | Amazon Alexa | 29 | 50+ | – |

| Facebook Portal Mini | Alexa + Portal | 18 | 5 | – |

| Fire Cube TV | Amazon Alexa | 13 | 20 | – |

| EchoBee 4 | Amazon Alexa | 1.7 | 50+ | 70 |

| iPhone XR | Siri | 21 | 10 | – |

| iPad 6th Gen | Siri | 27 | 20 | – |

| Samsung Galaxy S9 | Google Assistant | 60 | 5 | – |

| Google Pixel 2 | Google Assistant | 46 | 5 | – |

Une attaque vraiment dangereuse ?

Se pose maintenant la question de savoir si la découverte des universitaires pourrait être effectivement mise en œuvre dans le cadre d’une vraie attaque. Autrement dit, au-delà des expériences en laboratoire, qui se déroulent dans des environnements qui ne reflètent pas toujours la réalité, cette méthode est-elle vraiment de nature à constituer un risque imminent et immédiat pour le tout-venant ?

On peut raisonnablement se dire que le danger est quand même minime pour la plupart des individus ayant une enceinte connectée, pour ne pas dire inexistant. D’abord, pour que l’opération puisse marcher, il faut savoir si sa cible dispose d’un tel matériel. Sinon, tout ceci ne sert à rien. Ensuite, il faut que le matériel soit directement visible par l’attaquant et il faut qu’il se trouve à portée.

Cela ressemble plus à une configuration que mettrait en place une agence de renseignement, qu'un banal hackeur.

Source : Light CommandsCe n’est pas tout : il faut de préférence que la pièce soit inoccupée pour éviter d’attirer l’attention avec le laser frappant le microphone — ce qui constitue un autre défi : arriver à viser précisément la cible à plusieurs dizaines de mètres de distance. Certes, l’assaillant peut gagner en discrétion en employant un laser infrarouge, mais l’enceinte connectée va réagir à haute voix à un moment où à un autre.

À cela s’ajoute l’équipement nécessaire pour conduire une telle opération. Il est fait mention de plusieurs composants à acquérir, que l’on trouve facilement en ligne. Si un pointeur laser ne coûte pas très cher (sur Amazon, un lot de trois est vendu moins de 20 euros), d’autres composants un peu plus onéreux sont nécessaires, ne serait-ce que pour la configuration du signal avant l’attaque.

L’ensemble du matériel nécessite quand même un investissement de plusieurs centaines d’euros, même pour une attaque à bas coût, mais aussi des compétences pour mettre au point l’installation — on ne parle pas simplement de pointer le laser sur l’objet, mais de faire transiter un signal par le laser. Bref, l’attaque n’est pas aisée : elle est quasi impossible à faire depuis la rue — sauf à risquer de se faire prendre.

Surtout, l’attaque est facilement neutralisable : il suffit de mettre l’enceinte hors de vue pour que le laser ne puisse plus rien faire. Pivoter l’enceinte peut même être suffisant, si le micro se trouve sur un plan incliné, comme le Google Home. Ou alors, en tirant les rideaux.

Qui plus est, des protections intégrées dans les smartphones et les enceintes connectées limitent également des usages inappropriés. Par exemple, les commandes à haute voix nécessitent en règle générale le déverrouillage du smartphone. D’autres systèmes requièrent aussi un code PIN. Si celui-ci peut toujours être attaqué par force brute, cela nécessitera du temps, au point peut-être de dissuader l’assaillant.

Les universitaires suggèrent quelques pistes pour contrer les commandes lumineuses : par exemple, une commande vocale passée à une enceinte connectée pourrait exiger que le signal sonore soit capté par au moins deux microphones. Le rayon laser, qui ne vise qu’un seul microphone, ne serait plus opérant. Autre possibilité : mettre une sorte de filtre devant le microphone pour bloquer la lumière.

Autre bonne nouvelle : les industriels ont eu vent de ces travaux et leur examen est en cours, notamment par Google et Amazon. En supposant sur le péril soit jugé suffisamment grave, ce que l’on peut douter au regard de tous les prérequis nécessaires, on peut sans doute s’attendre à des parades matérielles et logicielles, notamment lorsque sortiront les prochaines générations d’enceintes connectées.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !