Au commencement était IBM.

Plus de 80 % du marché de l’informatique lui revenait. L’imagination y fantasmait une intelligence artificielle ou une grande entité centralisée, tel HAL 9000 dans 2001, l’Odyssée de l’espace (1968) ou l’ordinateur chargé de déclencher des représailles nucléaires dans Docteur Folamour (1963). Et puis, à la périphérie de l’empire de Big Blue, l’idée d’un ordinateur personnel — voire d’un home computer, « ordinateur domestique » — commença à émerger.

Une des premières occurrences du terme « ordinateur personnel » se trouve dans un article du New York Times de 1962 intitulé « Les ordinateurs de poche pourraient remplacer les listes de course », où le physicien cocréateur du calculateur ENIAC, John Mauchly, affirme qu’« il n’y a pas de raison de supposer que le garçon ou la fille moyens ne pourront pas être maîtres d’un ordinateur personnel ».

Moins que la technologie, c’est son implémentation qui définit la notion de personal computer. Le Xerox Alto était trop cher pour être vendu à cause de limitations techniques, mais c’est surtout sa vision de l’interface graphique qui a résonné dans l’histoire. Voici donc ceux qui ont façonné l’ordinateur personnel et sa vision de l’informatique, des années 60 jusqu’à la conception de l’IBM PC, qui signe le début de la fin pour l’hégémonie d’IBM et l’avènement de l’industrie moderne de la tech.

1968 : HP 9100A, la calculatrice programmable

Hewlett-Packard, première entreprise de la tech née dans ce qui va s’appeler la Silicon Valley, fabrique alors depuis trente ans de l’électronique dont des calculatrices. La 9100A est la première calculatrice scientifique moderne, capable de calculer des fonctions trigonométriques et exponentielles ; elle peut également enregistrer des « programmes », c’est-à-dire des fonctions et algorithmes mathématiques. Elle est influencée par la calculatrice italienne Olivetti Programma 101, sortie en 1965 et marketée comme un desktop computer (après tout, le verbe to compute signifie juste « calculer »).

HP voulait également décrire la 9100A comme un « ordinateur de bureau » (desktop computer) ; mais comme le remarque Hewlett, « si nous l’avions appelé ordinateur, il aurait été rejeté par les gourous informatiques de nos clients, car il ne ressemble pas à un IBM. Nous avons donc décidé de l’appeler calculatrice, et toutes ces absurdités se sont envolées ». Avec un regard moderne néanmoins, les capacités de la 9100A ne dépassent guère celles d’une calculatrice Casio de lycée, et ne permettent par exemple pas d’effectuer du traitement de texte ou du tableur. Seulement des maths.

- En bref : une calculatrice scientifique niveau lycée. Après tout, un ordinateur n’est qu’une machine à calculer…

1968 : NLS, The Mother of All Demos

Resté à jamais à l’état de prototype embarqué sur des calculateurs mainframe, le oN-Line System (NLS) n’est pas un appareil, mais un système logiciel : une sorte de Google Drive, Docs et Presentation centralisés et pilotés à la souris sur une interface graphique. À une époque où Intel est à peine né, c’est tout bonnement révolutionnaire, ce qui conduit un journaliste à surnommer la démonstration du NLS en 1968 « The Mother of All Demos ». Issu de la tradition de recherche post-1945 à la IBM, le NLS est trop en avance pour son temps et s’avère difficile à utiliser ; mais il inspirera beaucoup de monde dans la Silicon Valley, dont Xerox (voir ci-dessous).

La souris informatique, schématisée dès 1965 d’après des concepts de type trackball datant de la Seconde Guerre mondiale, est pour la première fois utilisée dans la mother of all demos sous la forme d’un prototype à un bouton. Au cours des années 70, la souris « standard » se dotera très vite de trois boutons et commencera à être utilisée comme telle dans des jeux vidéo du début des années 80, puis sous une variante à un bouton dans le Macintosh de 1984.

- En bref : la première vision concrète des potentialités d’un ordinateur personnel.

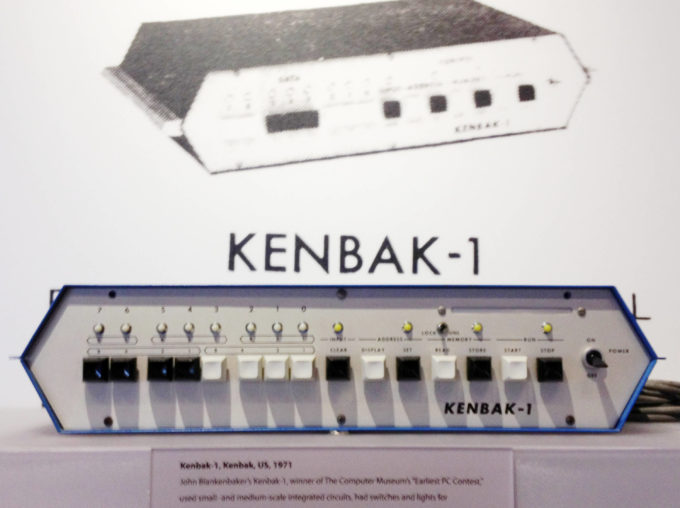

1971 : Kenbak-1, naissance en silence

Le Computer History Museum de Mountain View le considère comme le premier de tous les ordinateurs personnels ; et pourtant, il n’a fait aucune vague. Né dans une startup éphémère de la main d’un certain John Blankenbaker, le Kenbak-1 n’a même pas de microprocesseur — ceux-ci n’existent pas encore. À la place se trouve un assemblage de circuits intégrés exécutant environ 1000 instructions par seconde, soit l’équivalent d’une cadence de 1 kHz (!). Quant à la mémoire vive, elle ne dépasse pas 256 bits.

Commandé avec des interrupteurs, le Kenbak-1 ne dispose que de diodes en guise d’affichage. Le prix de lancement est de 750 dollars (3 720 euros). Seules 40 machines ont été construites, et seules 14 ont survécu jusqu’à nos jours. En 2015, une d’entre elles a été vendue aux enchères pour plus de 25 000 euros.

- En bref : le pionnier oublié qui n’a pas exercé d’influence sur l’industrie.

1973 : Xerox Alto, le bijou tech à interface graphique

« Un livre amélioré, actif (comme l’enfant) plutôt que passif […] avec le pouvoir de fascination de la télévision, mais contrôlable par l’enfant plutôt que par les chaînes ». Quand le célèbre informaticien Alan Kay publie en 1972 un article nommé « Un ordinateur personnel pour enfants de tous âges », l’appareil portatif à visée éducative qu’il imagine semble venir de trente ans dans le futur : une tablette non tactile dotée d’un clavier et connectée à Internet, tel un BlackBerry géant de la fin des années 2000.

Beaucoup trop en avance sur son temps, le DynaBook — c’est son nom — reste sans surprise à l’état de spéculation philosophique. Mais le centre de recherche où travaille Alan Kay, Xerox PARC, s’en inspire pour créer une sorte de « DynaBook intérimaire » : un mini-ordinateur à interface graphique WYSIWYG (what you see is what you get), pilotable par une souris à trois boutons et reprenant les grandes fonctionnalités du système NLS.

Avec ses caractéristiques de titan, l’Alto est trop coûteux pour être vendu

Reconnaissable à son écran vertical et ayant le gabarit d’une grosse table de chevet, Le Xerox Alto un chaînon manquant entre les ordinateurs mainframe, grosses armoires auxquelles sont reliés plusieurs terminaux individuels, et les futurs micro-ordinateurs personnels que l’on pose devant soi sur une table. Il dispose d’entre 96 et 512 ko de mémoire vive, d’une CPU cadencée à 5,8 MHz et peut accueillir une cartouche mémoire de 2,5 Mo — des caractéristiques de titan pour l’époque.

Seuls 2000 exemplaires sont « distribués » au cours de la décennie, car aucun n’est mis sur le marché. Le Computer History Museum estime que si cela avait été le cas, l’Alto aurait dû être vendu à un prix de plus de 10 000 dollars de l’époque, soit 50 000 euros d’aujourd’hui. Malgré son coût mirobolant, les innovations de l’Alto inspireront l’industrie pour toute une décennie. En 1979, des visites à Xerox seront organisées pour les ingénieurs d’Apple, qui s’inspireront de l’interface graphique de l’Alto pour les futurs Apple Lisa et Macintosh.

- En bref : le prototype user-friendly et ultra-sophistiqué porté par la vision d’Alan Kay, avec dix ans d’avance sur son temps. N’était pas commercialisable.

1973 : Micral, micro-cocorico

Le premier micro-ordinateur commercial du monde est français ! Le Micral N renferme en effet un CPU Intel 8008 cadencé à 500 kHz, le premier microprocesseur de l’histoire, et se trouve être un ordinateur entièrement monté et non en kit. Son concepteur est la firme R2E (« Réalisation d’Études Électroniques), qui voulait créer une machine pour l’INRA destinée à mesurer l’évapotranspiration des plantes cultivées.

L’appareil ne coûte que 8 500 francs (1 500 euros), ce qui en fait une bonne alternative aux mini-ordinateurs pour les contrôles de processus ou les péages routiers — dans le monde de l’entreprise et du service public, donc. Lisant originellement ses programmes sur des cartes perforées, le Micral est doté d’un lecteur de disquettes à l’occasion d’une commande du Commissariat à l’Énergie Atomique. Toutes versions confondues, 90 000 exemplaires de Micral sont écoulés jusqu’au rachat de R2E en 1981.

- En bref : le premier micro-ordinateur, utilisé dans les instituts et le service public en France.

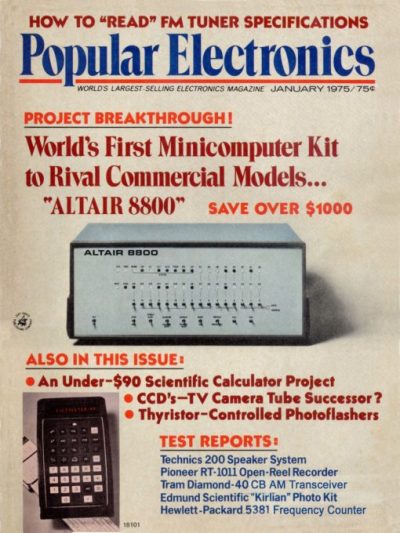

1974 : Altair 8800, le kit en une de la presse

Doit-on la révolution de l’ordinateur personnel à une rédaction de journalistes tech ? Si l’Altair 8800 vient d’un petit fabricant de radios nommée MITS, sa conception a en effet été aiguillée par une revue spécialisée, Popular Electronics, qui pour contrer un magazine concurrent voulait mettre en une de son édition de janvier 1975 un ordinateur complet à l’allure professionnelle.

Le nom « Altair » est décidé par les rédacteurs de Popular Electronics, proposé selon la légende par la fille de l’un d’entre eux qui regardait un épisode de Star Trek se déroulant autour de l’étoile Altaïr. La machine est basée sur un processeur Intel 8080 cadencé à 2 MHz et dispose de 256 octets à 64 ko de mémoire. Vendue à 439 dollars (1 700 euros) en kit ou 621 dollars (2 400 euros) assemblée pour la version de base, son succès prend MITS par surprise. Alors que la firme ne s’attendait à écouler que quelques centaines de modèles, 5000 exemplaires se vendent dans l’année.

L’Altair est à l’origine difficile à programmer et à utiliser. Début 1975, le patron de MITS reçoit une mystérieuse lettre d’une startup nommée Traf-O-Data qui lui propose de lui vendre sa version du langage de programmation BASIC (le langage dont chaque utilisateur parlait à son ordinateur à l’époque des interfaces textuelles). Mais en appelant la firme, il tombe chez un particulier qui ne connaît rien à l’informatique.

Derrière Traf-O-Data se trouvent en fait deux étudiants en informatique de Boston, Paul Allen et Bill Gates, qui n’avaient pas de BASIC dans les cartons, mais étaient simplement fascinés par l’Altair après avoir eu Popular Electronics entre les mains. Après trente jours de folie à développer leur BASIC, Allen saute dans un avion pour Albuquerque et effectue une démonstration concluante. Gates le rejoint pour former la startup « Micro-soft ». L’ordinateur en kit inspire également l’autre côté des États-Unis, parmi les premiers émois open source de la Silicon Valley.

- En bref : l’étincelle qui a allumé la mèche de l’industrie de l’informatique personnelle.

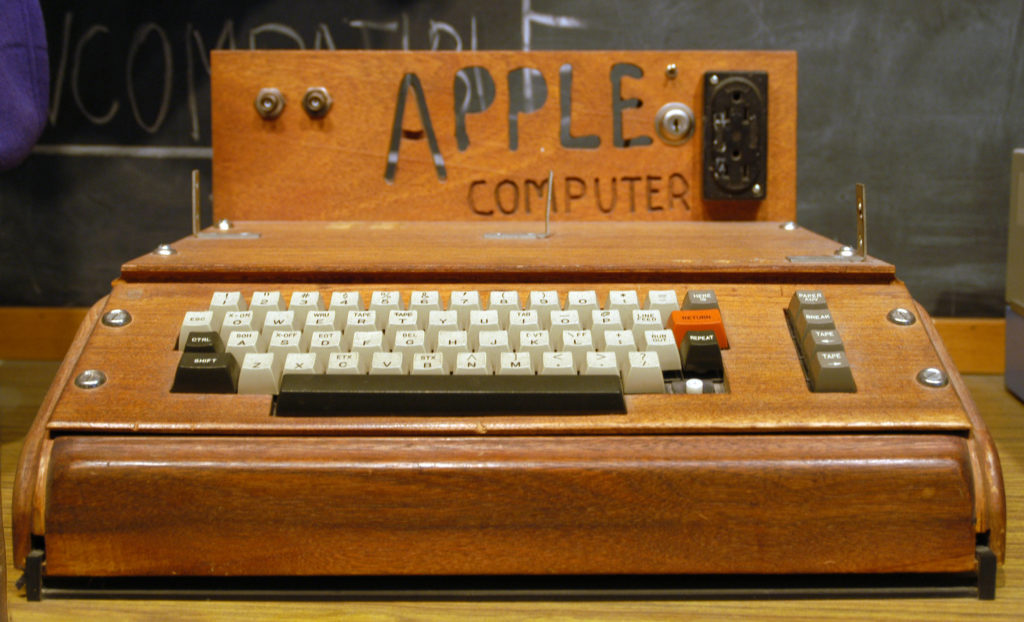

1976 : Apple I, de la sorcellerie chez les hackeurs

L’imagination populaire associe souvent les débuts de l’informatique à des hackeurs rebelles adeptes de substances illicites. Dans les années 70, la vallée abrite en vérité deux camps opposés : les grandes boîtes capitalistes aux ingénieurs diplômés, comme Intel ou HP, et la contre-culture hippie qui voit l’informatique comme un artifice oppresseur. Si dès 1971 le pionnier vidéoludique Atari se dote d’une culture assez anticonformiste, la première vraie synthèse apparaît en 1975 avec le fameux Homebrew Computer Club.

Dix ans avant que Richard Stallman ne pose les bases du mouvement du logiciel libre, la culture de cette association a déjà tout d’une forme de librisme, prônant la gratuité contre la propriété intellectuelle. Parmi eux se trouve un ingénieur d’HP nommé Steve Wozniak. Fasciné par l’Altair 8800, celui qu’on surnomme the wizard imagine un ordinateur doté d’un clavier et d’un écran, contrairement aux machines de l’époque fonctionnant avec des interrupteurs et LEDs.

Wozniak distribue en open source (comme on le dirait aujourd’hui) les plans de son invention aux membres du Homebrew, souvent très intéressés, mais qui ne trouvent pas le temps ou les moyens de construire l’ordinateur en entier. Pour leur faciliter la tâche, son meilleur ami Steve Jobs propose de fabriquer puis de leur vendre des circuits imprimés vierges. Ainsi naît une petite entreprise, nommée Apple Computer faute de meilleure idée. La machine de Wozniak attire l’attention de la boutique d’informatique Byte Shop, qui vient d’ouvrir à Mountain View et cherche des produits intéressants. Peu intéressé par des pièces détachées, le magasin de Paul Terrell exige 50 ordinateurs montés suivant les plans du wizard.

Fabriqué à la main en mobilisant famille et amis dans une maison Jobs transformée en usine, le Apple I contient un processeur MOS 6502 cadencé à 1 MHz et 4 ko de RAM extensibles à 48 ko. Son prix de 666,66 dollars (2 400 euros) force les deux Steve à s’excuser auprès de chrétiens offensés en disant qu’ils ignoraient que c’était le nombre de la Bête. Il est écoulé à 200 exemplaires, dont une soixantaine existent à ce jour ; le plus cher a été vendu aux enchères en 2017 pour 815 000 dollars. Vendu sans écran ni alimentation, le Apple I est peu attrayant pour le consommateur lambda et reste par beaucoup d’aspects un simple prototype.

- En bref : la première machine commerciale qui ressemble vaguement à un ordinateur personnel tel qu’on se l’imagine.

1977 : Commodore PET et la « Trinité », l’émergence commerciale

La commercialisation de l’informatique personnelle se met proprement en branle en l’an 1977 avec trois ordinateurs surnommés la « Trinité », quoiqu’en fait seul deux sont massivement vendus cette année-là : le Commodore PET et le TRS-80.

En septembre 1976, Jobs et Wozniak essayent (déjà !) de vendre Apple au fabricant de calculatrices Commodore, qui refuse en voyant le prix. Commodore s’attelle alors à créer son propre ordinateur personnel en interne, se donnant six mois pour pouvoir le sortir avant le CES de janvier 1977. La firme achète des licences du BASIC de Microsoft, mais décide de ne pas les payer avant la sortie des PET — qui se trouve malencontreusement retardée jusqu’en octobre. La chaloupe Microsoft manque de couler, et n’est sauvée que par un contrat que lui passe Apple.

Le Commodore PET embarque un processeur MOS 6502 cadencé à 1 MHz et 4 ko de mémoire vive extensibles à 96 ko, et est vendu à partir de 495 dollars (1 660 euros). C’est ainsi que Commodore signe son entrée dans l’informatique personnelle, domaine que la firme traverse avec brio grâce à la sortie en 1982 du Commodore 64, l’ordinateur le plus vendu de tous les temps. C’est à l’époque la marque d’ordinateur personnel la plus répandue en Europe.

De son côté, Tandy Radio Shack est une entreprise étonnante. Tandy est à la base spécialisé sur les biens en cuir, jusqu’au rachat en 1962 de Radio Shack, une vieille chaîne de magasins d’électronique en difficulté financière. Après la sortie de l’Altair 8800, Radio Shack s’intéresse à la fabrication d’un ordinateur similaire, mais entièrement monté. L’anecdote raconte qu’un prototype doté d’un programme de comptabilité avait été présenté au PDG du groupe. Monsieur Tandy y aurait rentré son salaire ; mais le chiffre s’avérant trop élevé pour être supporté, la pauvre machine aurait promptement planté.

Le TRS-80 renferme à l’origine 4 ko de RAM augmentable à 48 ko ainsi qu’un processeur Zilog Z80 cadencé à 1,774 MHz, pour un prix de lancement de 600 dollars (2 020 euros). La ligne TRS-80 dispose dès 1979 de la bibliothèque software la plus fournie du marché et reste la série d’ordinateurs la plus vendue jusqu’en 1982, engendrant un certain nombre de clones comme le fera IBM après lui.

Étonnamment, ce n’est ni Tandy ni Commodore qui attirera IBM dans le secteur et déclenchera les « guerres du PC » des années 80. Le fauteur de trouble est le troisième membre de la Trinité, beaucoup plus modeste en ventes, mais qui a précédé les deux autres dans le lancement de son produit. La raison de son succès va vous étonner.

- En bref : premiers ordinateurs personnels à structurer le marché, le PET et le TRS-80 arrivent un peu tard pour prétendre être les « premiers » tout court.

1977-1979 : Apple II, le triomphe de l’architecture ouverte

Sorti en juin 1977 et prenant ainsi de vitesse le reste de la Trinité, l’Apple II est une version améliorée de son prédécesseur. Même processeur dans le ventre (MOS 6502 cadencé à 1 MHz), même RAM aussi (4 ko extensibles à 48 ko) ; mais en plus d’être tout-en-un, l’Apple II a un écran couleur, d’où l’emblématique logo arc-en-ciel. Il comporte également un joystick primitif et Pong installé, anticipation du jeu vidéo comme vecteur d’achat dans l’informatique personnelle.

Apple était plus open que les autres, ce qui va durablement influencer le secteur

Sans la force de marketing d’un Radio Shack ou d’un Commodore, l’ordinateur fruité se distribue lentement à 1 293 dollars (4 330 euros) l’unité. Jusqu’au jour où un tiers lui développe VisiCalc, le premier logiciel de tableur en 1979, considéré comme le killer app non seulement d’Apple, mais peut-être de toute l’industrie : le programme à lui seul justifie l’achat de la machine.

La raison du succès d’Apple peut sembler difficile à croire aujourd’hui, mais elle tient en deux mots : architecture ouverte. Les grandes firmes de l’époque sortent des systèmes verrouillés contre les périphériques et logiciels tiers, par exemple en ne publiant pas les spécifications nécessaires à leur fabrication, ou alors en limitant le nombre de ports externes ou l’accessibilité aux entrailles de la machine.

![« Apple est [l'ordinateur] que vous pouvez programmer vous-même. « Apple est [l'ordinateur] que vous pouvez programmer vous-même.](https://c0.lestechnophiles.com/www.numerama.com/wp-content/uploads/2018/01/apple-ii-ad-how-to-buy-a-personal-computer-495x680.jpg?resize=495,680&key=d173136f)

« Apple est [l’ordinateur] que vous pouvez programmer vous-même. Il n’y a ainsi pas de limite à ce que vous pouvez faire. Encore plus important, Apple a la plus grande capacité d’expansion […] un ordinateur personnel qui puisse grandir avec vous. »

Au contraire, un des principaux arguments commerciaux de l’Apple II est sa capacité à être bidouillé, amélioré et reprogrammé (la publicité ci-dessus encourageant même l’échange de logiciels entre particuliers). Si cela nous paraît aller de soi au XXIe siècle, c’est en grande partie grâce à l’influence de la firme de Wozniak. Pour s’en rendre compte, il suffit de comparer la facilité d’installation d’un Linux sur PC avec la prise de tête du passage à LineageOS sur smartphone.

Malgré l’importance de l’Apple II dans le lancement de l’informatique personnelle, Apple se présente aujourd’hui comme ayant simplement « révolutionné » une industrie pré-existante avec le Macintosh de 1984, produit novateur, mais qui annonça une longue liste d’échecs commerciaux et mit, comme on le sait, Steve Jobs à la porte. Cette humilité peu typique est peut-être d’ordre politique, Jobs voulant faire oublier le librisme de Wozniak. Ou, soucieux de préserver son image de rebelle, Apple voudrait-il éviter passer pour un establishment de la tech ?

- En bref : la première machine commerciale qui ressemble vraiment à un ordinateur personnel tel qu’on se l’imagine. Retombées notables sur la direction de l’industrie.

1981 : IBM PC, l’empire contre-attaque

IBM, c’est une entreprise née de temps immémoriaux, presque déifiée, devenue une des multinationales les plus puissantes du monde. Elle a presque tout inventé en informatique, du disque dur à la RAM, et garde jalousement sa propriété intellectuelle dans des systèmes ultra-verrouillés. Son mantra est « THINK », son code vestimentaire bleu-gris est aussi strict que son culte du secret et ses employés composent des chansons à sa gloire (sic). Vous l’aurez compris : c’est tout le contraire d’Apple.

Déjà bien en retard dans la course, IBM estime que sa propre culture austère le ralentirait de plusieurs années dans la conception d’un ordinateur personnel. L’empire bleu pense d’abord racheter Atari, puis confie plutôt les préparatifs à un groupe d’ingénieurs maison, les Dirty Dozen. Un mois plus tard, ceux-ci reviennent avec un business plan marqué par l’influence open de la pomme : architecture ouverte et composants non propriétaires, réparables par n’importe quel vendeur d’électronique (quelle horreur !). Convaincus qu’il n’y a pas d’autre option, les décideurs de Big Blue donnent le feu vert au « projet Chess », qui accouche de l’IBM PC en douze mois, un record pour la firme.

Avec 16 à 256 ko de mémoire vive, un processeur Intel 8088 cadencé à 4,77 MHz et un langage BASIC acheté à Microsoft — c’est ça, être open — l’IBM PC est, en configuration de base est lancé à 1 565 dollars (3 540 euros), un prix délibérément calibré pour concurrencer Apple et les autres. 100 000 unités se vendent dans l’année suivant le lancement, et le succès du vénérable Big Blue balaye le marché. Très vite apparaissent des clones d’IBM, les « PC-compatibles » créés par ingéniérie inverse et profitant des mêmes logiciels grâce à l’ouverture du système.

Les guerres du PC sont déclarées. Commodore, Texas Instruments et Atari se lancent dans une guerre des prix partiellement responsable du crash des jeux vidéo de 1983. IBM est grignoté par les clones que son ouverture a encouragés. Apple traverse des crises politiques avec le Macintosh et se barricade en système fermé. Et Microsoft, enfin, s’érige en nouvel empire de la tech sur les ruines laissées par Big Blue. Bienvenue à bord.

- En bref : le PC originel, qui servit de base à tous les PC d’aujourd’hui.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !