C’est un passage très bref qui figure dans la dernière résolution du Parlement européen sur l’intelligence artificielle, daté du 20 janvier 2021. Au milieu des réflexions sur les lignes directrices qu’il faudrait suivre sur les usages militaires et non militaires de l’IA, les parlementaires européens ont abordé succinctement le problème des « deepfakes », ces vidéos truquées et inauthentiques.

Dans leur résolution, qui n’a certes pas de valeur juridique contraignante, mais qui acte au moins la préoccupation du Parlement européen sur un plan politique, les élus identifient bien le problème que les deepfakes pourront occasionner — et causent déjà en partie, à force d’un réalisme de plus en plus poussé induit par les progrès en matière de calcul informatique et d’algorithmes de traitement des images.

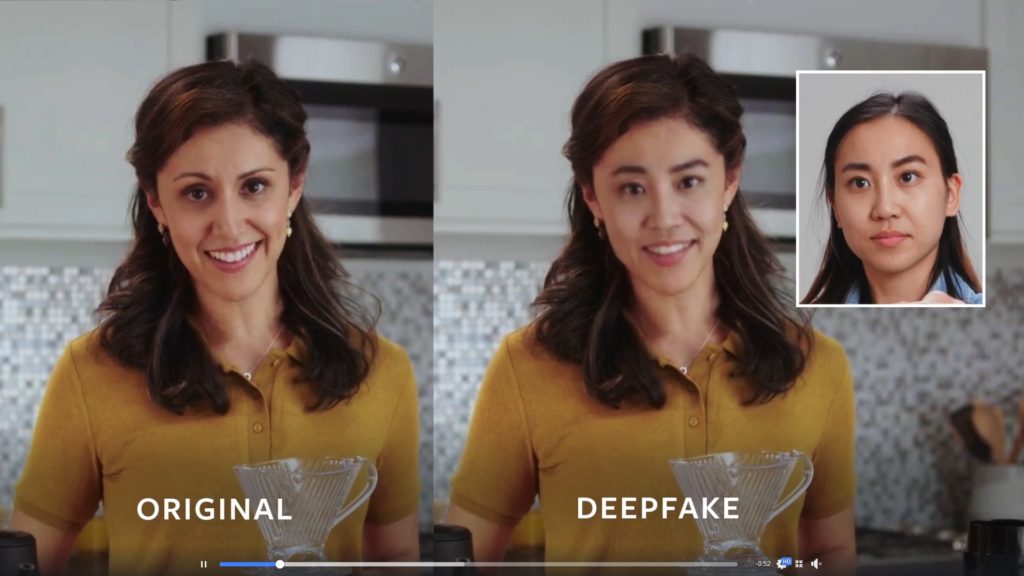

Un original et un deepfake. / Facebook

Ainsi, les eurodéputés observent que ces trucages ultra‑réalistes « peuvent être utilisés pour exercer un chantage, produire de fausses informations de presse, entamer la confiance de la population ou influencer le discours public». Ils estiment par ailleurs « que ces pratiques sont susceptibles de déstabiliser des États en diffusant de fausses informations et en influençant les élections ».

Le deepfake est un terme anglais qui a été officiellement traduit en français par « vidéotox », mot-valise entre vidéo et intox. Ce type de vidéo consiste en général à insérer un visage à la place d’un autre, pour donner l’illusion que c’est une autre personne qui est mise en scène. Aujourd’hui, le deepfake sert surtout à des fins pornographiques, où des célébrités sont malgré elles utilisées dans des vidéos X.

Vu les dérives actuelles et futures engendrées par ces contenus, les élus « se déclarent profondément préoccupés » par un manque d’encadrement. Une crainte d’autant plus audible à une époque où se côtoient la désinformation, les croyances, les faits alternatifs, l’information et les connaissances, sans qu’il soit toujours aisé de bien les distinguer et de reconnaître leur valeur les unes par rapport aux autres.

De l’autorégulation dans les deepfakes ?

Mais si les enjeux sont bien posés, et le contexte d’un monde plongé dans la post-vérité bien pris en compte, la stratégie pour y répondre, en tout cas à court terme, a de quoi laisser perplexe. En effet, le Parlement européen se contente de demander « que les créateurs [des deepfakes] soient tenus de signaler » quand ils diffusent des vidéos de ce type.

Comme les deepfakes consistent à « créer des photos et des enregistrements audio et vidéo falsifiés », qui s’avèrent « de plus en plus réalistes », et qui selon le constat des élus visent à des fins malveillantes, il parait tout à fait improbable que les créateurs étiquettent ces contenus pour prévenir le public que ce qu’il est en train de regarder est un montage extrêmement poussé.

Selon le Parlement européen, cette demande cible tout particulièrement les créateurs lorsque le deepfake « poursuit des visées électorales ». S’il n’envisage pas une interdiction de ce type de technique (serait-elle respectée, de toute façon ?), l’hémicycle souhaite que son recours « soit strictement encadré, et que cette obligation [d’étiquetage] soit rigoureusement appliquée ».

Par contre, bien plus réaliste est la demande du Parlement européen sur des travaux de recherche « s’assurer que les technologies destinées à enrayer ces phénomènes ne se laissent pas distancer par l’utilisation malveillante de l’IA ». En somme, le bouclier ne doit pas se laisser surclasser par l’épée. Or en la matière, un challenge organisé par Facebook a montré que le bouclier n’est pas encore au niveau.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !