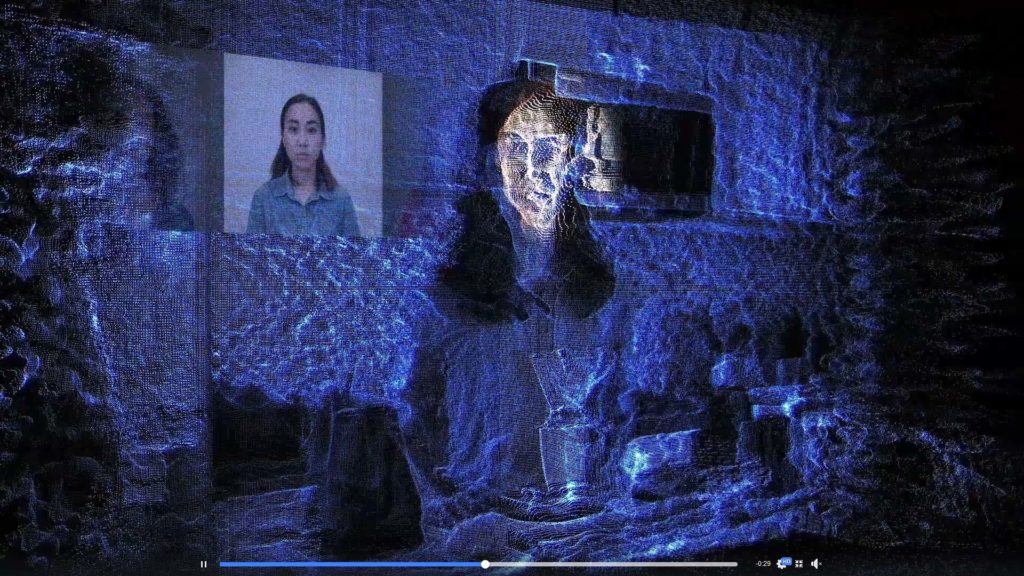

Le numérique a libéré comme jamais les capacités de manipulation et de falsification des photos et des vidéos. Le « deepfake » en est l’illustration la plus récente : ce procédé sert à remplacer un visage par un autre dans une vidéo (voire même tout un corps, y compris ses mouvements !), de façon à donner l’illusion que c’est une autre personne qui est mise en scène. Le 5 septembre 2019, Facebook a annoncé un concours pour faire avancer la recherche qui tente de modérer les mauvais usages de ces deepfakes.

Bien sûr, cette permutation des visages peut avoir des finalités divertissantes. On peut citer ce trucage de la bande-annonce de Solo : A Star Wars Story pour placer la tête de Harrison Ford (jeune) à la place de celle Alden Ehrenreich, dont la performance n’a pas fait l’unanimité. Ou bien ce deepfake de Jim Carrey sur Jack Nicholson, dans Shining. Là aussi, le rendu peut être bluffant.

Dérives du deepfake

Mais cette technique a aussi sa face sombre, soit pour faire croire qu’une personne a tenu des propos qu’elle n’a en réalité jamais prononcés (en 2018, une vidéo truquée avait fait sensation parce qu’elle faisait croire que Barack Obama était en train d’insulter Donald Trump), soit pour produire un trucage porno, visant aussi bien des célébrités féminines que des femmes ordinaires.

Aujourd’hui, il est encore relativement aisé de détecter à l’œil nu les fausses vidéos — bien que certaines créations s’avèrent d’excellente facture. Mais du fait des importants progrès en informatique (le procédé repose sur l’apprentissage profond, le deep learning en anglais, une méthode qui sert à entraîner automatiquement un système), même un œil entraîné finira par se faire avoir.

D’où la nécessité de se doter le plus vite possible d’outils efficaces pour dénicher toute supercherie, à l’image de ce qui existe déjà dans le monde de la photographie avec le logiciel Tungstène, que l’AFP utilise pour analyser la structure d’un cliché et déterminer s’il y a eu des manipulations. C’est dans cette direction que Facebook entend aller, avec son initiative intitulée Deepfake Detection Challenge.

Facebook lance le Deepfake Detection Challenge

Comme son nom l’indique, il s’agit d’un concours de détection des permutations des faces. Le projet réunit non seulement le réseau social américain, mais aussi les universités de Californie à Berkeley, du Maryland, d’Oxford, Cornell Tech, la faculté d’État de New York à Albany, mais aussi Microsoft, le MIT et le « Partnership on AI », qui rassemble plusieurs grandes entreprises technologiques.

« Le but du défi est de produire une technologie que tout le monde peut utiliser pour mieux détecter quand l’IA a été utilisée pour modifier une vidéo afin d’induire en erreur le spectateur », explique Facebook. « Il s’agit d’un problème en constante évolution », ajoute le réseau social, exactement comme le spam, mais une mobilisation générale est susceptible de contrer la menace ou, à tout le moins, de la contenir.

Facebook souhaite aboutir à un outil que chacun pourrait utiliser

Indice du degré de préoccupation de Facebook sur ce sujet, l’entreprise déclare qu’elle va financer des coopérations dans la recherche ainsi que des prix pour le concours — il y aura plus de 10 millions de dollars en jeu afin de susciter des vocations. Il est à noter que le site de Mark Zuckerberg concourra aussi, mais il est précisé qu’il refusera toute récompense si jamais sa technologie passe en tête.

Pas de données venant des membres Facebook

Dans le cadre de ce challenge, Facebook prévoit de mettre à disposition un ensemble de données et un classement général. À propos de données, justement, Facebook indique dans son communiqué « qu’il est important d’avoir des données librement disponibles pour que la communauté puisse les utiliser, avec des participants clairement consentants et peu de restrictions d’utilisation ».

Le projet est piloté par FAIR, le hub de Facebook dans la recherche en intelligence artificielle (FAIR). // Source : Facebook

C’est pour cela que le site va engager des acteurs rémunérés pour utiliser leur image en procédant au préalable au recueil de leur consentement — qui devra être éclairé afin qu’ils aient bien conscience des tenants et des aboutissants. « Aucune donnée de membre Facebook ne sera utilisée dans cet ensemble », jure le site. Trop périlleux et risqué, même si la technologie développée pourra aider in fine les utilisateurs du site web dont le visage est manipulé à des fins de canular ou d’intox.

Les données en question seront testées courant octobre puis seront mises à disposition en décembre. Un site dédié est ouvert, mais son contenu est pour l’instant assez pauvre.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !