Cet article est extrait de notre newsletter hebdomadaire Règle30. Nous publions exceptionnellement l’édition du 24 juin 2020 pour vous faire découvrir les sujets que Lucie Ronfaut aborde. Pour la recevoir tous les mercredis, abonnez-vous gratuitement sur cette page ou ci-dessous.

[mailchimp newsletter= »regle30″ titre= »#Règle30″]

Les intelligences artificielles sont vraiment très bêtes

Si vous voulez mettre l’ambiance à un dîner entre ami·es, parlez d’intelligence artificielle. Assez rapidement, deux camps devraient se former. D’un côté, celles et ceux qui vont vous prédire la fin du monde (« ah ouais, tu trouves fascinante cette vidéo de robot autonome ? Imagine-le avec une MITRAILLETTE »). De l’autre, les personnes pour qui l’intelligence artificielle est la solution à tous nos problèmes, de la traduction automatique à la lutte contre les crimes en passant par le cancer. Entre les deux, vous retrouverez sans doute un·e ou deux de vos ami·es, les seul·es à vraiment s’y connaître en informatique, qui garderont un douloureux silence en attendant que l’on passe à une autre polémique, par exemple où se situent vraiment le Nord et le Sud de la France.

L’intelligence artificielle est une discipline à la mode. On lui dédie des articles, des livres, voire des pubs pour des parfums. Cependant, les recherches en la matière ne datent pas de ces dernières années (elles remontent plutôt aux alentours de 1950). Et même si elles ont fait des bonds prodigieux, cela ne signifie pas qu’une intelligence artificielle est forcément brillante ou dangereuse. Ou en tous cas, pas de la manière dont on peut l’imaginer.

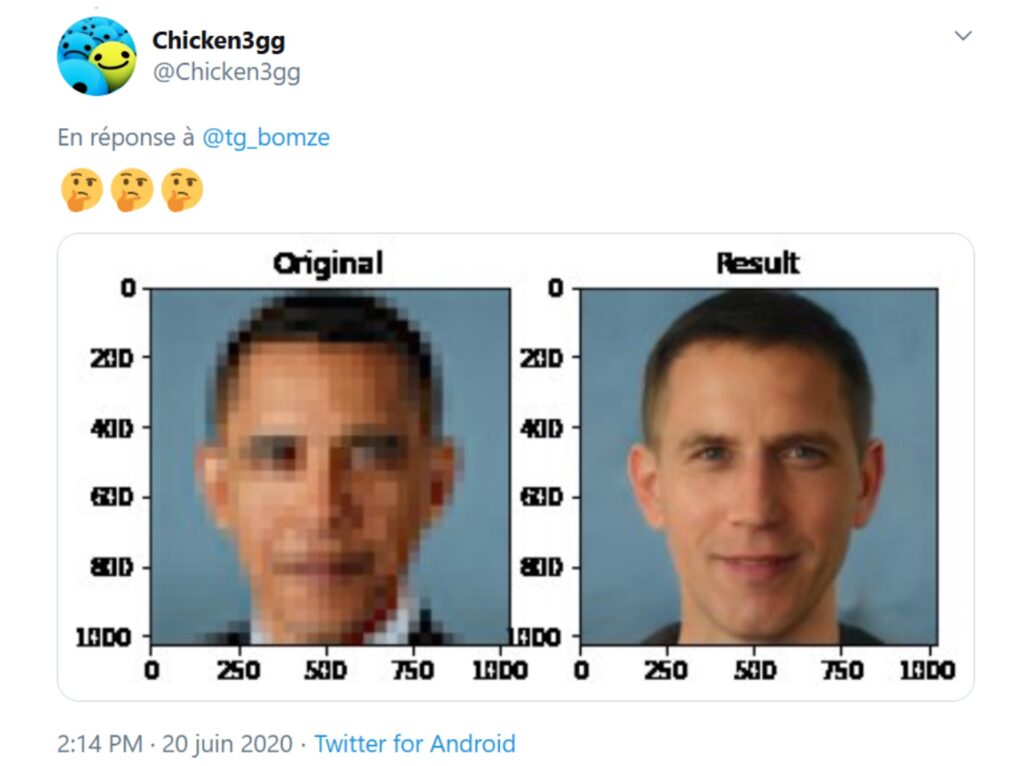

Le week-end dernier, un développeur russe, Denis Malimonov, a attiré l’attention de plusieurs chercheurs et chercheuses en intelligence artificielle avec son projet. Baptisé « Face Depixelizer », il permet en théorie de transformer une image pixelisée ou de mauvaise qualité en une photo nette d’un visage ressemblant au sujet de départ. Il repose sur un logiciel baptisé «StyleGAN » et exploite ce que l’on appelle des « réseaux antagonistes génératifs » (GAN), une classe d’algorithme d’apprentissage automatique. Problème : quand on l’essaie, le « Face Depixelizer » donne souvent des résultats absurdes. Pire encore, quand on le teste sur le visage d’une personne racisée, cette dernière devient … blanche.

On a déjà discuté ici du racisme involontaire des intelligences artificielles, celles qui se cachent derrière nos algorithmes de recommandation, de modération, ou de reconnaissance faciale. Il faut aussi insister sur leur stupidité (« elles ont moins de sens commun qu’un rat », déclarait, en 2018, Yann LeCun, qui pilote les recherches en intelligence artificielle chez Facebook). Une machine ne sait pas réfléchir seule. Elle a besoin d’êtres humains pour lui apprendre comment résoudre des problèmes très spécifiques. On ignore d’ailleurs souvent la part d’intervention humaine dans nos IA, via des travailleurs et travailleuses du clics, caché·es des yeux du grand public par les plateformes pour qui ils et elles travaillent.

Une intelligence artificielle ne connaît que ce qu’on lui montre. Si un logiciel est entraîné à reconnaître uniquement des visages de personnes blanches (parce qu’on ne lui a soumis que des images de personnes blanches), par exemple, il ne pourra pas savoir qu’il existe aussi des personnes qui ne sont pas blanches. Ou alors, il les considérera comme une donnée « anormale », c’est-à-dire pas dans la norme. Cela vaut pour toute autre notion. Par exemple, «Face Depixelizer » a aussi du mal à reconnaître les fameux sourcils en triangle de Marilyn Monroe. Cependant, il a correctement interprété sa couleur de peau, une donnée tout de même bien plus cruciale qu’une forme de sourcils.

Les travaux de Janelle Shane, justement, sont dédiés à prouver que les intelligences artificielles sont la plupart du temps très bêtes. Sur son blog, « AI Weirdness », elle demande à des programmes automatiques d’inventer des recettes de cuisine, des noms de Pokémon, des déclarations d’amour. Le résultat est généralement absurde et drôle. Le but de Janelle Shane est de faire rire, mais aussi de nous sensibiliser aux faiblesses des intelligences artificielles. «Dans mon travail, ces erreurs sont amusantes, mais elles peuvent avoir des conséquences graves dans la vraie vie, quand des algorithmes sont utilisés pour prendre des décisions médicales, obtenir un prêt ou décider si une personne peut bénéficier d’une liberté conditionnelle », m’expliquait-elle dans une interview accordée en 2018, à l’époque où je travaillais au Figaro. « Pour moi, c’est un danger bien plus terrible et immédiat qu’un scénario à la Terminator.» Plus que d’idolâtrer ou de craindre les intelligences artificielles en agitant des scénarios de science-fiction, nous avons besoin d’exemples clairs et concrets de leurs biais.

Quelques liens sur le web

YouTube au tribunal

La semaine dernière, quatre Américaines ont attaqué YouTube en justice. Le but de leur action collective est de prouver que, selon elles, les algorithmes de la plateforme pénalisent les vidéos créées par des personnes noires, par exemple en les mettant moins en avant sur la page d’accueil, ou en modérant de manière injustifiée certains de leurs contenus. Cette initiative fait suite à une autre plainte, déposée l’année dernière, par un autre groupe de créateurs et de créatrices, qui reprochent à YouTube une discrimination touchant cette fois-ci plus particulièrement les contenus LGBTQ. Le cas en question est toujours en cours. Vous pouvez en savoir plus sur ces deux affaires en lisant cet article (en anglais) d’AdWeek.

Trump vs fans de k-pop

Ce week-end, Donald Trump organisait un grand meeting politique à Tulsa, en Oklahoma, censé être un temps fort de sa campagne présidentielle pour sa réélection. La démonstration de force a cependant tourné au fiasco, le président américain ne parvenant pas à remplir la salle réservée pour l’occasion. Or, depuis plusieurs semaines, des utilisateurs et utilisatrices de TikTok, ainsi que des fans de k-pop, s’étaient organisé·es pour réserver en masse des billets à ce fameux meeting, et ainsi tromper les organisateurs sur le nombre de participant·es. Le New York Times revient (en anglais) sur cette histoire. À noter cependant que l’affaire est à prendre avec des pincettes : on ne sait pas vraiment quelle est la véritable influence de cette opération sur le déroulement du meeting. Pour le reste, vous pouvez relire l’ancien numéro de #Règle30 sur le pouvoir politique des fans de k-pop, dans ses bons et ses mauvais côtés.

Say my name, say my name

Lorsque l’on est une personne trans, changer de prénom ou du genre sur Internet n’est pas vraiment une formalité, et même plutôt un parcours semé d’embûches. Jill Royer, développeuse, a imaginé un site pour répondre à ce problème : changemy.name. Ce dernier répertorie de nombreux services en ligne, réseaux sociaux, etc, et les méthodes pour y modifier son prénom et son genre, classés par ordre de difficulté. Vous pouvez en apprendre davantage sur cette initiative (et éventuellement y participer !) du côté de Numerama.

Des jeux vidéo (vraiment) pour tout le monde

Quand on réfléchit à la diversité dans les jeux vidéo, on pense généralement à leur accessibilité pour les plus jeunes, ou aux questions de sexisme, de racisme et d’intolérance en général dans l’univers vidéoludique. Mais il y a un domaine dont on entend moins parler dans les médias : l’accessibilité pour les personnes en situation de handicap. Ce long article du Figaro revient sur les efforts récents de l’industrie du jeux vidéo pour adapter leurs œuvres, mais aussi leur matériel (manettes, etc), ainsi que le travail essentiel d’associations et de petites entreprises pour faciliter la vie aux gamers et gameuses en situation de handicap, entre lutte contre les clichés et véritables progrès. C’est à lire par ici.

Quelque chose à lire/regarder/écouter/jouer

La semaine dernière a eu lieu le Youtubeuse Day, un évènement créé par l’association Les Internettes pour célébrer les créatrices de vidéos en ligne. Pour l’occasion, je voulais vous parler d’une chaîne YouTube que j’ai découverte récemment, Demoiselles d’Horreur.

J’entretiens une relation particulière avec les films d’horreur. D’un côté, je suis une énorme flipette. Il suffit de me crier “bouh” dans le dos pour que je hurle de terreur. Pourtant, je suis aussi fascinée par l’horrifique. Mon péché mignon est d’aller sur Wikipédia lire les résumés de films que je juge trop flippants pour être regardés, mais dont j’ai envie de connaître le scénario. Demoiselles d’Horreur a résolu mes problèmes. Je peux y assouvir mon intérêt pour ce genre de films, sans avoir à affronter des jumpscares à la chaîne.

Les films d’épouvante sont des œuvres riches, qui peuvent être analysées de bien des manières. Judith, la créatrice derrière la chaîne, se consacre à un thème bien particulier : la place des femmes dans l’horreur. Chacune de ses vidéos est dédiée à un ou deux personnages féminins marquants, qu’elles soient les “méchantes” ou les “gentilles” du film, ou entre les deux. En quoi Sidney, l’héroïne du célèbre « Scream« , renverse-t-elle les attentes que l’on a d’une victime dans un film d’horreur ? Pourquoi Sadako, le monstre du film japonais « Ring« , est-elle si effrayante ? Je vous recommande d’ailleurs particulièrement l’épisode en question, qui parle en détail de notre rapport à la technologie et comment viennent s’y loger nos peurs les plus profondes. C’est précis, bien renseigné, et cela vous apprendra des choses mêmes vous n’êtes pas sensibles au plaisir de l’hémoglobine sur grand écran.

Demoiselles d’Horreur, à voir sur YouTube

[mailchimp newsletter= »regle30″ titre= »#Règle30″]

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !