Comment combattre efficacement les théories du complot qui fleurissent sur le net, sans recourir à la censure, pour éviter justement de conforter dans leurs croyances les personnes sensibles à ces récits alternatifs ? En effet, la suppression d’un contenu conspirationniste n’est-elle pas, à leurs yeux, la meilleure démonstration qu’il y a quelque chose à cacher ? Et qui doit le rester ?

Ces questions se posent notamment aux grandes plateformes du numérique, qui de par leur visibilité attirent mécaniquement des personnes qui avancent — et entendent promouvoir — une autre vision de l’histoire : nous ne sommes jamais allés sur la Lune ; la Terre est plate ; les traînées blanches laissées par les avions ne sont pas de la condensation ; on ne nous dit pas tout sur l’assassinat de JFK…

YouTube, en tant que premier site d’hébergement des vidéos sur le web, se trouve en première ligne face aux vidéos complotistes. Même un relatif fait divers comme une tuerie de masse aux États-Unis — au rythme où elles se produisent, il est difficile de les considérer aujourd’hui comme des évènements exceptionnels — peut faire l’objet de théories conspirationnistes.

Face à ce constat, YouTube peut tout d’abord répondre d’une manière technique, en modifier ses algorithmes pour éviter de favoriser des vidéos qui ne sont pas fiables. Là-dessus, la maison-mère de la plateforme vidéo, Google, a montré qu’il y avait du pain sur la planche : que ce soit sur le moteur de recherche, via Google Assistant ou YouTube, les réponses n’ont pas toujours été à la hauteur.

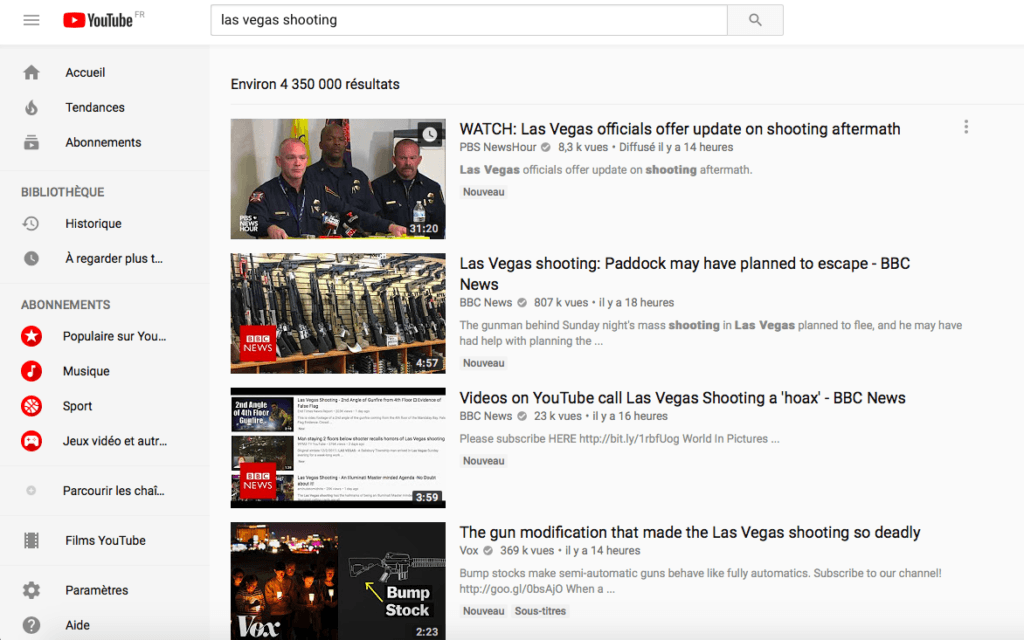

Le site, qui avait été très critiqué à l’automne 2017 pour avoir mis en avant dans ses résultats de recherche des vidéos conspirationnistes sur la tuerie de Las Vegas, a modifié ses algorithmes, de façon à faire d’abord apparaître des vidéos produites par des médias reconnus et fiables, comme la BBC, USA Today, Vox, PBS et Time, certaines dénonçant d’ailleurs les théories complotistes autour de l’évènement.

YouTube n’a toutefois procédé à la suppression des contenus complotistes, estimant qu’ils relèvent de la liberté d’expression — il faudrait pour cela qu’ils enfreignent les règles de la communauté, et celles-ci ne prévoient rien de spécial pour les vidéos conspirationnistes — et que de toute façon, le groupe est un hébergeur et non pas un éditeur. Il ne lui appartient pas de faire le tri dans les vidéos valables ou non.

Cela étant, le fait même que YouTube accepte d’ajuster ses algorithmes face aux théories du complot est le signe que la plateforme admet qu’il y a un problème. D’ailleurs, au cours du festival South by Southwest (SXSW) qui se déroule à Austin, au Texas, la patronne de la société, Susan Wojcicki, a annoncé une nouvelle mesure visant justement à contenir l’effet de ces récits alternatifs.

L’idée ? Afficher à côté des vidéos liées aux théories du complot (ce qui implique de les identifier au préalable : qui s’en chargera ? Les algorithmes du site ? Des associations ou des médias ? Des internautes via un bouton de signalement ?) des extraits de Wikipédia, l’encyclopédie collaborative que l’on ne présente plus, afin de nuancer, de contrebalancer ou en tout cas de contextualiser ce que dit la vidéo.

Naturellement, l’objection immédiate que l’on peut faire à cette idée est que Wikipédia est facilement modifiable.

Il y a un risque assez évident qu’un anonyme cherche à modifier un article utilisé par YouTube pour « compléter » le propos de la vidéo conspirationniste, afin que le texte concorde avec la théorie du complot. Cela dit, ce type de modification ne dure jamais bien longtemps : la communauté Wikipédia est assez nombreuse et alerte pour parer ce genre de vandalisme et prendre des contre-mesures.

Susan Wojcicki a donné deux cas où Wikipédia pourrait servir : l’alunissage en 1969 et les chemtrails. Elle a ajouté que le service se basera sur Wikipédia pour lister les complots les plus courants et proposer à côté des vidéos un encart intégrant des informations issues de l’encyclopédie. Cet affichage doit être déployée dans les prochaines semaines, à une date qui reste à définir.

Pas la réponse miracle

Les mesures prévues par YouTube ont le mérite de pouvoir être déployées rapidement. Reste à savoir si elles produiront un quelconque effet.

De nombreux experts, rappelle Le Monde, considèrent que le problème réside surtout dans l’algorithme de recommandation, qui suggère à l’internaute d’autres vidéos qu’il pense similaires à celle qu’il est en train de voir et qui seraient donc susceptibles de l’intéresser. Or, le système actuel fait l’objet de vives critiques, ne serait-ce parce que qu’il maintient l’internaute dans la même bulle.

Reste que la meilleure réponse au problème posé par vidéos conspirationnistes ne viendra peut-être sans doute pas de YouTube mais de l’éducation aux médias et de l’esprit critique, en développant le scepticisme scientifique, en incitant le jeune public, mais pas que, à avoir du recul sur les informations qu’il croise sur le net et à avoir le réflexe de vérifier la véracité d’une affirmation sur d’autres sites web.

Mais ça, ça ne se fait pas en un claquement de doigt.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !