Qu’est-ce qu’une base de données biaisées peut bien enseigner à un algorithme ? Rien de bon. C’est le constat que font Pinar Yanardag, Manuel Cebrian et Iyad Rahwan du MIT Media Lab avec leur intelligence artificielle, baptisée Norman en référence au personnage du tueur en série Norman Bates. Le 1er avril 2018, sans ironie aucune, ces chercheurs ont présenté les résultats de leur étude.

La faute aux bases de données, plutôt qu’aux algorithmes

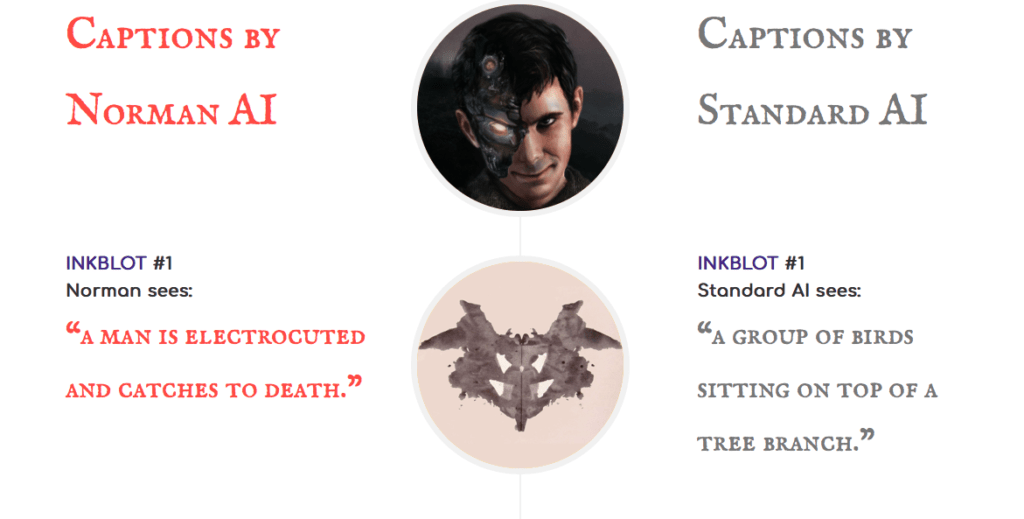

« Lorsque les gens parlent d’algorithmes d’intelligence artificielle partiaux ou injustes, bien souvent le coupable n’est pas l’algorithme en lui-même mais les données biaisées qui lui ont été données, » explique l’équipe. A priori, Norman n’a rien de plus qu’un algorithme classique, comme ceux qui n’arrivent pas à faire la différence entre un chihuahua et un muffin. Norman a simplement été entraîné avec des données un peu différentes, plutôt particulières.

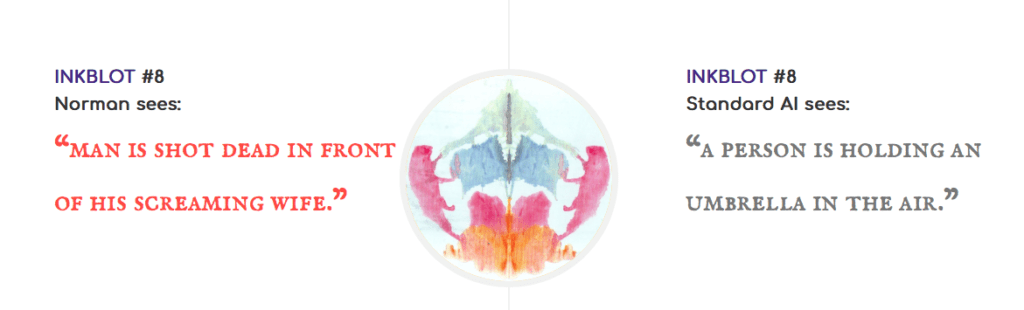

Les chercheurs ont basé l’algorithme de Norman sur les descriptions horrifiques d’un thread Reddit partageant des images gores ou, comme il est dit plus poétiquement, d’un « fil dédié à la documentation et l’observation de la dérangeante réalité de la mort. » Par la suite, ils ont confronté Norman au fameux test de Rorschach et comparé ses réponses avec celles d’un algorithme classique. Là où l’IA classique a pu voir quelqu’un tenir un parapluie, Norman voit un homme être tué par balle devant sa femme.

Les chercheurs du MIT veulent sensibiliser aux erreurs qu’un algorithme peut générer, aussi pointu soit-il. En février 2018, le MIT Lab démontrait déjà combien la qualité des informations données était importante. À l’heure où des algorithmes peuvent se montrer racistes ou sexistes parce que nous leur fournissons des données mauvaises ou trop peu variées, Norman ne fait que confirmer l’effort constant qui doit être fait dans le domaine du deep learning.

À gauche : Norman voit un homme être tué par balle devant sa femme /// À droite : l’IA standard voit quelqu’un tenir un parapluie

Pour des raisons éthiques — l’équipe insiste sur ce point –, aucune image dudit topic Reddit n’a été utilisée. Seules les descriptions textuelles, couplées aux images du test de Rorschach, sont impliquées dans le processus. Vous pouvez aider Norman à y voir plus clair en indiquant ce que vous inspirent ces taches de peinture. Notre participation pourrait permettre à Norman de se « réparer » par la diversification des réponses qu’un tel test apporte… ou bien confirmer que vous êtes aussi un psychopathe.

Pinar Yanardag, Manuel Cebrian et Iyad Rahwan sont également les auteurs d’autres projets impliquant l’intelligence artificielle, à savoir Nightmare Machine, Shelley et Deep Empathy.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !