Si Saint-Thomas vivait en 2018, il serait certainement très facile de le berner : lui qui déclarait ne croire que ce qu’il voit se ferait avoir par les effets spéciaux du cinéma et les trucages permis grâce à la puissance du traitement informatique. Le genre de trucage qui permet de faire dire n’importe quoi à n’importe qui, ou qui applique des mouvements à une personne ne les ayant jamais eus.

Et de toute évidence, cette tendance ne montre aucun signe d’essoufflement : preuve en est avec ce récent papier scientifique, publié sur arXiv par quatre membres de l’université de Californie à Berkeley, Alexei A. Efros, un professeur spécialisé dans l’intelligence artificielle et plus particulièrement dans la vision par ordinateur, et trois doctorants travaillant aussi dans ces disciplines.

Trucage des mouvements

Leur recherche porte sur le transfert de mouvement, dont la méthode est présentée comme « simple » : à partir d’une vidéo source montrant une personne sachant danser, il est possible de récupérer les gestes, pas et poses de façon à les appliquer sur quelqu’un d’autre — par exemple, un novice. Le système n’a besoin que de quelques minutes d’exécution de la danse pour procéder au transfert.

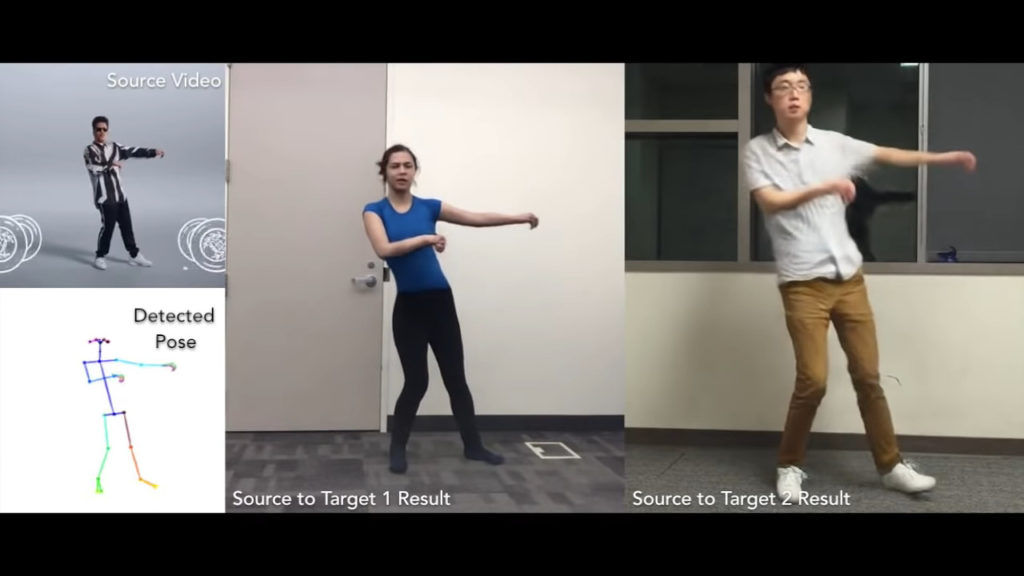

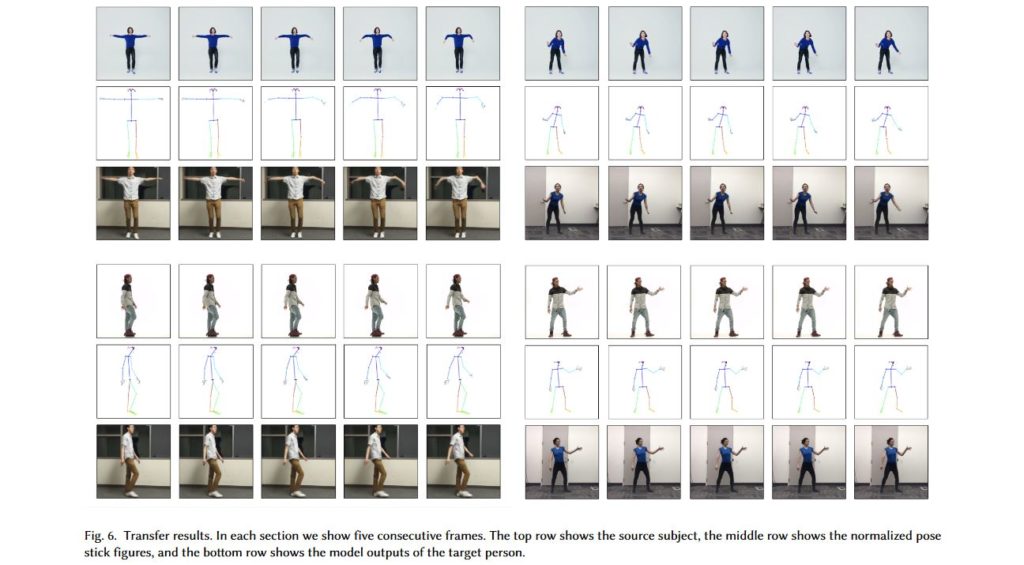

L’approche consiste à faire une translation d’image à image et image par image, avec un lissage spatio-temporel. « En utilisant les détections de pose comme représentation intermédiaire entre la source et la cible, nous apprenons un mappage entre les images de pose et l’apparence d’un sujet cible », poursuit le papier de recherche, qui est accompagné d’une vidéo permettant d’illustrer le résultat.

Le procédé de transfert avec l’analyse de la pose du sujet source et son application sur le sujet cible.

Ce procédé permet donc, estiment les universitaires, de générer une vidéo cohérente dans le temps incluant une synthèse réaliste des visages. Le résultat est remarquable, malgré la présence de quelques artefacts visuels à certains endroits difficiles à générer, par exemple au niveau des doigts et des poignets : ces parties du corps sont fines et rendent leur bonne détection difficile avec l’arrière-plan.

Notez au passage, dans la dernière partie de la vidéo, que ce trucage du mouvement ne se limite pas au corps de la cible : dans le cas du jeune homme, son ombre projetée et son reflet dans la vitre derrière lui évoluent en tenant compte de ses gestes, alors même qu’ils sont générés informatiquement (cette particularité ne se remarque pas dans le cas de la jeune femme montrée au début).

La méthode développée par l’équipe de Berkeley est d’ores et déjà très convaincante et les imperfections décelées au fil de la démonstration seront assurément corrigées en affinant les algorithmes, en augmentant la capacité du traitement de vidéo et en développant une vision par ordinateur plus performante. Jusqu’à ce que le transfert devienne imperceptible pour un œil humain, même éduqué ?

Détournements néfastes

Ce n’est peut-être pas trop grave si la vidéo truquée ne montre que quelques pas de danse. Mais qui peut croire qu’une telle technique sera cantonnée à usage bon enfant, où l’on voudra simplement mimer pour de faux les pas de Fred Astaire ? Ou faire une farce lors d’une audition pour un ballet ? On peut raisonnablement en douter : l’actualité récente a montré au contraire la tendance au détournement de ces outils

Avec des algorithmes spécifiques, il est possible de calquer le visage d’une célébrité sur une scène précise. Dans le cas de l’ancien président des États-Unis, le procédé a mobilisé le logiciel de montage vidéo Adobe After Effects et l’application FakeApp, mais aussi un « modèle » sur lequel travailler, en l’occurrence une personne récitant un texte face à la caméra.

Cette démonstration mettant en scène Barack Obama est un cas d’école :

La démarche visait à montrer au public avec quelle facilité il est possible de produire de la désinformation grâce aux outils modernes (parfois, le seul talent du monteur suffit : en prenant des bouts de phrase vraiment prononcées, on peut leur donner un tout autre sens : en la matière, VinZa est une référence avec ses détournements de Nicolas Sarkozy et François Hollande).

Et si le trucage des vidéos devient relativement accessible (ce qui a donné lieu à des dérives significatives cette année, avec le boom des trucages pornographiques où des visages de comédiennes ou de chanteuses ont été apposés sur des actrices du X leur ressemblant), celui du son se démocratise aussi : à titre d’exemple, une startup a créé un algorithme pour reproduire une voix depuis un enregistrement.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !