Si nous n’en sommes pas encore au stade où l’informatique quantique peut avoir un débouché commercial, les progrès accomplis ces dernières années par les industriels nous rapprochent chaque jour un peu plus de l’instant où de telles machines pourront être acquises par le grand public. Cet horizon est toutefois encore très incertain mais aussi très lointain, de l’ordre de quelques dizaines d’années.

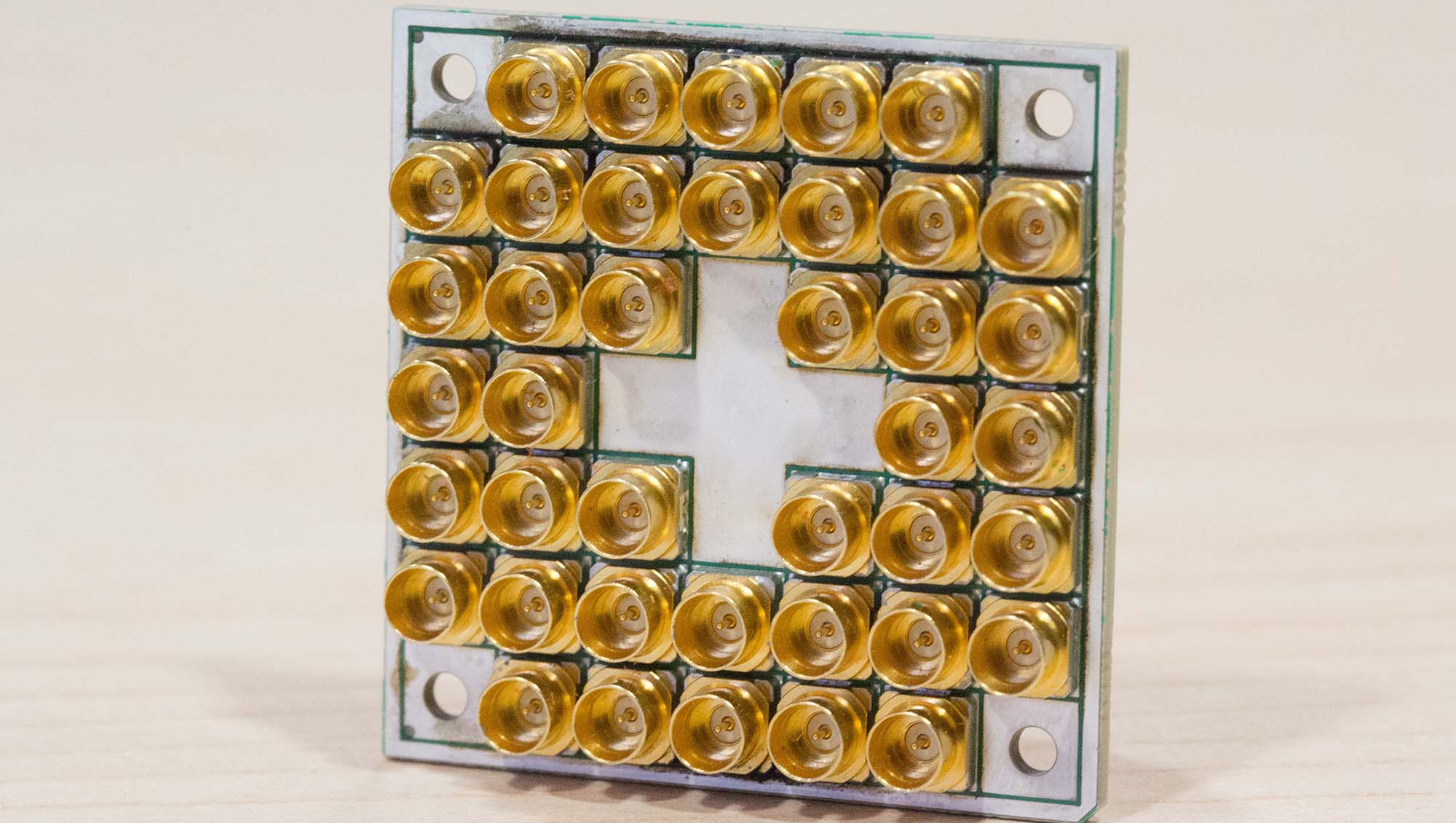

Néanmoins, le défi technologique que représente l’informatique quantique n’effraie pas les sociétés, qui investissent des millions dans la recherche et le développement. Avec parfois, des avancées notables. C’est le cas par exemple du fondeur américain Intel, qui a présenté au mois d’octobre une puce expérimentale et supraconductrice de 17 qubits, en s’inspirant des vidéos de déballage qu’on trouve sur le net.

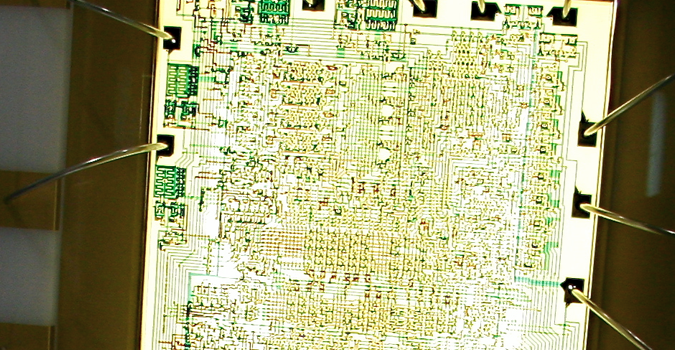

La fabrication de la puce elle-même a été réalisée par Intel. Celle-ci dispose, d’après le géant américain de l’électronique, « d’un design unique pour obtenir un rendement et des performances améliorés ». En revanche, il revient à QuTech d’expérimenter les performances de la puce en la faisant travailler sur différents algorithmes et dans différentes situations. C’est ce que le communiqué explique :

« Notre recherche quantique a progressé suffisamment pour que notre partenaire QuTech simule les charges de travail avec des algorithmes quantiques », explique Michael Mayberry, vice-président et directeur d’Intel Labs, ajoutant que son entreprise est pour sa part en mesure de « fabriquer régulièrement de nouvelles puces d’essai à qubits ».

Il apparait donc que le partenariat entre Intel et QuTech est fructueux. Rappelons que c’est en 2015 que le fondeur américain s’est rapproché de l’institut de recherche quantique de l’université technologique de Delft, aux Pays-Bas, et de l’organisation néerlandaise de recherche appliquée, avec un partenariat sur dix ans et 50 millions de dollars d’investissement.

Selon Intel, la principale avancée avec cette puce est la façon de les « emballer ». Le groupe explique en effet que « les qubits sont extrêmement fragiles : tout bruit ou toute observation involontaire peut provoquer une perte de données. Cette fragilité les oblige à opérer à environ 20 millikelvins. Cet environnement d’exploitation extrême fait de l’emballage des qubits la clé de leur performance et de leur fonction ».

Une température 250 fois plus froide que l’espace profond

Mais qu’est-ce que c’est au juste, un qubit ? Il s’agit d’un bit quantique. Contrairement à un PC classique, un ordinateur quantique ne se sert pas de bits, dont la valeur ne peut être que 0 ou 1, mais de qubits. Leur particularité est qu’ils peuvent connaître de multiples états simultanés, ce qui permet d’accroître considérablement les capacités informatiques, grâce à la mise en parallèle des calculs.

Cette promesse d’une puissance de calcul gigantesque est bien sûr regardée avec envie par tous les domaines qui nécessitent des énormes performances, qu’il s’agisse de simulation, d’intelligence artificielle, de traitement dans le Big Data, dans la modélisation ou la recherche scientifique. Mais pour cela, il faut pouvoir stabiliser l’utilisation des qubits, afin qu’ils ne défaillent pas.

D’après Intel, sa puce est dotée d’une architecture permettant d’améliorer la fiabilité, les performances thermiques et de réduire les interférences radioélectriques entre les qubits. Par ailleurs, elle est capable d’envoyer et de recevoir entre dix et cent fois plus de signaux par rapport aux puces équivalentes câblées par fil (« wire bonding »).

Mais si le géant américain se félicite des percées dans la recherche du PC quantique, il fait toutefois preuve de réalisme : ce Graal informatique ne sera intéressant que pour certains types de problème. « Il ne remplacera pas le besoin de l’informatique conventionnelle ou d’autres technologies émergentes comme l’informatique neuromorphique », prévient-il.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !