Si Facebook est un royaume, il est délimité par une frontière juridique, qui ne se fond ni dans la common law, ni dans nos système judiciaires. Loin de tous tribunaux, dominant la planète en y étendant son espace sans loi aux quatre coins du monde, Facebook représente un système juridique à lui-même.

Les sanctions comme les gratifications qui existent dans ce pays des likes n’ont rien de comparables à celles pratiquées dans nos tribunaux, et les individus ne sont pas tout à fait soumis aux mêmes règles, qu’ils viennent d’un pays à un autre. Dans cet espace juridique parallèle, le géant du réseau social a érigé ses propres tables des lois sans jamais les dévoiler.

Les décisions prises par les modérateurs et administrateurs du réseau sont évidemment régis sous la contrainte de la logique et de la règle, mais dans le système Facebook, seul le juge connaît la loi. Cette asymétrie permet au géant de se justifier de tout et de de botter en touche dès que sa responsabilité est mise en avant. Toutefois, cette somme de règles ne constitue pas en soit une réglementation qui viendrait se substituer à loi nationale, elle s’ajoute au contraire à celle-ci, comme un socle commun international des bons comportements exclusif au réseau.

Dans le système Facebook, seul le juge connaît la loi

Il y a donc deux milliards de personnes qui vivent dans cet espace juridique flou, tributaire des aléas d’une charte inconnue des utilisateurs, pour laquelle ils auraient légitimement un droit de regard.

C’est l’idée défendue par le Guardian, qui ce dimanche a dévoilé grâce à Facebook certaines lignes de conduite au cœur du système de modération du réseau qui a bien voulu éclaircir certaines de ses règles.

Des règles souvent tues pour leur caractère parfois dérangeant, parfois cynique et rarement justes. La première appréciation que nous pouvons avoir de ce corpus de règles laisse indubitablement penser que Facebook a créé une réglementation dont l’objectif premier est de se dégager de toute responsabilité dans le vrai monde.

Sous le feu des critiques européennes comme américaines, ces guidelines, ou cette charte secrète, dévoile un système surmené, croulant sous les plaintes et qui arbitre autant le revenge porn que le cannibalisme en dix secondes chrono.

Facebook a souhaité précisé à Numerama la réaction suivante, rédigée par Monika Bickert, à la tête des politiques de règlements internationaux de l’entreprise : « Notre priorité est de garantir la sécurité des personnes sur Facebook. Cela requiert beaucoup de réflexion autour de questions pointues et difficiles, et nous prenons très au sérieux le fait de le faire correctement. Mark Zuckerberg a récemment annoncé que nous allons ajouter 3 000 personnes à nos équipes de modération – qui s’ajoutent aux 4 500 personnes qui composent cette équipe aujourd’hui – pour examiner les millions de signalements que nous recevons chaque semaine, et pour améliorer le mode opératoire pour agir le plus rapidement possible. »

L’entreprise considère par ailleurs que contrairement à ce qu’elle a pu laisser penser en gardant secrètes sa charte, elle n’a rien à cacher concernant sa politique de modération. Toutefois, la considérant propre à évoluer au fil des cas, le réseau préfère garder de la souplesse en taisant ses règles. Enfin, le groupe américain précise que cet ensemble de standards est soumis aux lois nationales du régulateur qui prévalent sur les règles communautaires.

Appels aux meurtres, suicides et violences…

Parmi les centaines de documents édités par le réseau social qu’a pu consulter le quotidien anglais, on trouve de nombreuses références aux menaces de mort et aux menaces en général. L’un de cas les plus ambigus à modérer pour le réseau qui demande à ses modérateurs de distinguer la crédibilité d’une menace en fonction de son ton.

Ainsi, on apprend que menacer de mort Donald Trump est tout à fait censuré puisqu’il représente un État ; toutefois, expliquer comment tuer une femme ou insulter quelqu’un — aussi longtemps qu’il n’est pas d’intérêt public — et lui souhaiter de mourir est accepté. Facebook considère que ces dernières menaces ne poursuivent pas une intention franche de tuer. Dans les exemples de Facebook, on peut lire que « frapper un roux » et « allons tabasser les gros » est aussi toléré, toutefois « Poignardons et devenons la cauchemar des sionistes » ne l’est pas.

« frapper un roux » et « allons tabasser les gros » sont acceptables

La crédibilité d’une menace se joue souvent sur le choix de la victime : Facebook aura tendance à prendre au sérieux les appels au meurtre concernant des minorités ethniques ou des personnalités publiques. Un utilisateur lambda n’aura, lui, pas le même égard.

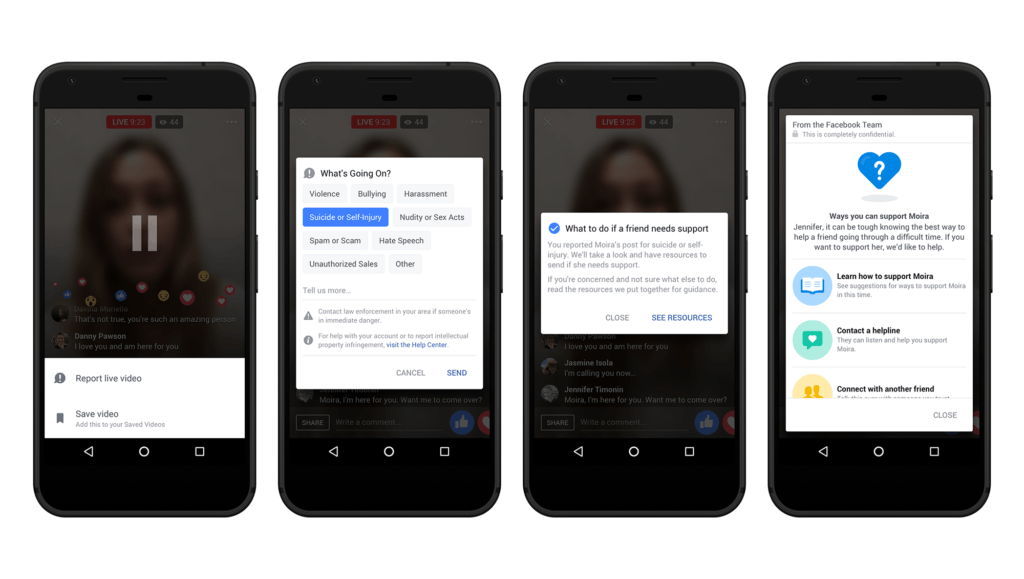

Plus délicate encore, la question des vidéos de morts violentes partagées sur le réseau social est réglée avec pragmatisme par Facebook. En effet les modérateurs vont rendre sensible le contenu sans toutefois le supprimer, considérant qu’il sensibilise l’entourage de la personne à un malaise psychologique. Nous avions déjà pu découvrir cette règle qui a sauvé une jeune fille qui tentait de se suicider en direct sur Facebook.

Le réseau social compte par ailleurs aller plus loin sur cette question en laissant les publications, de manière officielle, de toute personne souhaitant se blesser en direct sur Facebook Live. L’entreprise explique « ne pas vouloir censurer ou punir des personnes en détresse. » Sans toutefois assurer que le réseau prendra ses dispositions pour aider, voire sauver la personne. En France, des interventions d’urgence sont assurées par SOS Amitié, partenaire de l’entreprise.

Sadique ou dénonciateur ?

Certains actes de violence sont également acceptés : les photos d’agression physiques, de harcèlement, notamment des enfants, n’ont pas à être supprimées pour le réseau social… à moins qu’elles ne révèlent un comportement sadique. Une nuance que les modérateurs doivent trancher en quelques secondes, au risque de censurer un programme de sensibilisation aux violences ou de laisser passer du cyber-bullying.

Notons que les animaux peuvent être battus, attaqués et tués en direct. Facebook a décidé de n’avoir aucun regard sur les violences faites aux animaux, les modérateurs sont seulement appelés à assigner le drapeau contenu sensible lorsque les images sont extrêmement dérangeantes.

Pour l’entreprise, son laxisme est à même de créer, comme pour les suicides, une sensibilisation. Le réseau note aussi qu’il doit souvent juger ce qui est de l’ordre du message politique de sensibilisation et ce qui est un abus. Par exemple, certaines organisations de défense des animaux étant passées expertes dans la production et la diffusion d’images des horreurs vécues par les animaux dans les abattoirs, toute censure serait vue comme politique.

Sexualité, revenge-porn et cannibalisme

La pudibonderie de Facebook est souvent dénoncée. Le réseau étant coutumier d’une censure systématique de la nudité, sous toutes ses formes, les lignes dédiées aux nudités méritent notre attention. On apprend par exemple que les « œuvres d’art » réalisées à la main — ou au pinceau on imagine — montrant la nudité et/ou une activité sexuelle sont acceptées.

Le même motif, représenté grâce aux arts numériques, serait immédiatement censuré. Pour le réseau social, la technique de représentation permet de déminer l’intention présumée d’une œuvre : une peinture érotique aura tendance à être plus acceptable et attendue sur le réseau qu’un montage.

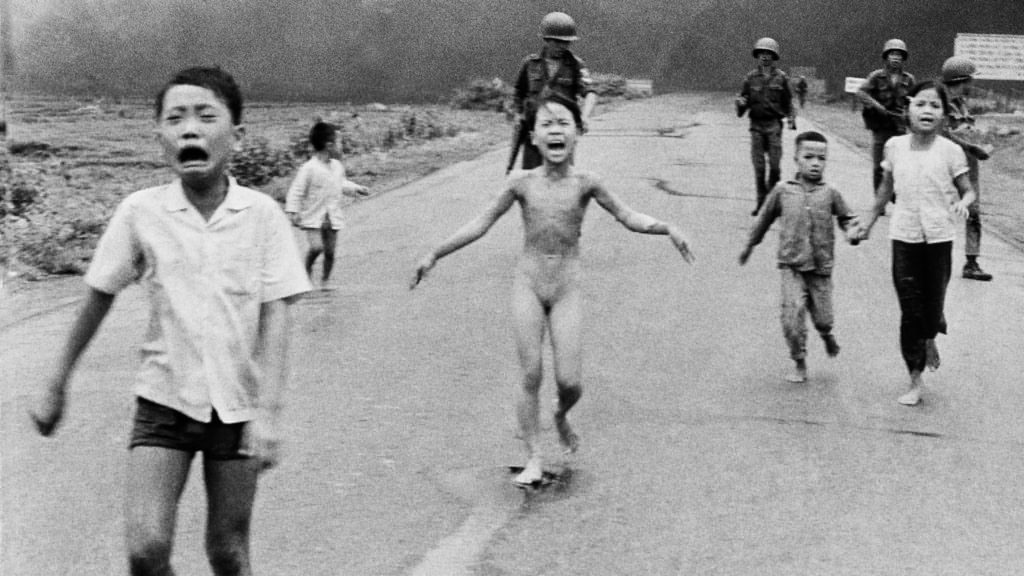

L’épisode de censure de la célèbre photo vietnamienne a également poussé l’entreprise à nuancer son approche de la nudité qui est désormais acceptée dans le cadre de la dénonciation de la guerre et de l’Holocauste.

Pour la nudité, il faut donc que soit associé des éléments de contextes déterminants précisés par l’entreprise : une extrême maigreur, des soldats de la seconde guerre, des uniformes de camps de la mort, ou des images prises dans les camps.

Pour juger le revenge porn, l’entreprise a établi une liste des éléments qui aideront le modérateur à comprendre la nature du contenu et du consentement de l’éventuelle victime. Premièrement, il faut que l’image soit produite dans l’intimité, qu’une personne soit nue, presque nue ou sexuellement active et enfin que son consentement puisse être mis en doute grâce à un commentaire revanchard ou cruel sur les contenus — ou qu’un média ait couvert l’affaire.

L’intérêt de Facebook pour le revenge porn souligne l’incroyable diversité des cas à juger par les modérateurs du réseau. Ces derniers, surmenés par des milliers de cas quotidiens, doivent arbitrer l’inhumain et l’ignoble toutes les heures, à un rythme effréné. Lorsqu’il va du cannibalisme, plus difficile à juger que vous ne le croyez, dix secondes ne suffisent rarement pas à définir le contenu vu.

Mais dans ce cas de figure, la censure est-elle plus facile que le laisser-faire ? Les rapports de force qui s’établissent alors appartiennent aux quelques minutes que passera le modérateur sur un signalement.

Intentions, frustrations et psychologie de l’emmerdeur

On apprend enfin, en parlant de rapport de force, que chaque utilisateur disposant de plus de 100 000 followers va disposer d’un statut étrange de personne publique qui peut tout à fait jouer en sa défaveur puisque Facebook se montera plus tendre avec leurs agresseurs. Leur figure publique est considérée comme plus naturellement attaquable par des individus sans intention.

« Les personnes utilisent un langage plus violent en ligne pour exprimer une frustration»

Le réseau, dans les documents révélés, ne cache pas ses analyses psychologiques qui fondent une partie des décisions prises. Un document explique ainsi que Facebook reconnait que « les personnes utilisent un langage plus violent en ligne pour exprimer une frustration, et qu’ils se sentent en sécurité sur le site pour s’exprimer de cette manière. Les utilisateurs pensent qu’ils peuvent menacer quelqu’un sans conséquence, ils sont indifférents envers les personnes qu’ils menacent à cause du manque d’empathie créé par une communication entre écrans interposés. »

L’air de rien, les modérateurs du réseau social admettent arbitrer l’un des pires endroits sur Terre où les plus pitoyables vicissitudes deviennent des publications, des menaces, des photos scandaleuses à gérer chaque minute… dans une urgence délétère.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !