Microsoft a développé un outil capable d’analyser les émotions d’une personne à partir d’une photo. Nommée Project Oxford, cette API « permet de construire des applications plus personnalisées », si l’on en croit le descriptif de la version bêta. Pour faire simple, l’algorithme repère les visages de face, puis mesure leurs émotions : le bonheur, la tristesse, la surprise, la colère, la peur, le mépris, le dégoût ou la neutralité.

Curieux, nous avons donc voulu voir si ce nouveau service faisait mieux que How Old, la précédente tentative de Microsoft qui n’avait pas été couronnée d’un franc succès. Par chance, Project Oxford est enfantin à utiliser et la démo est accessible à tous : il suffit d’y télécharger une image depuis son ordinateur, ou de charger son URL pour une image que vous trouverez sur un site web pour que le logiciel en ligne identifie le visage et attribue un score à chaque émotion. Efficace en théorie, que vaut la pratique ?

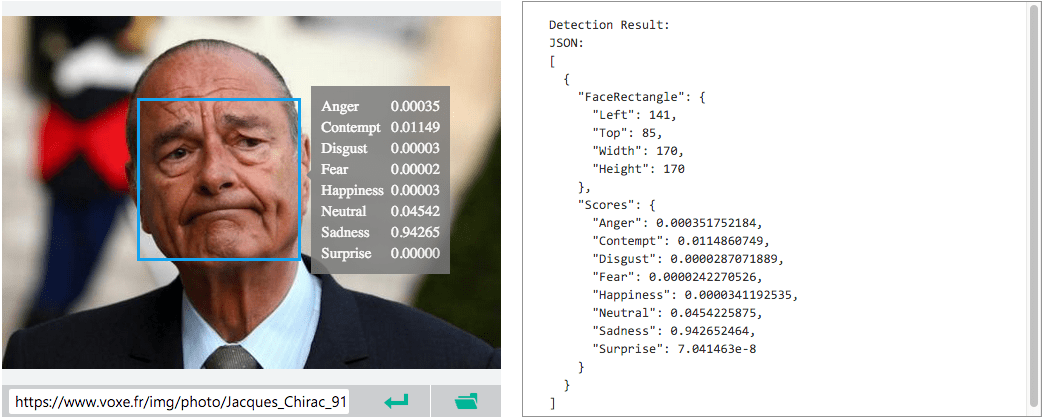

Testons d’abord avec notre bon vieux Jacques Chirac qui, s’il n’était pas toujours à l’aise avec tout ce qui touchait à l’informatique lors de sa présidence, a eu le bon ton de nous laisser avec plein de clichés aux émotions variées. Et l’algorithme de Microsoft semble être plutôt bon de ce côté-là : oui, Chirac n’avait pas l’air super content sur la photo et c’est la tristesse qui ressort gagnante, suivie par la neutralité.

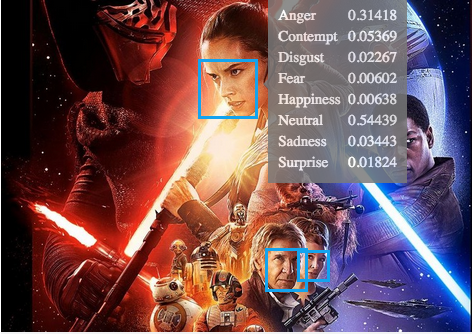

Neutre, Rey ? Pas vraiment, on la sent plutôt agacée sur cette affiche de Star Wars: The Force Awakens. Cela dit, ce n’est pas totalement un raté pour Microsoft puisque la colère est en deuxième position et que le visage n’était pas vraiment de face. Pas mal, on accepte.

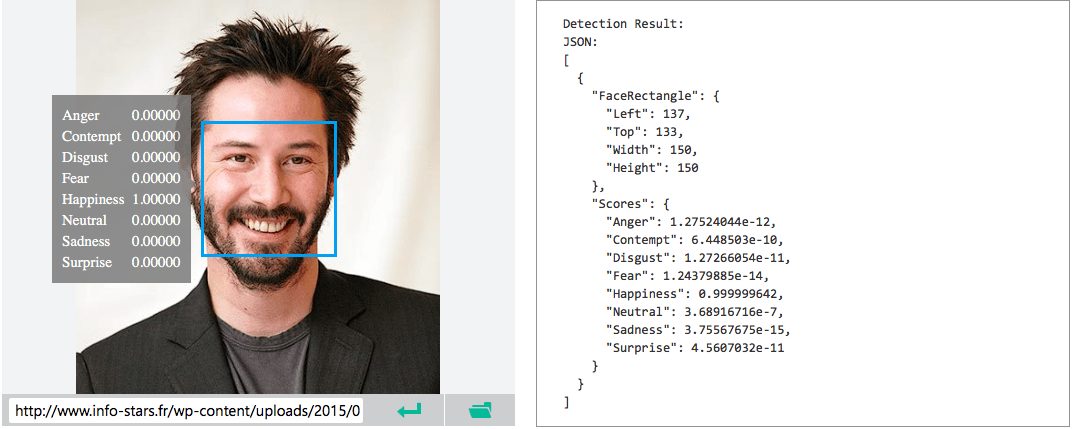

Mais montons un peu le niveau. Est-ce que Microsoft saura redonner des émotions à Keanu Reeves ?

Gagné ! Le brave Keanu peut en effet être content quand il n’est pas sad. Et encore une fois, le programme de Microsoft voit juste, avec un score parfait et sans ambiguïté. Reste à savoir s’il s’agit d’un vrai sourire ou d’un sourire forcé pour la caméra.

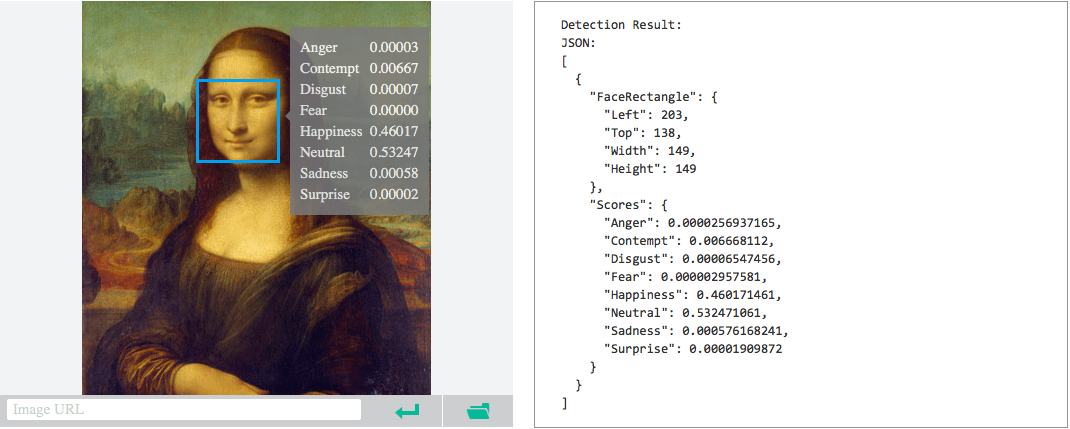

La Joconde ? Neutre, avec un petit côté heureux. On aurait pas dit mieux. Encore un bon point pour la reconnaissance automatique.

Bref, notre verdict est donc plutôt positif : la nouvelle API de Microsoft est capable, sans trop de souci, de détecter des émotions basiques. Bien entendu, elle ne pénètrera pas dans le fond de votre âme pour distinguer les sincères émotions des sentiments joués, mais c’est un bon début. Pour peu qu’on trouve à quoi cela pourrait bien servir.

reconnaître les émotions : Quelle utilité ?

Vous rêvez d’un logiciel capable de noter un jeu d’acteur ? D’évaluer l’impatience d’un usager lors d’une panne de métro ? De Google Glass qui génèrent automatiquement des phrases-types en entretien, selon les expressions du jury ? La reconnaissance faciale des émotions laisse tout imaginer. Quoique la technologie soit encore peu performante sur les nuances, elle se trompe rarement sur l’émotion dominante et pourrait donc servir à toutes ces applications.

[floating-quote float= »right »]Maintenant que l’API est disponible, c’est aux entreprises et startups d’en faire bon usage.[/quote]

Elle est d’ailleurs un enjeu de plus en plus important dans le développement d’applications car elle peut permettre de quantifier la satisfaction des utilisateurs sans avoir besoin de passer par des likes ou des notes. La start-up Crowdemotion, qui développe un logiciel similaire, promet par exemple de « rendre les émotions pertinentes », en misant surtout sur l’avenir de la réalité augmentée. Comme Microsoft, l’entreprise souligne le caractère « trans-culturel et universel des expressions faciales basiques », c’est-à-dire la possibilité de les traduire par une intelligence artificielle en données facilement interprétables.

Le jeu vidéo est aussi un secteur où la vérification des émotions pourrait devenir un facteur clé dans le développement du scénario à l’écran. Sony y travaille depuis des années. Et outre le visage, la voix est aussi un indicateur qui permet de trahir une émotion et donc d’adapter la réponse, par exemple dans un assistant vocal comme Siri ou Cortana.

De son côté, Microsoft propose déjà aux développeurs des algorithmes de contrôle parental, de contrôle orthographique, de reconnaissance faciale et d’identification vocale. Project Oxford vient compléter ces services, qui, au-delà du gadget et de l’usage marketing, pourrait permettre par exemple d’aider les personnes aveugles en leur rapportant les émotions de leurs interlocuteurs (plus possible de mentir ?). Maintenant que l’API est disponible, c’est aux entreprises et startups d’en faire bon usage.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !