Comment détecter si un mème est inoffensif ou raciste ? Un être humain sait faire la différence quasi-immédiatement. Mais jusqu’ici, l’algorithme de modération de Facebook ne parvenait pas à faire le tri dans ces contenus bien spécifiques.

Dans un billet posté sur un de ses blogs, le réseau social a annoncé le 11 septembre qu’il disposait d’une IA appelée Rosetta, capable de faire cette différence, et censurer des mèmes lorsqu’ils sont contraires à ses règles. Elle serait désormais utilisée sur Facebook et Instagram.

Discerner le texte de l’image

De nombreux mèmes qui sont partagés sur internet ont une forme similaire : il s’agit d’une même image reprise, parfois un peu modifiée, par des internautes qui y apposent un texte différent à chaque fois. Or si l’algorithme de modération de Facebook parvient à détecter une image, et sait aussi détecter du texte brut, il est beaucoup plus compliqué de comprendre du texte qui a été incrusté sur une image. C’est pourtant ce que Rosetta saurait faire.

« Comprendre le texte dans les images ainsi que le contexte dans lequel il apparaît nous aide nos systèmes de manière proactive à identifier les contenus inappropriés ou malfaisant pour que notre communauté soit en sécurité », écrivent ainsi Viswanath Sivakumar, Albert Gordo et Manohar Paluri, trois ingénieurs de Facebook qui ont développé le fameux nouvel algorithme.

L’algorithme détecte des régions rectangulaires

Rosetta repose sur le principe du machine-learning : cela signifie que l’algorithme a été nourri de millions d’images et de textes pour qu’elle en tire des modèles et qu’elle puisse aussi se faire une idée du contexte d’une image, au-delà des simples mots.

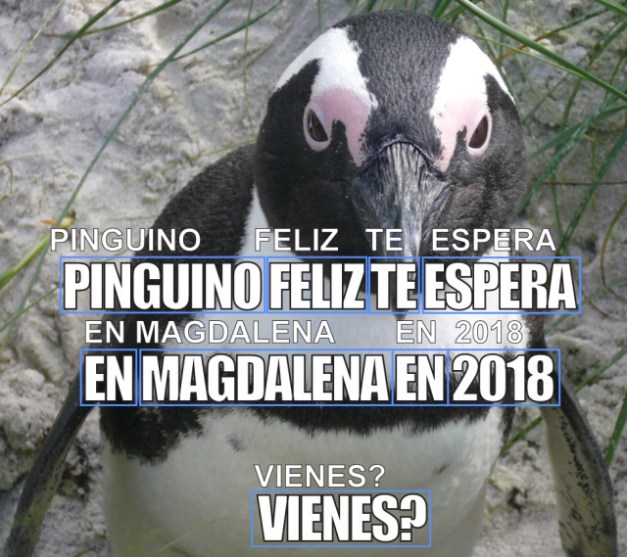

Les trois chercheurs expliquent, avec l’exemple de cette image de pingouin, que pour détecter du texte incrusté sur une image, Rosetta fonctionne en deux étapes :

- L’algorithme « détecte des régions rectangulaires » susceptibles de contenir du texte,

- Puis dans ce rectangle, il utilise un réseau de neurones (CNN) pour reconnaître et retranscrire le mot dans cette région de l’image.

Pour identifier les « rectangles » de texte, Rosetta apprend grâce à l’expérience : chaque mot forme un « bloc », souvent accolé à quelques autres blocs, ce qui permet de les identifier comme du texte, différent de l’image du fond.

Pour ensuite reconnaître les mots, les chercheurs ont entrainé leur IA avec d’abord « des mots courts, jusqu’à 5 caractères » avant de la « nourrir » de mots plus longs. « Notre modèle n’est pas limité à la langue anglaise », précisent-il, « Nous pouvons notamment supporter différents types de langage et d’encodement comme l’Arabe ou l’Hindi. » À noter que l’algorithme est aussi capable de détecter les emojis.

Un outil très utile pour les modérateurs

Facebook se vante aujourd’hui de travailler avec 7 500 modérateurs, mais la plateforme est encore accusée tous les jours d’avoir laissé passer des contenus malveillants. Une récente enquête d’Arte a par ailleurs montré combien le travail des modérateurs de l’ombre était ardu. Chaque jour, ces « nettoyeurs du web » invisibles doivent analyser des centaines d’images signalées par des internautes, à raison d’à peine quelques secondes de réflexion par image.

« Grâce à ces techniques, nous sommes capables de traiter un milliard d’images publiques chaque jour. Le texte extrait est utilisé en aval pour pouvoir agir sur des contenus qui violents nos politiques de service », souligne le post de blog. Mais les trois chercheurs concèdent qu’il y a encore de nombreuses limites, que ce soit pour l’entraînement des algorithmes que pour d’autres types de contenus.

L’un des défis de Facebook est non seulement d’appliquer cette détection de texte sur image, mais aussi de pouvoir détecter du texte sur des vidéos. « Il serait naïf de penser que l’on peut appliquer la méthode d’extraction de texte sur image en prenant chaque plan d’une vidéo, car ce n’est pas possible à grande échelle, notamment à cause de la croissance massive du nombre de vidéos sur notre plateforme », précisent les trois scientifiques.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !