Déjà mis en cause par le retrait de plusieurs annonceurs importants — dont Mars et Adidas –, qui refusent de voir leurs publicités diffusées sur des vidéos exploitant des enfants de manière violente ou dérangeante, YouTube s’est trouvé confronté à un nouveau problème ces derniers jours : la suggestion de mots-clé pédophiles dans sa barre de recherche.

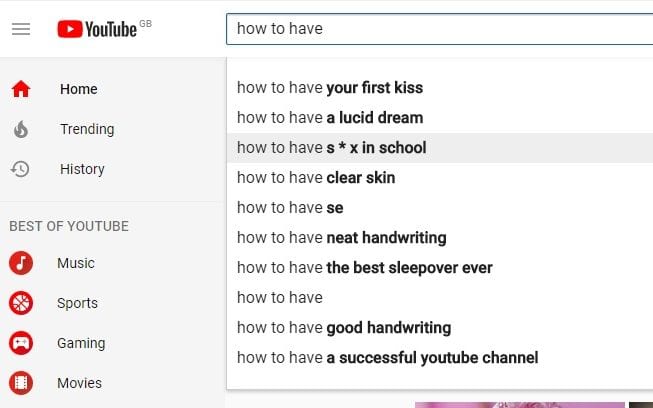

Plusieurs médias ont ainsi démontré qu’écrire « comment faire » (en anglais) entraînait la saisie semi-automatique de « comment faire l’amour avec des enfants » ou « avec ses enfants » — même si aucune vidéo de ce genre n’était en ligne. La plateforme s’est empressée de supprimer cette suggestion et assure enquêter sur l’origine de ce dysfonctionnement. Il pourrait tenir à une campagne coordonnée par des internautes cherchant à rendre cette recherche populaire et visible, à l’instar d’un hashtag sur Twitter.

Cette dérive n’est que la dernière en date d’une longue série pour YouTube, empêtré dans le scandale de parodies malsaines de dessins animés pour enfants, de vidéos de maltraitance sur mineurs et de commentaires pédophiles. Autant de problèmes que la plateforme a promis de régler grâce à de nouvelles mesures de modération, elle qui vient en outre de supprimer, en l’espace d’une semaine, 270 comptes et 150 000 vidéos tout en mettant fin à la monétisation sur près de 2 millions de vidéos de chaînes prétendument pour enfants.

L’auto-saisie sur YouTube expurgée des résultats pédophiles

Un bug de signalement en vigueur depuis plus d’un an

Mais ces mesures ponctuelles semblent difficilement pouvoir régler le problème sur le long terme, d’autant que ces dérives sont dues à un bug en vigueur depuis plus d’un an, selon les témoignages de modérateurs bénévoles recueillis par la BBC.

Ils déplorent en effet que le signalement des commentaires déplacés sur des vidéos de mineurs — allusion à caractère sexuel, partage de liens vers des sites pédophiles… — ne fonctionne pas correctement : l’alerte qu’ils reçoivent des internautes ne leur indique pas le commentaire spécifiquement visé, comme cela devrait être le cas, mais simplement le compte d’utilisateur concerné. D’où leur grande difficulté à retrouver le contenu signalé parmi les innombrables commentaires présents sur la chaîne, d’autant que les modérateurs estiment être confrontés à au moins 100 000 utilisateurs au profil de « prédateurs ».

YouTube devrait commencer par réparer le bug de signalement

Le sentiment de ne pas être soutenu par YouTube est répandu au sein de la communauté : « Nous ne pouvons pas utiliser les outils, les technologies et les ressources qu’une entreprise telle que YouTube possède ou pourrait déployer. Nous devons créer nous-mêmes tous les outils dont nous avons besoin. YouTube pourrait faire plein de choses pour lutter contre ce phénomène, à commencer par réparer le bug de signalement. »

De son côté, la plateforme continue de promettre, par la voix d’un porte-parole, une amélioration de son système de filtrage et de modération : « Tout contenu qui met les enfants en danger est abject et inacceptable. […] Nous sommes déterminés à arranger cette situation et admettons que nous devons en faire plus, autant grâce au machine learning que par une augmentation des ressources humaines et techniques. »

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !