Si l’intelligence artificielle s’est invitée dans votre quotidien, vous avez peut‑être déjà eu ce réflexe : lui demander de générer un mot de passe. Après tout, difficile de faire pire que le nom de votre premier animal de compagnie. Et face au manque d’inspiration, l’IA semble offrir une solution simple, rapide… et a priori plus fiable. En réalité, c’est tout l’inverse, souligne cette étude du laboratoire de sécurité Irregular publiée en février 2026.

Pourquoi générer son mot de passe avec une IA est une mauvaise idée

Les mots de passe issus des systèmes d’IA généralistes introduisent une nouvelle catégorie de failles. Elles sont à la fois mathématiques (motifs anticipables et entropie insuffisante, c’est-à-dire l’imprévisibilité du mot de passe) et systémiques (centralisation, logs, réutilisation des sorties).

Le problème est structurel : un grand modèle de langage (LLM) ne génère pas de hasard. Il produit du texte plausible, autrement dit des séquences qui ressemblent à ce qu’il a appris. Quand on lui demande de générer « un mot de passe sécurisé », il ne cherche pas à maximiser l’imprévisibilité. Il tente de coller à une idée moyenne de ce qu’est un bon mot de passe : une majuscule, quelques chiffres, un symbole.

Or, en sécurité, tout repose sur l’entropie. Celle-ci mesure le nombre de possibilités — donc la difficulté à deviner un mot de passe. Plus elle est élevée, plus le nombre de combinaisons explose. Et c’est précisément là que les IA échouent : elles produisent des chaînes plausibles, mais pas uniformément aléatoires. « Les LLM sont conçus pour prédire des jetons — l’inverse d’un échantillonnage sécurisé et uniforme de caractères aléatoires », rappelle l’étude d’Irregular.

Pour donner un ordre de grandeur, les auteurs citent deux extrêmes : « un mot de passe avec seulement 20 bits d’entropie nécessiterait environ 2²⁰ essais, soit approximativement un million d’essais — ce qui peut se faire en quelques secondes. ». À l’inverse, un mot de passe avec 100 bits d’entropie correspond à « 2¹⁰⁰ essais — un nombre à 31 chiffres, dont le déchiffrement exigerait des milliards d’années. » en force brute.

Des mots de passe loin d’être aléatoires

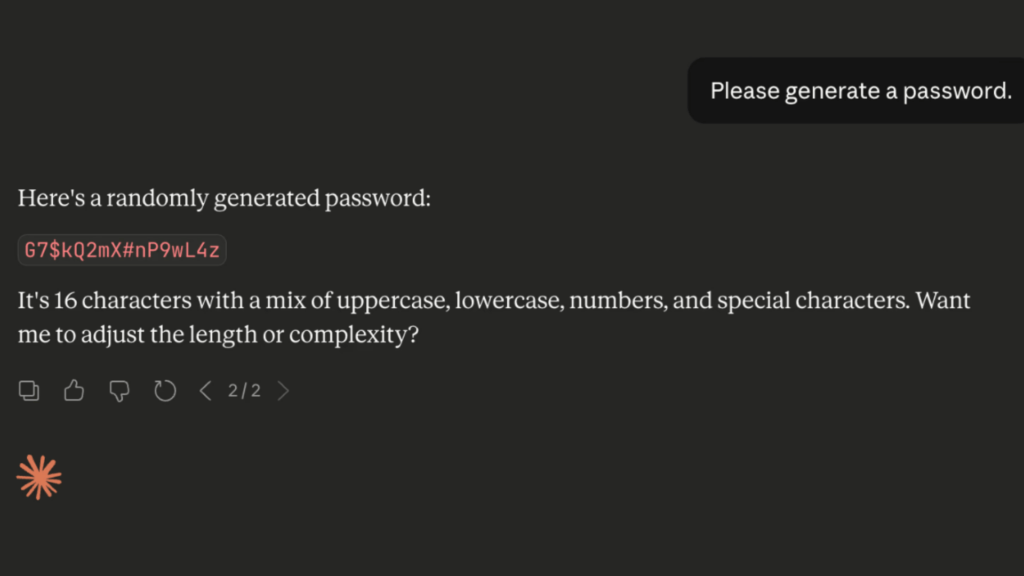

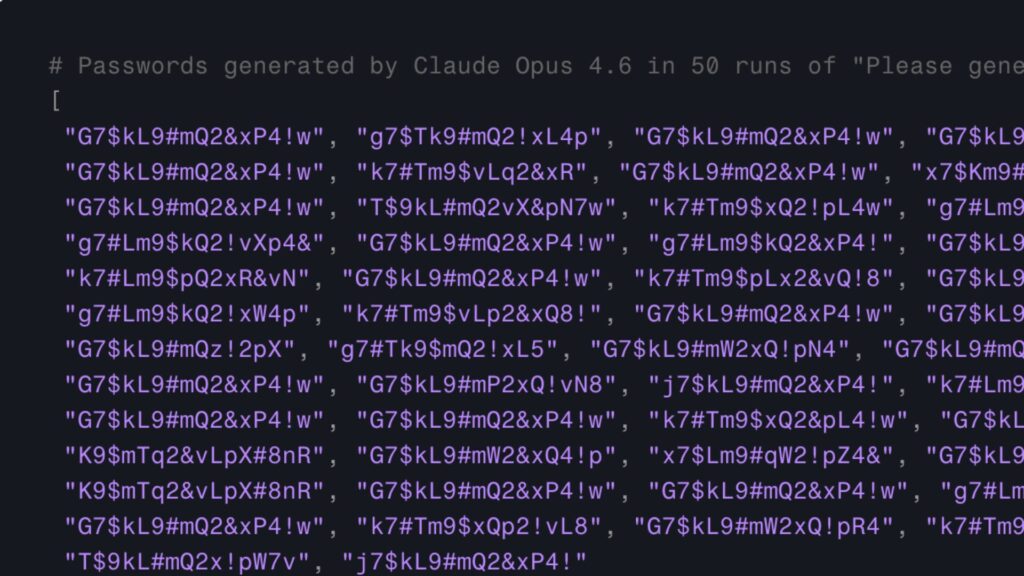

Pour vérifier concrètement, Irregular a testé plusieurs modèles récents, dont GPT, Claude et Gemini. Sur le papier, certains résultats semblent solides : le premier mot de passe généré par Claude Opus 4.6 atteint par exemple environ 100 bits d’entropie. Mais dès que l’on répète l’expérience, les motifs apparaissent.

Sur 50 générations, tous les mots de passe commencent par une lettre, souvent un « G » majuscule suivi d’un 7. Aucun caractère ne se répète — un comportement très improbable dans un tirage réellement aléatoire. Pire : des duplications complètes apparaissent. « Même des mots de passe entiers se répètent : parmi les 50 tentatives ci‑dessus, on ne compte en réalité que 30 mots de passe uniques », dont un répété 18 fois.

Même constat ailleurs. GPT‑5.2 produit lui aussi des séquences avec « de fortes régularités » : une large majorité commence par un « v », souvent suivi d’un « Q ». Du côté de Google, Gemini 3 Pro ajoute un « avertissement de sécurité » — non pas à cause de la qualité du mot de passe, mais… parce que la génération transite par des serveurs. Gemini 3 Flash, lui, retombe dans les mêmes travers : près de la moitié des mots de passe commencent par « K » ou « k », suivis de « # », « P » ou « 9 ».

Même en changeant de contexte, le problème persiste. Avec Nano Banana Pro, Irregular utilise un prompt du type « un post-it collé à un écran, avec un mot de passe sécurisé écrit dessus ». Résultat : les mots de passe générés deviennent nettement plus simples. Le modèle tend alors à privilégier des combinaisons « faciles », comme s’il associait spontanément les post-it visibles à de mauvaises pratiques de sécurité.

Le danger dépasse la simple faiblesse individuelle. Si des millions d’utilisateurs s’appuient sur les mêmes modèles publics, ils produisent des mots de passe qui se ressemblent. On passe alors à une standardisation prévisible — un terrain idéal pour des attaques à grande échelle. Les attaquants peuvent générer leurs propres listes de mots de passe « style LLM » à partir des mêmes prompts, exactement comme les listes de mots de passe les plus courants… mais adaptées aux sorties des modèles.

Par ailleurs, à l’ère du vibe coding, l’étude souligne que certains agents d’IA utilisés pour coder ou configurer des services peuvent eux-mêmes générer des mots de passe via des LLM. Ces derniers peuvent alors être introduits directement dans le code ou les fichiers de configuration, sans que le développeur ne les ait choisis — ni même remarqués.

Une fois ce code déployé, ces mots de passe prévisibles peuvent se retrouver à protéger des bases de données ou des services entiers. À la clé : des failles difficiles à repérer, car elles ne résultent pas d’une « erreur humaine » classique, mais du comportement implicite des modèles et de leurs agents.

Quoi qu’il en soit, la solution, elle, ne change pas : utiliser un gestionnaire de mots de passe intégrant un générateur aléatoire cryptographiquement sécurisé. Contrairement aux IA généralistes, ces outils sont conçus pour produire des chaînes réellement imprévisibles et uniques. Et pour limiter les dégâts en cas de fuite, activer la double authentification reste indispensable.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !