« Les visages générés par l’IA sont désormais indiscernables des visages humains. » C’est la conclusion d’une étude menée par une équipe de chercheurs des universités de Toronto, d’Aberdeen, d’Australie-Occidentale et de l’University College London, et publiée le 13 novembre 2023 dans le journal scientifique Psychological Science.

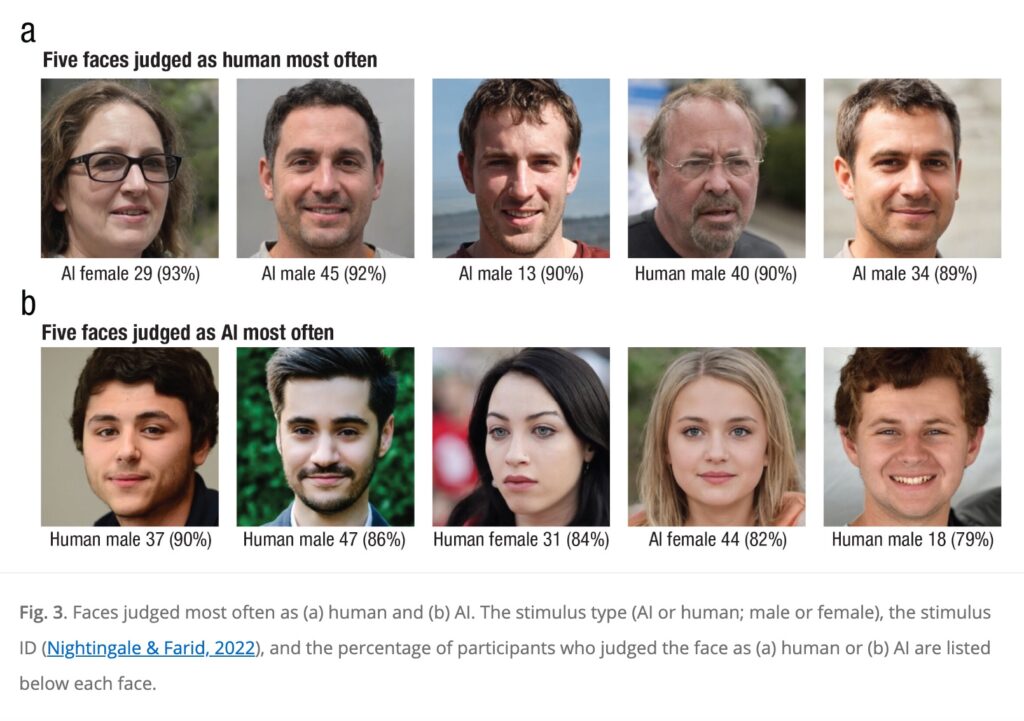

« Les visages générés par l’IA sont désormais largement disponibles (par exemple, this-person-does-not-exist.com) », indiquent les chercheurs au début de leur article. Ces visages créés par IA sont autant utilisés pour de bonnes causes qu’à des « fins malveillantes », d’où leur inquiétude. Leurs résultats n’en sont que plus alarmants : « nous soutenons que les visages générés par IA ne sont pas seulement impossibles à distinguer des visages humains, mais qu’ils peuvent même être perçus comme plus ‘humains’ que les vrais visages humains ». Les chercheurs ont donné un nom à ce phénomène : AI hypperralism, l’hyperréalisme par IA.

L’hyperréalisme concerne les visages blancs, pas les autres

Pour réaliser leur étude, les scientifiques ont demandé à un groupe d’une centaine de personnes d’identifier quels visages appartenaient à des humains, et quels visages avaient été générés par une intelligence artificielle. Non seulement une grande partie des participants s’est trompée, mais « les personnes qui ont commis le plus d’erreurs dans cette tâche étaient les plus confiantes », souligne l’étude. Au final, 66 % des photos générées par l’IA ont été jugées humaines, contre 51 % pour les vraies images de personnes réelles.

Il existe une grosse exception à cette découverte : les visages non blancs. En effet, les participants à l’étude ont plus réussi à correctement identifier les visages non blancs générés par IA : 51 % des visages créés avec IA et des photos de personnes réelles ont été jugés humains. Cette meilleure appréhension des visages non blancs est due à l’entraînement des IA, selon les chercheurs.

« Les algorithmes ont tendance à être formés en utilisant un nombre disproportionné de visages blancs » : 69 % des visages sur lesquels les IA sont entrainées seraient blancs, contre 31 % de visages de personnes non blanches. Ce n’est pas un nouveau problème : on parle de ce déséquilibre depuis 2018 — mais peu de choses ont été faites pour changer la situation. Aujourd’hui, cet écart lors de l’entraînement aurait créé un biais algorithmique : les IA sont mieux entraînées sur les visages blancs, et parviennent donc mieux à les reproduire. Ce biais a également « des conséquences sur la prolifération des préjugés sociaux et sur la mauvaise identification de l’IA par le public. »

Ce n’est pas non plus la première fois qu’une étude souligne les biais racistes des IA. Alors que de plus en plus d’applications et d’entreprise ont recours à ces outils, la situation pourrait vite empirer et l’utilisation des IA dans certains secteurs avoir d’importantes conséquences. Pourtant, les auteurs de l’étude ne se montrent pas pessimistes : « la société a été confrontée à de nombreux défis à grande échelle, à première vue insurmontables, qui sont par la suite devenus une partie normale et gérable de la vie (par exemple, la sécurité automobile). Nous espérons que les réponses sociales et réglementaires réduiront les risques potentiels à mesure que la société s’adaptera à la présence inévitable de l’IA dans notre monde. »

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !