Cet article est extrait de notre newsletter hebdomadaire Règle30, éditée par Numerama. Il s’agit du numéro du 6 juillet 2022. Pour vous y inscrire gratuitement, c’est ici.

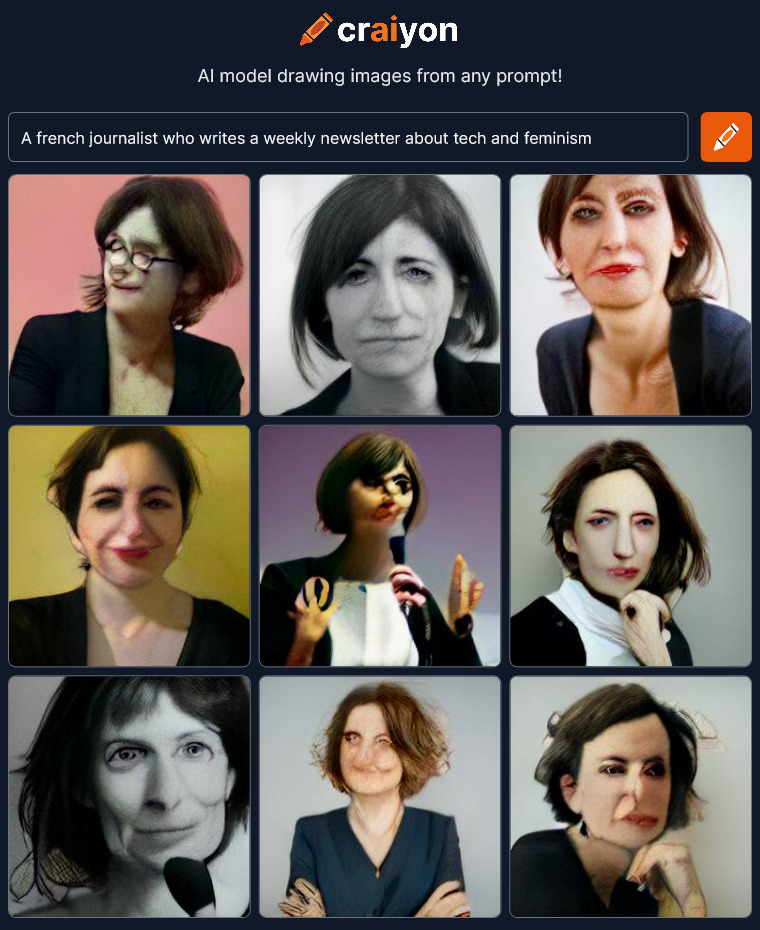

J’ai l’habitude de croiser des robots sur internet. Des jolies femmes qui m’offrent des iPhone gratuits sur Instagram, des comptes automatiques et absurdes sur Twitter, des mails qui me promettent la richesse si je leur réponds ou le malheur si je ne leur réponds pas. Alors, quand les images de DALL-E sont apparues dans mes fils d’actualité, je n’ai pas vraiment tiqué. Dès janvier, Numerama nous présentait cette intelligence artificielle capable de générer une image à partir d’un texte. Quelques mois plus tard, elle fut remplacée par sa successeuse, DALL-E 2. Le logiciel n’est accessible qu’à quelques milliers de personnes — des chercheurs et des chercheuses, des journalistes, des artistes — mais le grand public peut s’amuser avec une version moins élaborée, baptisée Craiyon (ou DALL-E mini). Très vite, les réseaux sociaux ont été envahis d’expériences plus ou moins réussies. Et si un panda jouait au basket ? Ou qu’Emmanuel Macron participait à Danse avec les stars ?

Le traitement médiatique de DALL-E est, je crois, typique de notre relation avec les intelligences artificielles aujourd’hui :

- Étape 1 : la fascination (c’est une révolution !)

- Étape 2 : le rire (c’est quand même moche !)

- Étape 3 : la peur (au fait, et si c’était utilisé pour harceler des femmes ou renverser des gouvernements ?)

Ainsi, tous les articles que j’ai pu lire à ce sujet se concluaient inévitablement par les risques et les biais de DALL-E : c’est un logiciel raciste, sexiste, bizarrement obsédé par les femmes portant des saris (ça, au moins, c’est original). Ces problèmes sont d’ailleurs admis par l’entreprise à l’origine du programme, Open AI. Elle reconnaît qu’« atténuer les biais n’est pas une tâche facile » et souhaite encourager la recherche à ce sujet. « DALL-E est un progrès dans l’histoire des technologies. Mais dans quelques années, est-ce qu’on considérera cette avancée comme une révolution, ou quelque chose de beaucoup plus sombre ? », écrivait le journaliste américain Casey Newton dans sa newsletter Platformer. « Le futur est déjà là pour plusieurs milliers de personnes. On doit débattre de ces risques maintenant, avant que le reste du monde n’y ait accès.»

Honnêtement, ce genre de discours m’agace. Les entreprises de la tech et les médias ne peuvent pas agir comme s’ils découvraient le problème des biais algorithmiques, désormais largement documenté et connu du grand public. À la place, on traite donc le sujet comme inévitable, sans vraiment explorer les solutions, ou même envisager de ne pas utiliser les IA fautives. Pourquoi débattre maintenant, plutôt que d’appuyer sur le bouton pause hier ? Et pourquoi nous, personnes non-expertes, mais néanmoins soumises à ces inventions, ne sommes pas plus en colère ? « On confond l’éthique en intelligence artificielle avec le fait d’admettre le bordel que l’on a créé, puis de hausser les épaules et de passer à autre chose », tweetait en avril le chercheur anglais Mike Cook. « À quoi ça sert d’étudier le problème, si on ne décide jamais d’annuler ce genre de projets ?»

On peut aussi s’interroger sur notre fascination collective pour ces programmes automatiques et leurs erreurs. Qu’espère-t-on voir dans le miroir déformant des IA ? Quelque chose de stupide et d’amusant, qui nous rassure sur notre supériorité d’humains ou d’humaine ? Ou au contraire, un résultat meilleur que notre réalité, qui nous donne l’espoir d’un avenir moins catastrophique ? À ce sujet, j’ai apprécié cette analyse de The Atlantic (en anglais) qui revient sur la trajectoire de @Horse_ebooks. Ce vieux compte Twitter est devenu populaire grâce à ses tweets automatiques absurdes, mais est tombé en disgrâce lorsqu’il a été récupéré par des artistes prétendant être des IA. Dans son article, la journaliste théorise justement que notre fascination actuelle pour DALL-E 2 est liée à une actualité angoissante. Cette situation créée d’étranges dissonances. On applaudit la couverture du magazine Cosmopolitan réalisée à l’aide d’une intelligence artificielle (« je me sens comme cette cosmonaute badass, en marche vers un futur palpitant », a commenté une employée d’Open AI) la même semaine où l’on a appris que l’IVG devenait en partie illégale aux États-Unis. Personnellement, notre présent ne me fait pas rire, et les robots du futur non plus.

La revue de presse de la semaine du 1er juillet

Droit à l’avortement (1)

Cette revue de presse est surtout dédiée au recul du droit à l’avortement aux États-Unis, car il y a encore beaucoup à en dire. Clue, une application de suivi des règles d’origine allemande, affirmait récemment que les données de ses utilisateurs et utilisatrices américain·es étaient protégé·es par le RGPD. Mais cette garantie est-elle vraiment suffisante ? Réponse détaillée chez Numerama, qui a mené l’enquête.

Droit à l’avortement (2)

La semaine dernière, Google a annoncé qu’il supprimerait automatiquement les données de localisation liées à des lieux de santécomme les cliniques d’avortement, mais aussi les refuges contre la violence domestique, les centres de fertilité ou de traitement de la toxicomanie. Le but est que ces informations ne puissent pas être récupérées afin de harceler, voire d’enquêter, sur les femmes et les personnes fréquentant ces endroits. Plus de détails chez Numerama.

Droit à l’avortement (3)

Je vous recommande également la lecture de cet entretien avec Eva Galperin, directrice de la cybersécurité au sein de l’EFF (Electronic Frontier Foundation), célèbre organisation américaine de protection des libertés en ligne. Elle reprend très clairement tous les enjeux numériques de la répression de l’IVG, et plus généralement les responsabilités des grandes entreprises du secteur dans cette affaire. C’est à lire chez Pixels/Le Monde.

Bravo les lesbiennes

Enfin, pour achever cette revue de presse, un sujet plus réjouissant ! Cet entretien revient sur le travail de Léna, archiviste numérique qui se consacre à la sauvegarde et la cartographie des sites web francophones dédiés aux lesbiennes. Comment archive-t-on un site, un compte Instagram militant, un fanzine en ligne ? À quoi cela sert ? Pourquoi est-ce un enjeu essentiel pour les lesbiennes françaises, mais aussi plus généralement pour la mémoire du web ? Léna fait par ailleurs partie du collectif Big Tata Queer, archive bénévole de documents (virtuels ou non) LGBTQI+. Si toutes ces initiatives vous intéressent, vous pouvez lire l’interview de Léna chez Friction Magazine.

Quelque chose à lire/regarder/écouter/jouer

En 2010, Facebook dépassait les 500 millions d’utilisateurs et d’utilisatrices. La même année naissait le boys band One Direction. Et si les deux évènements étaient liés ? C’est le point de départ de Everything I need I get from you – How fangirls created the internet as we know it, un essai de la journaliste américaine Kaitlyn Tiffany. En partant de sa propre expérience de fan de One Direction et de son adolescence passée en ligne, elle explore la place des fans dans l’histoire du web, et leur influence invisible sur les géants du numérique.

Même si son titre laisse à penser qu’il traite de toutes les fangirls, cet essai se concentre surtout sur le fandom One Direction. À titre personnel, cela n’a pas du tout gêné : j’y ai retrouvé beaucoup de similarité avec ma propre adolescence en ligne, ses joies, sa créativité, ses dangers, et surtout ses obsessions. L’essai tient par ailleurs ses promesses, en démontrant les liens entre le développement du web social (Facebook, Twitter, Tumblr) dans les années 2010 et l’expression des fandoms en ligne, s’appuyant sur des interviews de professionnel·les du numérique, de chercheurs et de chercheuses et, évidemment, de fans. Si les mots « ship » et « imagine » vous évoquent autre chose qu’un bateau et une chanson de John Lennon, cette lecture sera probablement très nostalgique (et un peu mortifiante !) Pour les autres, How fangirls created the internet as we know it est une analyse rare des mutations du web vues du côté des internautes et de leurs communautés, plutôt que de celui des entreprises qui en ont profité.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !