En 1993, le film Demolition Man avait imaginé un monde futuriste dans lequel les individus pourraient être suivis à la trace grâce à un implant sous-cutané (qu’on a remplacé par le téléphone mobile), et où le comportement des citoyens serait surveillé automatiquement, jusqu’à leur langage. A la moindre grossièreté, des amendes étaient automatiquement distribuées aux contrevenants. L’idée avait donné naissance à une scène mémorable dans laquelle Sylvester Stallone, ne sachant pas utiliser « les trois coquillages », enchaînait les insultes pour obtenir des feuilles de papier utiles pour les toilettes :

https://youtube.com/watch?v=s9U9Hm5Mn6U%3Frel%3D0

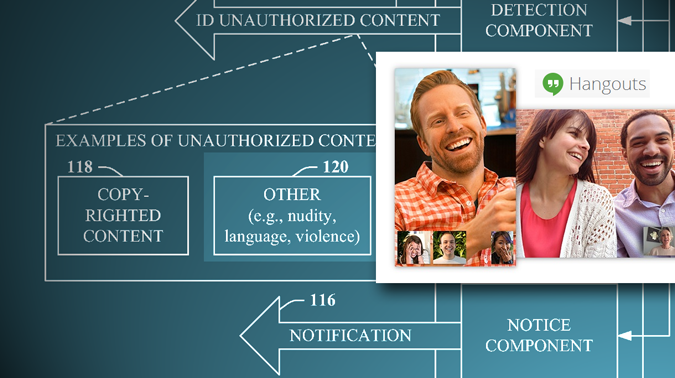

Vingt ans plus tard, nous n’en sommes heureusement pas encore là, mais nous allons tout de même dans cette direction. Au moins dans l’univers numérique. Ainsi, Google a déposé en mai dernier un brevet qui vient d’être rendu public, dans lequel il décrit un contrôle automatique du contenu des vidéoconférences organisées à des travers des services comme Google Hangouts, qui permettent à plusieurs utilisateurs de se connecter sur un même flux en streaming, alimenté par plusieurs utilisateurs.

Le brevet décrit la manière dont les éditeurs de ces services pourraient contrôler automatiquement la teneur des contenus diffusés, principalement pour empêcher les diffusions de contenus protégés par les droits d’auteur, mais aussi pour empêcher les comportements « déviants » comme la nudité, la violence, ou l’emploi de mots grossiers.

« Lorsque des utilisateurs diffusent des contenus médias à d’autres utilisateurs à travers l’infrastructure réseau fournie par un fournisseur de serveur/hébergeur, le fournisseur de service a souvent un contrôle limité sur le contenu qui est diffusé mais pourrait être tenu responsable des violations commises par les utilisateurs« , s’inquiète Google en introduction du brevet. Il imagine donc un système de reconnaissance automatique des contenus interdits, avec différentes politiques paramétrables, et de sanctions graduées.

Au premier niveau, une simple « notification peut servir d’avertissement pour les utilisateurs qui diffusent, pour que ces utilisateurs puissent prendre les mesures pour supprimer le contenu non autorisé de leur propre flux, comme éteindre la radio en arrière-plan » parce qu’elle diffuse une musique protégée par les droits d’auteur, explique Google. De même en cas d’emplois répétés de gros mots, ou si l’une des participantes décide de se mettre nue dans une visioconférence privée.

Si les avertissements ne sont pas suivis d’effets, Google imagine la possibilité de couper l’intégralité de la visioconférence, d’exclure uniquement la personne fautive, et même de la ficher pour l’empêcher de participer plus tard à d’autres vidéoconférences.

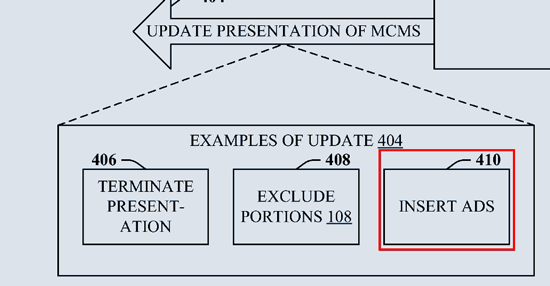

Officiellement, il s’agit pour Google de prévenir une responsabilité juridique de l’hébergeur pour les contenus ainsi streamés en direct, laquelle n’est bien sûr pas prévue par les textes, ni en Europe, ni aux Etats-Unis. La motivation réelle d’un tel système se trouve reléguée dans un schéma en page 36 du brevet. Google imagine la possibilité d’insérer des publicités contextuelles en fonction de ce qui est raconté par les utilisateurs, et veut rassurer pouvoir rassurer les annonceurs sur le fait que leurs annonces ne seront pas associées à des contenus illicites ou à des contenus qu’une certaine morale réprouve :

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Tous nos articles sont aussi sur notre profil Google : suivez-nous pour ne rien manquer !